光学字符识别(OCR)技术在文档数字化和信息提取领域扮演着重要角色。然而,传统的基于流水线的 OCR 系统虽然功能强大,却常常因无法处理复杂布局而受到限制。最近,艾伦人工智能研究所推出的 olmOCR 模型以其端到端的线性化能力引起了广泛关注,但在实际业务应用中,它却忽略了页眉、页脚等关键区域的信息。为了解决这一问题,TNG科技 对原始的 olmOCR 模型进行了微调,使其能够更忠实地提取文档中的所有内容,包括页眉、页脚和浮动元素。

传统 OCR 引擎的局限性

长期以来,OCR 技术依赖于基于流水线的系统。这些系统通常由多个机器学习组件组成,例如:

节段分割:将文档划分为不同的区域。 表格解析:识别并提取表格结构。 字符识别:识别单个字符或单词。

尽管这种方法在某些场景下表现良好,但它存在一个根本缺陷:提取的结果往往缺乏逻辑阅读顺序(即线性化)。对于布局复杂的文档(如多栏文本、浮动图表、页眉和页脚),这种系统难以生成符合人类阅读习惯的输出。

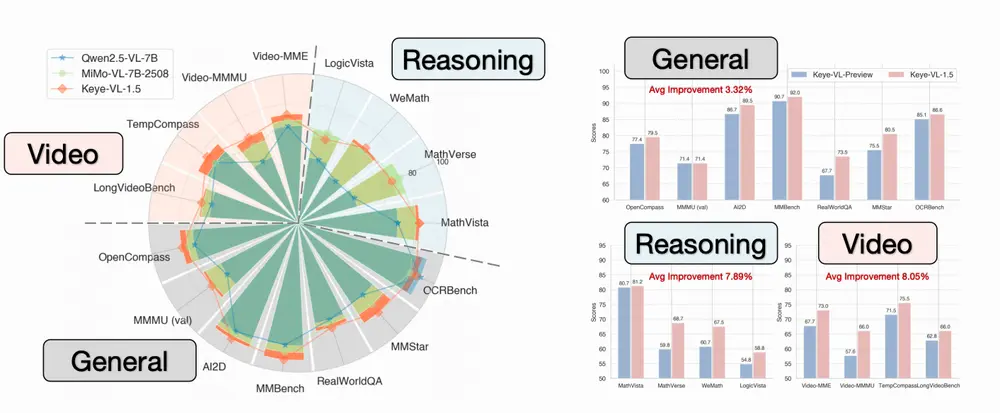

随着视觉语言模型(VLMs)的兴起,研究人员开始探索使用这些模型作为替代方案。与传统的流水线系统不同,视觉语言模型能够直接处理图像和文本的联合建模,从而更好地保留文档的上下文和结构。

起点:olmOCR-7B-0225-preview

olmOCR 是一种基于视觉语言模型的 OCR 工具,能够将 PDF 转换为干净、线性化的纯文本,同时保留文档的主要结构化内容。然而,该模型的设计初衷是为大型语言模型提供训练数据,因此有意忽略了文档中被认为“无关”的信息,例如页眉、页脚和浮动元素。

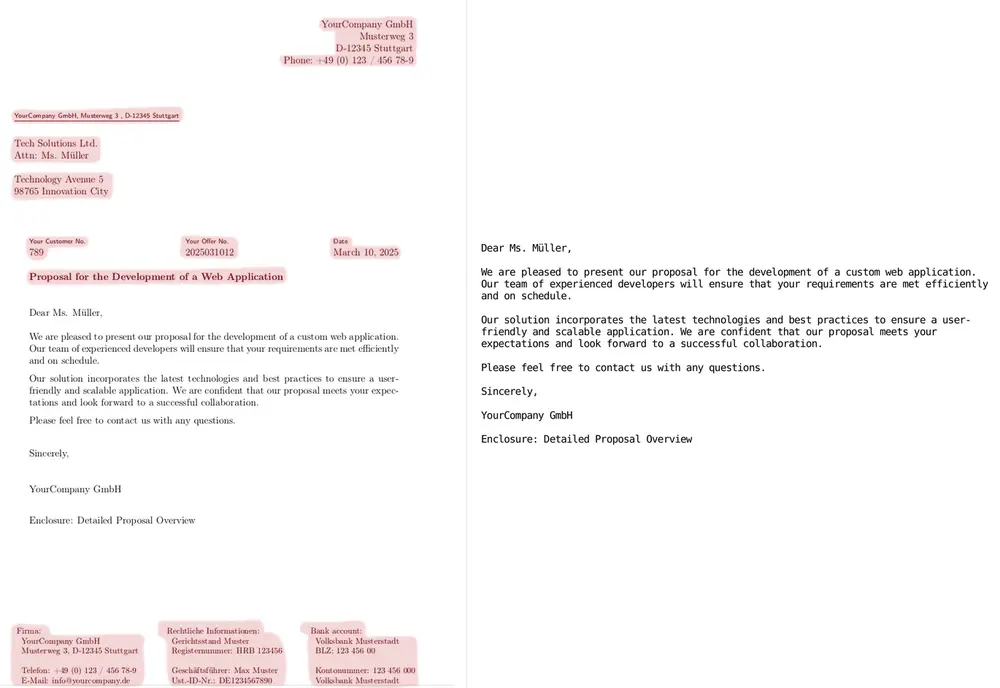

这种设计在生成训练数据时是有意义的,因为这些区域的内容通常无法自然融入阅读流程。但对于实际业务应用(如发票解析、合同分析等),这些被忽略的部分可能包含关键信息。例如,发票的页眉可能包含供应商名称和联系方式,页脚可能包含页码或总计金额。

微调 olmOCR:从训练到评估

为了使 olmOCR 更适合实际业务需求,TNG科技对其进行了微调,目标是让模型能够提取文档中的所有相关信息,包括页眉、页脚和其他浮动元素。

1. 数据集生成

微调过程的关键在于构建高质量的数据集。TNG科技利用 Qwen2.5-VL-72B-Instruct 生成了一个包含 8,000 个文档 的新数据集。这些文档涵盖了各种真实场景,并确保所有相关信息(包括页眉、页脚和浮动元素)都被准确标注。

2. 训练设置

微调基于开源的 olmOCR 训练流水线,在 8xH100 Nvidia 节点 上完成。训练过程中采用了以下配置:

梯度累积步骤:4 步 训练轮次:2.5 个 epoch 超参数:默认设置效果良好,无需进行资源密集型的超参数搜索

实验跟踪工具 Mlflow 显示了训练过程中的稳定性和性能提升。

3. 评估方法

评估使用了 olmOCR-mix-0225 数据集的自定义版本,其中包含了页眉、页脚和其他关键区域的信息。这些标注同样通过 Qwen2.5-VL-72B-Instruct 获取,确保了评估结果的可靠性。

微调后的 olmOCR 表现如何?

经过微调后,新的 olmOCR 模型在实际业务应用中表现出色。以下是主要改进和特点:

全面信息提取 微调后的模型能够提取文档中的所有内容,包括页眉、页脚和浮动元素。 这对于发票解析、合同分析等需要完整信息的场景至关重要。

保留线性化能力 尽管增加了对非核心区域的关注,模型仍然保持了原有的线性化能力,确保输出的文本符合逻辑阅读顺序。

表格解析能力 模型在简单表格的解析上表现良好,能够正确识别和提取表格内容。

温度对输出质量的影响 实验发现,生成输出的质量可能会因温度设置的不同而发生变化。较低的温度通常能生成更一致和精确的结果。

原始 olmOCR 与微调后的对比

| 特性 | 原始 olmOCR | 微调后的 olmOCR |

|---|---|---|

| 页眉和页脚信息 | 忽略 | 完整提取 |

| 浮动元素 | 部分支持 | 全面支持 |

| 线性化能力 | 优秀 | 保持优秀 |

| 表格解析 | 支持简单表格 | 支持简单表格 |

| 适用场景 | 大型语言模型训练数据生成 | 发票解析、合同分析等业务场景 |

相关文章