随着 Normalized Attention Guidance(NAG) 技术的提出,扩散模型在少步采样场景下的负向引导难题得到了有效解决。为了方便用户快速集成这一技术,ComfyUI-NAG 插件 应运而生。

- GitHub:https://github.com/ChenDarYen/ComfyUI-NAG

- Wan2.1 Demo: https://huggingface.co/spaces/ChenDY/NAG_wan2-1-fast

- LTX Video Demo: https://huggingface.co/spaces/ChenDY/NAG_ltx-video-distilled

- Flux-Dev Demo: https://huggingface.co/spaces/ChenDY/NAG_FLUX.1-dev

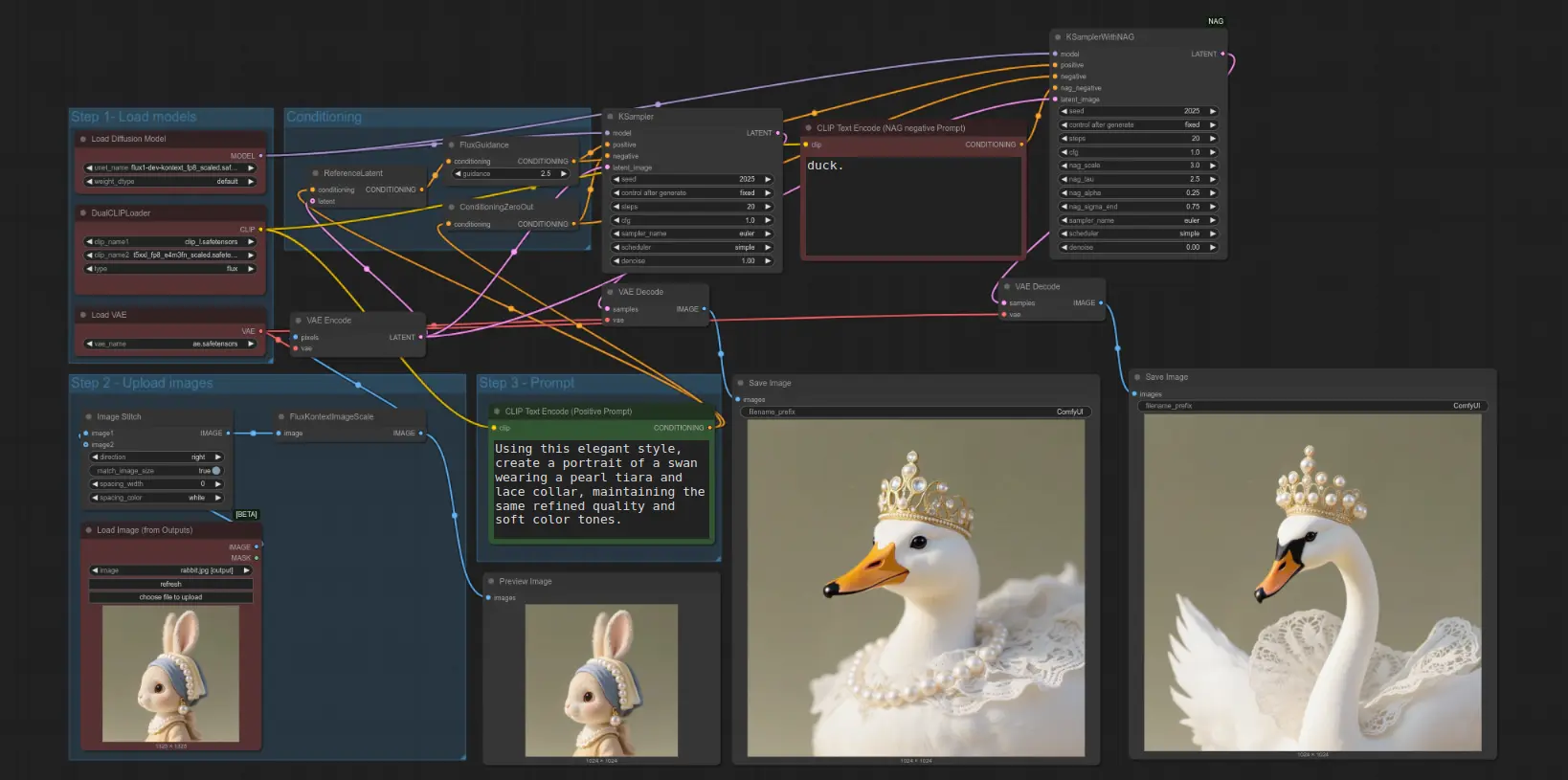

该插件现已全面支持主流图像与视频生成模型,并提供了简单易用的节点接口,让你在 ComfyUI 中轻松实现高质量的负向提示控制。

✅ 插件功能亮点

- 恢复负向引导能力:尤其适用于少步扩散模型,在 CFG 失效时依然能稳定工作。

- 兼容多步采样:与传统 CFG 互补,提升生成质量与控制精度。

- 广泛模型支持:涵盖 Flux、Flux Kontext、Wan、Hunyuan Video、SD3.5、SDXL 等主流开源模型。

- 轻量无训练依赖:纯推理阶段插件,无需额外训练即可部署。

- 显著提升效率:新增对编译模型(如 TorchCompileModel)的支持,进一步加速采样流程。

📆 最新更新日志

- 2025-06-29:新增对编译模型的支持,使用

TorchCompileModel可显著加快 NAG 采样速度! - 2025-06-28:正式支持 Flux Kontext 模型,配套工作流已就位。

- 2025-06-26:支持 Hunyuan 视频生成模型。

- 2025-06-25:新增对 Wan 视频生成模型(含 GGUF 版本) 的支持,提供全新工作流示例!

🧩 支持节点说明

当前插件提供两个核心节点:

| 节点名称 | 功能描述 |

|---|---|

NAGCFGGuider | 替代原生 CFGGuider 节点,启用 NAG 引导机制 |

KSamplerWithNAG | 替代原生 KSampler 节点,内置 NAG 支持 |

只需将原有流程中的 CFG 节点替换为上述节点,即可立即体验 NAG 带来的更强控制力。

🛠️ 使用方法简要

- 安装插件后重启 ComfyUI;

- 在你的工作流中找到

CFGGuider或KSampler节点; - 将其替换为

NAGCFGGuider或KSamplerWithNAG; - 根据模型特性调整参数以获得最佳效果。

示例工作流可在插件目录

./workflows中查看,推荐新手从这些模板开始尝试。

⚙️ 关键参数说明

| 参数名 | 含义说明 |

|---|---|

nag_scale | 控制注意力特征外推强度,值越高,负向引导越强。建议初始设为 1.0~2.0。 |

nag_tau | 归一化阈值,影响引导范围和稳定性。值越高,抑制越强。 |

nag_alpha | 原始注意力与外推注意力之间的混合因子,决定保留多少原始信息。值越高,引导越强。 |

nag_sigma_end | 设置 NAG 生效的最大噪声级别。合理设置可减少计算开销而不影响质量。 |

推荐配置参考

- 对于基于流的模型(如 Flux):

nag_sigma_end = 0.75可显著提速,同时保持视觉一致性。 - 对于扩散模型(如 SDXL):默认

nag_sigma_end = 4即可取得良好平衡。 - 图像参考任务(如 Image2Video):建议使用较低的

nag_tau和nag_alpha,以更忠实还原参考内容。 - 高 CFG / 多步采样模型:同样推荐较低的

nag_tau和nag_alpha,避免过度引导带来的伪影。 - 少步模型(如 Flux-Schnell):可适当调高

nag_tau和nag_alpha,增强负向引导效果。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...