通义千问(Qwen)家族再添新成员!Qwen3.5 小模型系列今日正式发布,涵盖 0.8B、2B、4B、9B 四种参数量级。这一系列模型不仅继承了 Qwen3.5 大模型的强大基因,更在效率与性能的平衡上达到了新高度,旨在为从边缘设备到轻量级服务器的全场景应用提供最强算力支持。

- Hugging Face:https://huggingface.co/collections/Qwen/qwen35

- 魔搭:https://modelscope.cn/collections/Qwen/Qwen35

- Ollama:https://ollama.com/library/qwen3.5

核心亮点:小模型,大能力

此次发布的 Qwen3.5 小模型系列并非简单的“缩小版”,而是经过深度优化的独立杰作:

1. 全系原生多模态

不同于以往小模型仅支持文本,Qwen3.5 全系列(0.8B/2B/4B/9B)均具备原生多模态能力。这意味着它们可以直接理解图像、图表和文档,无需额外的视觉编码器,大幅降低了部署复杂度和推理延迟。

2. 规模化强化学习(RL)

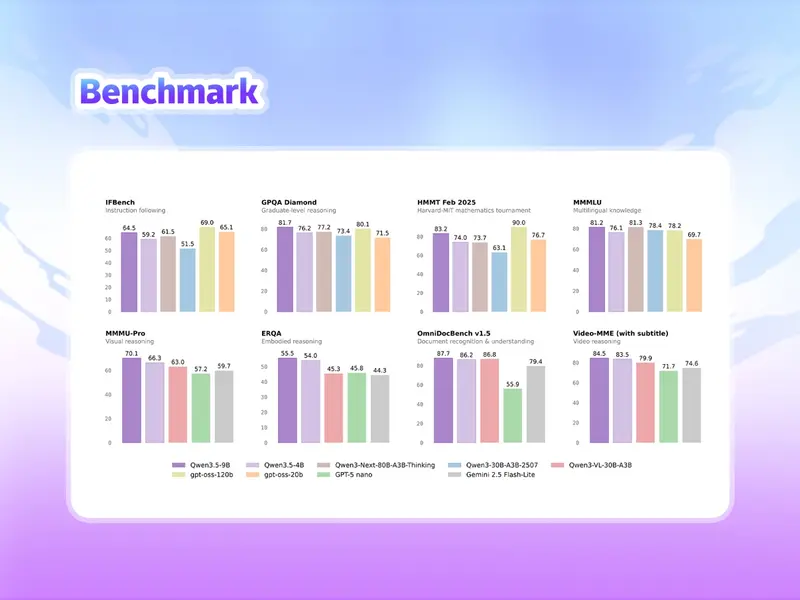

所有小模型均采用与完整 Qwen3.5 系列相同的规模化强化学习训练方案。这使得它们在逻辑推理、代码生成和指令遵循能力上远超同量级模型,甚至在某些任务上逼近更大参数的模型。

3. 架构升级与高效推理

通过改进的架构设计,新系列模型在保持高精度的同时,实现了极致的推理速度,特别适合对延迟敏感的实时应用场景。

四大尺寸,精准匹配不同场景

| 模型版本 | 核心定位 | 适用场景 |

|---|---|---|

| Qwen3.5-0.8B | 极致轻量 | 超低功耗 IoT 设备、移动端实时交互、嵌入式系统。速度快如闪电,资源占用极低。 |

| Qwen3.5-2B | 平衡之选 | 智能手机、平板、边缘网关。在性能与资源之间取得完美平衡,适合日常辅助任务。 |

| Qwen3.5-4B | 智能体基石 | 轻量级多模态智能体。具备强大的视觉理解与规划能力,是构建自主 Agent 的惊喜之选,表现稳健。 |

| Qwen3.5-9B | 越级挑战者 | 本地服务器、私有化部署。紧凑的体积下隐藏着接近前沿大模型的性能,可处理复杂推理与长文本任务。 |

生态友好:基础模型同步开放

为了满足开发者多样化的定制需求,通义实验室同步发布了上述所有尺寸的基础模型(Base Models)。

- 自由微调:开发者可以基于行业数据轻松进行 SFT(监督微调)或 RLHF(人类反馈强化学习),打造专属领域的垂直模型。

- 无缝集成:配合现有的 Qwen 生态工具链,可实现从训练到部署的一站式流程。

应用场景展望

- 端侧智能:在手机、手表、家居设备上运行本地化的 AI 助手,保护隐私且零延迟。

- 多模态 Agent:利用 4B 模型的视觉与推理能力,构建能看图、能规划、能执行任务的自主智能体。

- 边缘计算:在工厂、仓库等网络受限环境中,部署 9B 模型进行实时质检、数据分析与决策。

- 低成本服务:对于初创公司或中小型企业,9B 模型提供了极具性价比的私有化大模型解决方案。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...