小米正式推出三款全新大模型——MiMo-V2-Pro、MiMo-V2-Omni与MiMo-V2-TTS,目前这些模型已登陆Xiaomi miclaw、MiMo Studio、金山办公、小米浏览器等平台,同时可通过OpenClaw、OpenCode、KiloCode、Blackbox、Cline等框架接入,并且面向开发者开启为期一周的限时免费体验。

此前在OpenRouter平台推出的匿名模型Hunter Alpha、Healer Alpha也正式官宣身份,前者即为小米MiMo-V2-Pro,后者则是小米MiMo-V2-Omni,两款模型各有技术侧重与场景适配性。

小米MiMo-V2-Pro:Agent时代的旗舰基座模型

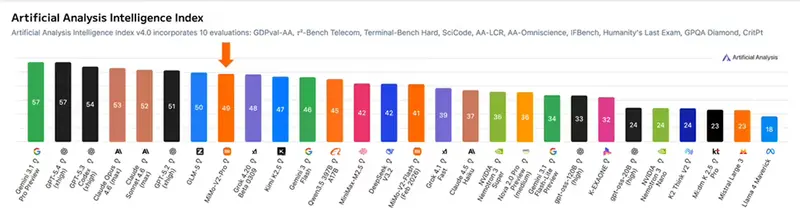

MiMo-V2-Pro专为现实世界高强度的Agent工作场景打造,是小米面向Agent时代推出的旗舰基座模型。该模型拥有超1T总参数量,其中激活参数为42B,采用创新混合注意力架构,同时支持1M超长上下文长度。小米还在更广泛的Agent场景中持续拓展算力,进一步延伸智能动作空间,实现了从Coding到Claw的重要能力泛化,在Artificial Analysis排行榜中,MiMo-V2-Pro位列全球第八、国内第二。

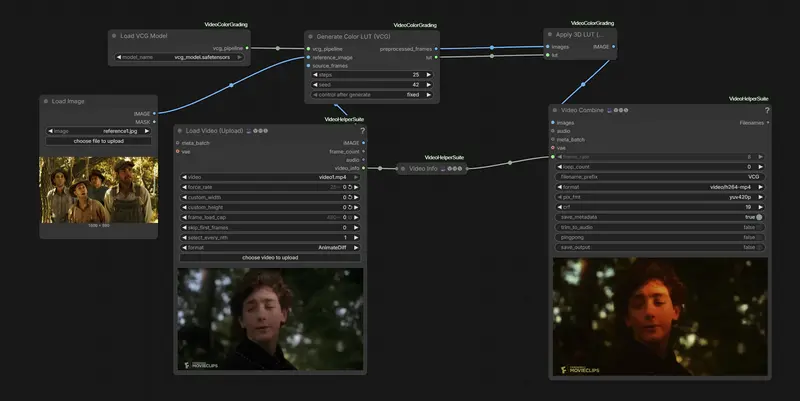

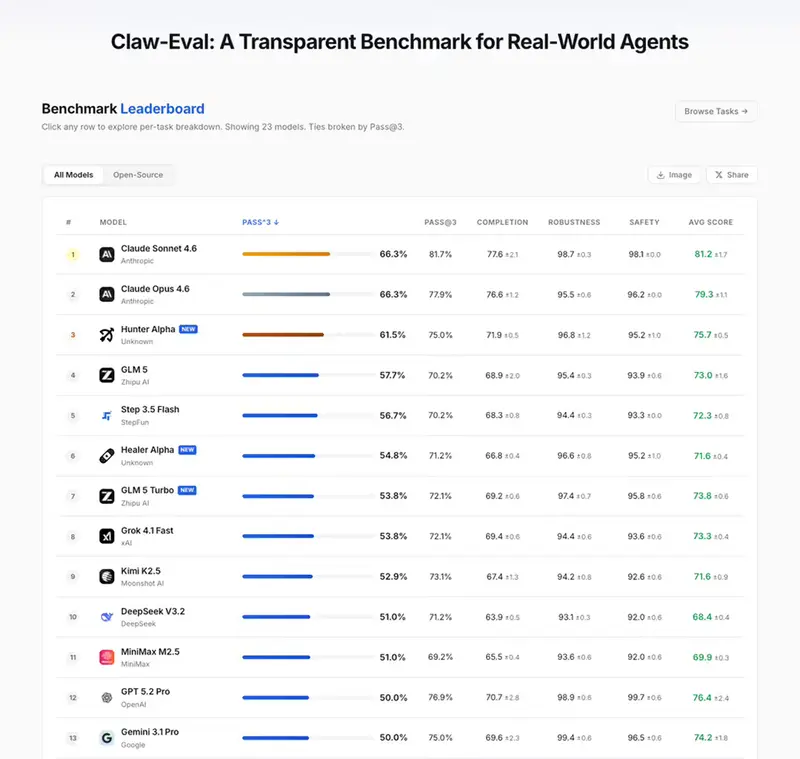

在技术架构上,MiMo-V2-Pro沿用了MiMo-V2-Flash的轻量MTP、滑动窗口注意力和GQA技术,保障了高效的生成速度。在OpenClaw、Claude Code等智能体框架中,该模型可在无人工干预的情况下,完成复杂工作流编排、长程规划与精准工具调用,稳定交付最终结果,整体使用体验已超越Claude Sonnet 4.6,逼近Opus 4.6,而其API定价仅为同类产品的1/5,大幅降低了前沿智能技术的使用门槛。

针对Agent场景,MiMo-V2-Pro完成了针对复杂多样Agent Scaffold的SFT & RL优化,工具调用与多步推理能力大幅提升,在OpenClaw标准评测榜单PinchBench、ClawEval上均达到全球顶尖水平。1M的超大上下文窗口,也让其能够从容支撑高强度的真实Claw复杂应用流。在代码工程构建方面,内部工程师评测显示,MiMo-V2-Pro的使用体验接近Claude Opus 4.6,具备高阶代码智能,拥有更出色的系统设计与任务规划能力、更优雅的代码风格,以及更高效直接的问题解决路径。

目前MiMo-V2-Pro已正式开放API服务,支持1M上下文长度,按使用量分段计价:256K上下文以内,输入$1/百万tokens,输出$3/百万tokens;1M上下文以内,输入$2/百万tokens,输出$6/百万tokens。同时,MiMo Claw模块已全面打通金山WebOffice生态,原生支持Word、Excel、PPT、PDF四大主流文档格式,覆盖超95%的日常文档类型,小米MiMo底层推理引擎与金山办公生态实现框架级集成,WPS灵犀已接入该模型,助力高效办公。

小米MiMo-V2-Omni:Agent时代的全模态基座模型

MiMo-V2-Omni是小米面向Agent时代打造的全模态基座模型,专为现实世界中复杂的多模态交互与执行场景而生,拥有262K上下文长度,支持文本、音频、图片、视频多模态输入,可无缝接入各种Agent框架,实现从理解到操控的能力跨越,大幅降低全模态Agent的落地门槛。该模型针对端侧场景进行了专项优化,多模态感知、工具调用、函数执行及GUI操作能力均为重点优化方向。

在各模态理解能力上,MiMo-V2-Omni表现亮眼:音频理解方面,支持环境声分类、多说话人分离、音频-视觉联合推理,可实现超10小时连续长音频的深度理解,综合表现超越Gemini 3 Pro,成为当前最强的音频理解基座模型之一;图像理解方面,具备强大的多学科视觉推理与复杂图表分析能力,超越Claude Opus 4.6,逼近Gemini 3 Pro等顶尖闭源模型水平;视频理解方面,支持原生音视频联合输入,通过创新视频预训练拥有强大的情境感知与未来推理能力,实现真正的多模态视频理解。

整体而言,MiMo-V2-Omni能够跨模态理解复杂环境,自主制定并执行计划,遇到异常时可实时修正策略,最终端到端交付完整结果。目前该模型已正式开放API服务,输入$0.4/百万tokens,输出$2/百万tokens,同时联合OpenClaw、OpenCode等五大Agent开发框架团队,为全球开发者提供为期一周的限时免费接口支持。

小米MiMo-V2-TTS:Agent时代的全模态交互语音合成模型

MiMo-V2-TTS是小米自主研发、专为Agent时代全模态交互打造的语音合成大模型,基于自研Audio Tokenizer和多码本语音-文本联合建模架构打造,经过上亿小时语音数据的大规模预训练与多维度强化学习,实现了高度可控的多粒度语音风格控制,既能还原人类说话的自然韵律,也能在唱歌时准确表达音高和节奏,自然且富有表现力。

在模型训练阶段,MiMo-V2-TTS首先通过超大规模语音-文本混合预训练,习得强大的跨模态对齐与理解生成的统一能力;再通过少量高质量监督数据微调,获得可泛化的多粒度与多风格指令控制能力;最后引入多维度强化学习,围绕自然韵律、稳定音质、准确字词表达、高质量音色克隆及场景化语气表达等维度持续优化,兼顾模型的稳定性与表现力。得益于多层码本建模架构,模型能在高保真的离散token空间中对语音建模,保留原始语音的丰富信息,让多维奖励信号更有效地作用于生成过程。

MiMo-V2-TTS的核心优势在于支持从整体到局部的多层次语音风格控制,用户可通过自然语言指令设定整体语音基调,同时对句内局部片段进行细粒度情绪调节,实现同一语句中语气转折与情感递变的自然过渡。此外,该模型还具备丰富的多元表达能力,支持东北话、四川话、河南话、粤语、台湾腔等多种方言的自然发音,可进行角色扮演式的风格化演绎,更能实现高质量的歌声合成,让同一个模型兼具“说、演、唱”多种能力。

小米MiMo系列模型均已开放API接入通道,开发者可访问小米MiMo API开放平台(https://platform.xiaomimimo.com),完成API key管理、查看调用规范与参数说明、体验模型能力等操作,快速接入小米MiMo大模型能力。

相关文章