OpenAI 正式推出 GPT-5.4 mini 和 GPT-5.4 nano,将其旗舰模型系列的能力下沉至成本与延迟曲线的底端。这两款新模型专为高吞吐量场景设计,旨在成为编程助手、子智能体(Sub-agents)、截图自动化及大规模数据处理系统的核心引擎。

- 官方介绍:https://openai.com/zh-Hans-CN/index/introducing-gpt-5-4-mini-and-nano

此次发布标志着 OpenAI 平台战略的成熟:GPT-5.4 系列已成为严肃推理、编码和智能体工作负载的默认标准,而 mini 和 nano 则作为高效的执行层,与旗舰模型形成“规划 - 执行”的完美分工。

1. 性能飞跃:小模型的大能量

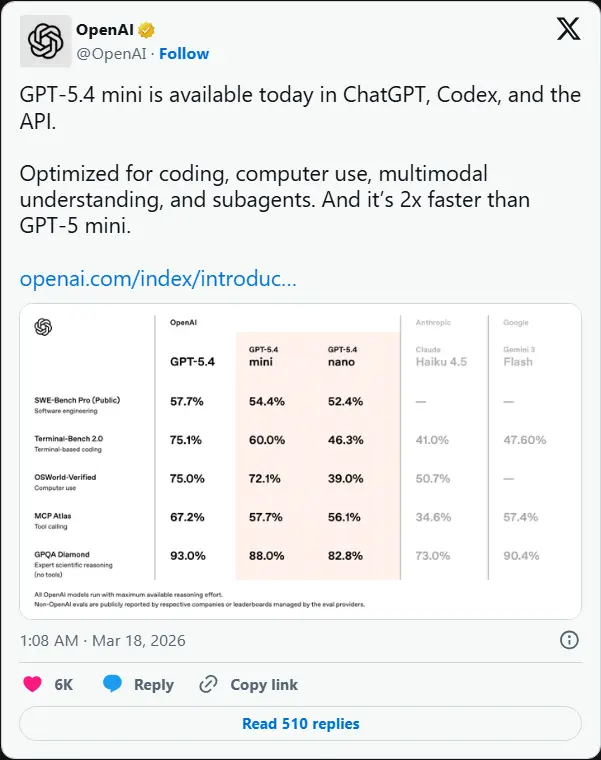

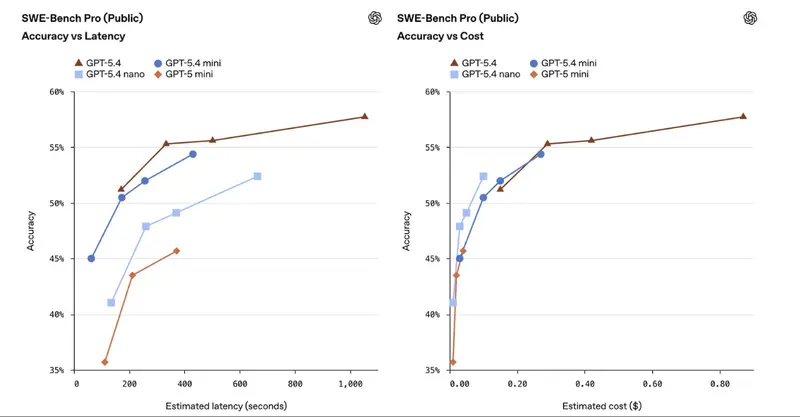

OpenAI 通过基准测试证明,新款小模型在特定任务上已能媲美甚至超越旧款大模型,大幅缩小了与完整版 GPT-5.4 的差距。

- GPT-5.4 mini:

- 速度:运行速度比 GPT-5 mini 快 2 倍以上。

- 编码能力 (SWE-Bench Pro):得分 54.4%,远超 GPT-5 mini 的 45.7%,逼近完整版 GPT-5.4。

- 智能体任务 (OSWorld-Verified):得分 72.1%,几乎是 GPT-5 mini (42.0%) 的两倍。

- 定位:全能型助手,适用于 ChatGPT、Codex 及 API,是构建复杂工作流的主力。

- GPT-5.4 nano:

- 定位:极致轻量级模型,专为分类、提取、排序及轻量级编程支持设计。

- 能力:尽管参数量最小,但在 SWE-Bench Pro 和 Toolathlon 上仍略胜 GPT-5 mini。

- 上下文:与 mini 保持一致,支持 400K 输入 和 128K 输出,支持文本/图像输入、结构化输出及函数调用。

2. 价格屠夫:智能体规模化的关键

此次发布的定价策略极具冲击力,旨在让开发者能够以极低成本大规模部署智能体。

| 模型 | 输入价格 ($/1M tokens) | 输出价格 ($/1M tokens) | 备注 |

|---|---|---|---|

| GPT-5.4 nano | $0.20 | $1.25 | 极致低价,适合海量数据处理 |

| GPT-5.4 mini | $0.75 | $4.50 | 性价比之王,适合主流应用 |

| 参考:GPT-5 mini | $0.15 (旧) | $2.00 (旧) | 性能已被新款全面超越 |

- Codex 集成:在 Codex 中,使用 GPT-5.4 mini 仅消耗 GPT-5.4 配额的 30%,鼓励开发者将其用于代码库搜索、文件审查等高频窄任务。

- ChatGPT 体验:免费版和 Go 版用户可通过“思考”入口使用 mini 模型;高级用户则将其作为 GPT-5.4 思考模式的快速回退选项,以平衡速度与深度。

3. 战略意义:构建“规划 - 执行”分层架构

OpenAI 此举明确了其未来的产品形态:

- 旗舰模型 (GPT-5.4):负责复杂的逻辑推理、长期规划和难题拆解。

- 执行模型 (mini/nano):负责具体的代码生成、数据提取、多步任务中的子任务执行。

这种分层架构使得构建复杂的 多智能体系统 (Multi-Agent Systems) 变得经济可行。开发者可以让昂贵的旗舰模型担任“大脑”,指挥一群廉价的 mini/nano 模型作为“手脚”并行工作,从而在保证智能水平的同时,将整体成本控制在合理范围。

4. 生态响应

- 微软 Azure:反应迅速,已在 Azure AI Foundry 中上线这两款模型(美国区可用,欧盟区即将推出),将其定位为需要近实时检索和操作的生产级智能体低延迟层。

- 早期反馈:Hebbia 等早期客户表示,GPT-5.4 mini 在多项输出任务和引文召回率上,以更低的成本匹配或超越了竞争对手的模型。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...