Kijai 再次发力,为 ComfyUI 社区带来了基于 ICCV 2025 论文《Video Color Grading》的官方实现节点:ComfyUI-VideoColorGrading。

- GitHub:https://github.com/kijai/ComfyUI-VideoColorGrading

- Video Color Grading:https://github.com/seunghyuns98/VideoColorGrading

- 模型:https://huggingface.co/Kijai/VCG_comfy

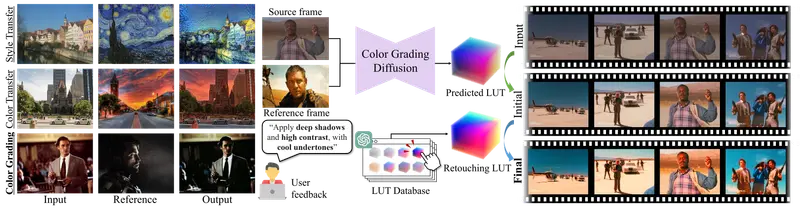

这是一个强大的视频色彩分级工具,它不再依赖简单的滤镜或手动调色,而是利用两阶段扩散过程,智能地从一张参考图像中提取色彩风格,生成专属的 3D 颜色查找表 (3D LUT),并将其一致地应用到整个源视频中。

核心原理

该工作流模拟了专业电影调色的过程,但完全由 AI 自动化完成:

- 风格提取:分析参考图像的色调、对比度、饱和度及光影氛围。

- 3D LUT 生成:利用扩散模型(ReferenceNet + L-Diffuser),结合源视频的帧内容,生成一个定制的 $16^3$ 分辨率的 3D LUT。这确保了色彩转换不仅匹配参考图,还能适应源视频的具体内容,避免色彩断层或失真。

- 一致应用:将生成的 LUT 应用于视频的每一帧,保证整段视频的色彩风格高度统一,无闪烁。

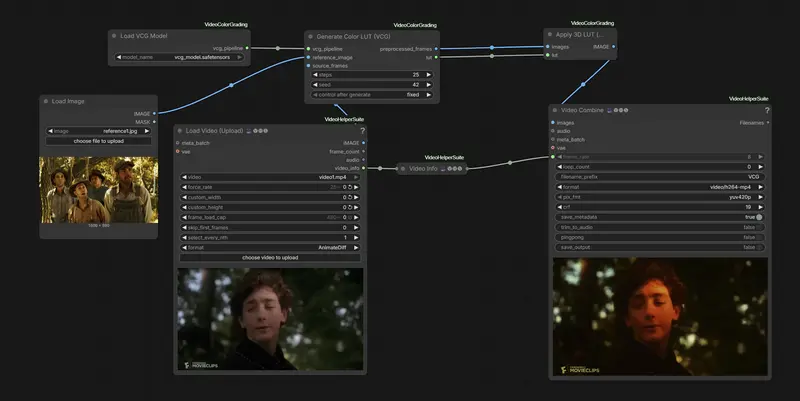

可用节点详解

Kijai 将该流程封装为三个核心节点,方便灵活搭建工作流:

1. Load VCG Model

- 功能:加载 Video Color Grading 所需的组合模型检查点。

- 包含组件:

- CLIP ViT-B/32:用于理解参考图和视频帧的语义内容。

- VAE:负责图像的潜空间编码与解码。

- ReferenceNet:提取参考图像的风格特征。

- L-Diffuser:执行扩散过程以生成平滑的 LUT。

- 用法:通常放在工作流起始位置,只需加载一次即可供后续节点复用。

2. Generate Color LUT (VCG)

- 功能:核心生成节点。

- 输入:

model: 来自 Load VCG Model 的模型。reference_image: 你希望模仿风格的参考图片(如电影截图、摄影作品)。source_frame: 源视频的代表性帧(用于校准 LUT 以适应源内容的动态范围)。

- 输出:一个定制的 3D LUT 数据块。

- 特点:生成的 LUT 分辨率为 $16^3$,在精度和计算效率之间取得了极佳平衡。

3. Apply 3D LUT (VCG)

- 功能:应用节点。

- 输入:

lut: 来自 Generate Color LUT 节点的输出。image: 需要调色的源视频帧(通常连接 Video Load 节点输出的批处理图像)。

- 输出:已完成色彩分级的图像序列。

- 用法:将其放入视频处理循环中,即可对整段视频进行批量调色。

快速上手工作流示例

- 加载模型:放置

Load VCG Model节点。 - 准备素材:

- 使用

Load Image加载你的风格参考图。 - 使用

Load Video(如 ComfyUI-VideoHelperSuite) 加载源视频,并提取第一帧或关键帧作为source_frame。

- 使用

- 生成 LUT:连接

Generate Color LUT (VCG)节点,输入参考图和源帧。 - 应用调色:

- 将

Generate Color LUT输出的lut连接到Apply 3D LUT (VCG)。 - 将

Load Video输出的完整图像批次连接到Apply 3D LUT的image输入。

- 将

- 保存视频:连接

Save Video节点输出最终结果。

安装与依赖

安装方法 (通过 ComfyUI Manager):

- 打开 ComfyUI Manager。

- 点击 "Install Custom Nodes"。

- 搜索

VideoColorGrading或Kijai。 - 找到

ComfyUI-VideoColorGrading并安装。 - 重启 ComfyUI。

模型下载:

首次运行时,节点会自动下载所需的模型文件(通常在 ComfyUI/models/vcg/ 目录下)。如果自动下载失败,可手动从 HuggingFace 仓库下载并放置到对应目录。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...