去年,谷歌发布了 ShieldGemma,这是一套基于 Gemma 2 构建的安全内容分类器模型,旨在检测 AI 模型文本输入和输出中的有害内容。今天,随着 Gemma 3 的亮相,谷歌宣布推出ShieldGemma 2,在负责任 AI 的基础上再进一步。

ShieldGemma 2 基于 Gemma 3 构建,是一个拥有 40 亿(4B)参数的模型,它可以检查合成和自然图像的安全性,针对关键类别,帮助您构建健壮的数据集和模型。有了这个 Gemma 模型家族的新成员,研究人员和开发者现在可以轻松减少模型在以下关键危害领域中的有害内容风险:

性暴露内容 危险内容 暴力内容

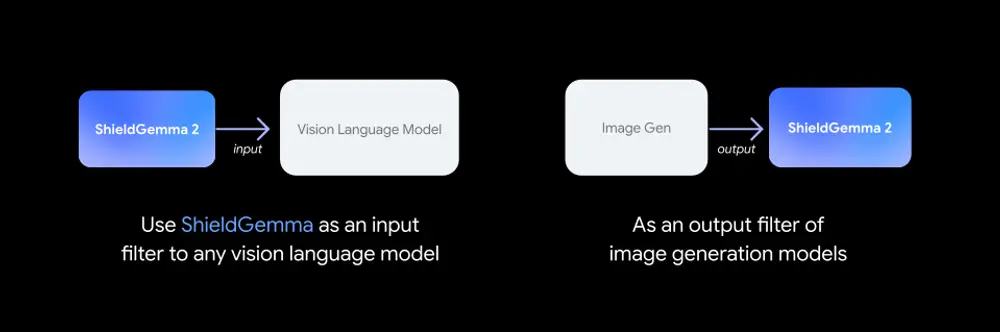

谷歌建议将 ShieldGemma 2 用作视觉语言模型的输入过滤器,或图像生成系统的输出过滤器。ShieldGemma 可用于合成图像和自然图像。

ShieldGemma 2 有何不同?

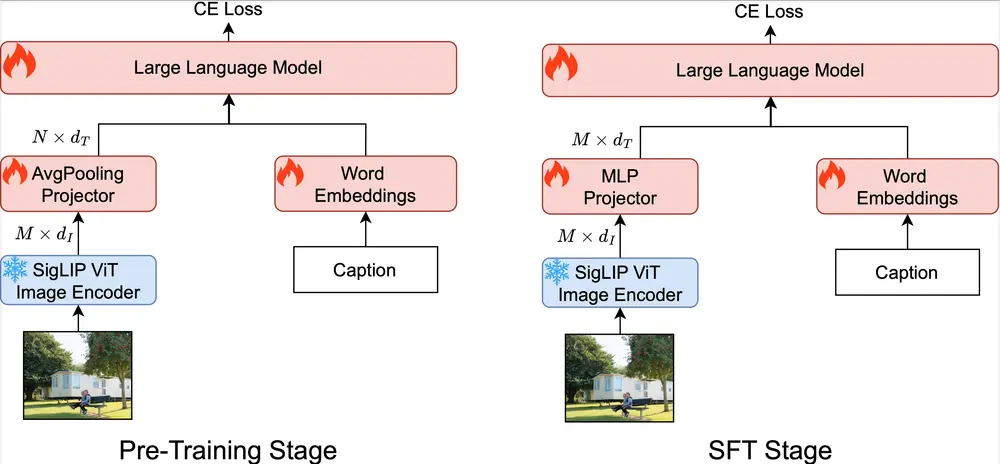

超越文本,在多模态模型中训练和理解图像安全带来了新的挑战,因此 ShieldGemma 2 被设计为能够应对多样化和细腻风格的广泛图像。

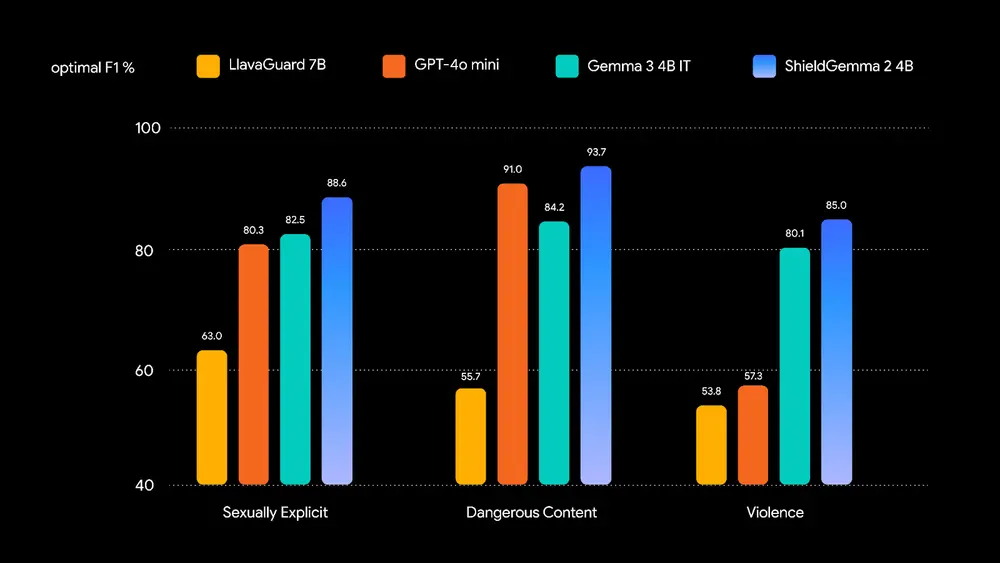

为了训练一个健壮的图像安全模型,谷歌整理了自然和合成图像的训练数据集,并对 Gemma 3 进行了指令调整,以展示其卓越性能。谷歌将安全策略与以下基准进行了比较,并将发布一份技术报告,其中还包括第三方基准。

以下是 ShieldGemma 如何帮助您构建更安全的 AI 图像应用程序:

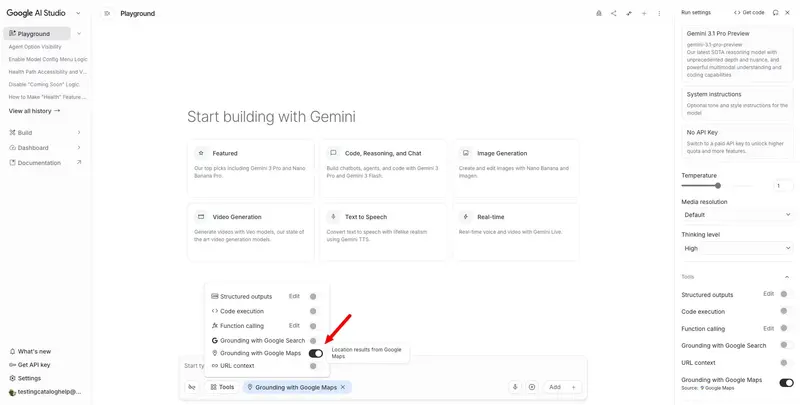

灵活性: 上传任何合成或自然图像,并编辑提示模板以适应您的需求。可在 Google Colab 或您自己的 GPU 上进行微调。 多功能性: 所有支持 Gemma 3 的工具都支持 ShieldGemma 2,包括流行的框架,如 Transformers、JAX、Keras、Ollama 等。 协作性: ShieldGemma 天生开放,欢迎社区合作者共同参与,以包容的方式持续构建,推动行业安全标准不断向前向上发展。

负责任地部署开放模型依赖于整个社区的努力,谷歌期待探索如何在不久的将来将 ShieldGemma 2 开发为更小的规模,覆盖更多危害领域,并与多模态 ML Commons 分类法对齐。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...