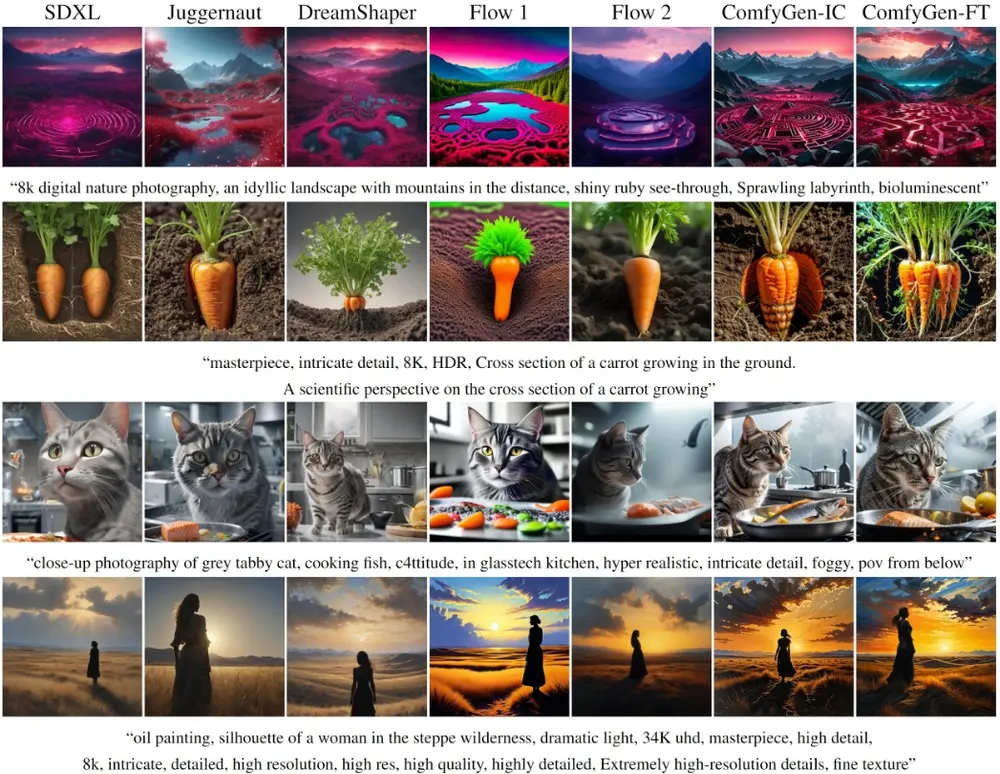

智象未来(HiDream-ai)于2025年4月7日正式开源了HiDream-I1,这是一个拥有170亿参数规模的文生图模型,采用MIT许可证发布,支持个人项目、科学研究以及商用。目前,该模型在多项基准测试中表现出色。

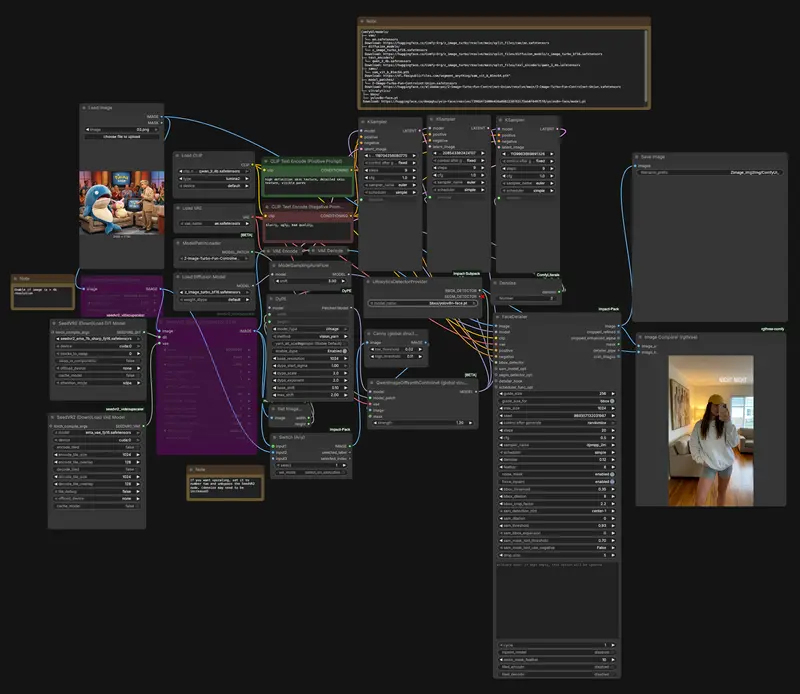

- 工作流:https://www.123865.com/s/hyQyTd-EHHDv 提取码:ZKvp

模型特点

主体基于Diffusion Transformer(DiT),通过双流MMDiT模块处理多模态信息,单流DiT模块优化全局一致性。 动态路由机制灵活分配计算资源,提升复杂场景处理能力,在色彩还原、边缘处理等细节上表现优异。

OpenCLIP ViT-bigG(视觉语义对齐) OpenAI CLIP ViT-L(视觉语义对齐) T5-XXL(长文本解析) Llama-3.1-8B-Instruct(指令理解) 这一组合使其在颜色、数量、空间关系等复杂语义解析上达到SOTA水平,中文提示词支持显著优于同类开源模型。

原始模型版本

智象未来提供了三个版本的HiDream-I1模型,以满足不同场景的需求:

完整版本:HiDream-I1-Full,推理步数为50 蒸馏开发版本:HiDream-I1-Dev,推理步数为28 蒸馏快速版本:HiDream-I1-Fast,推理步数为16

工作流示例

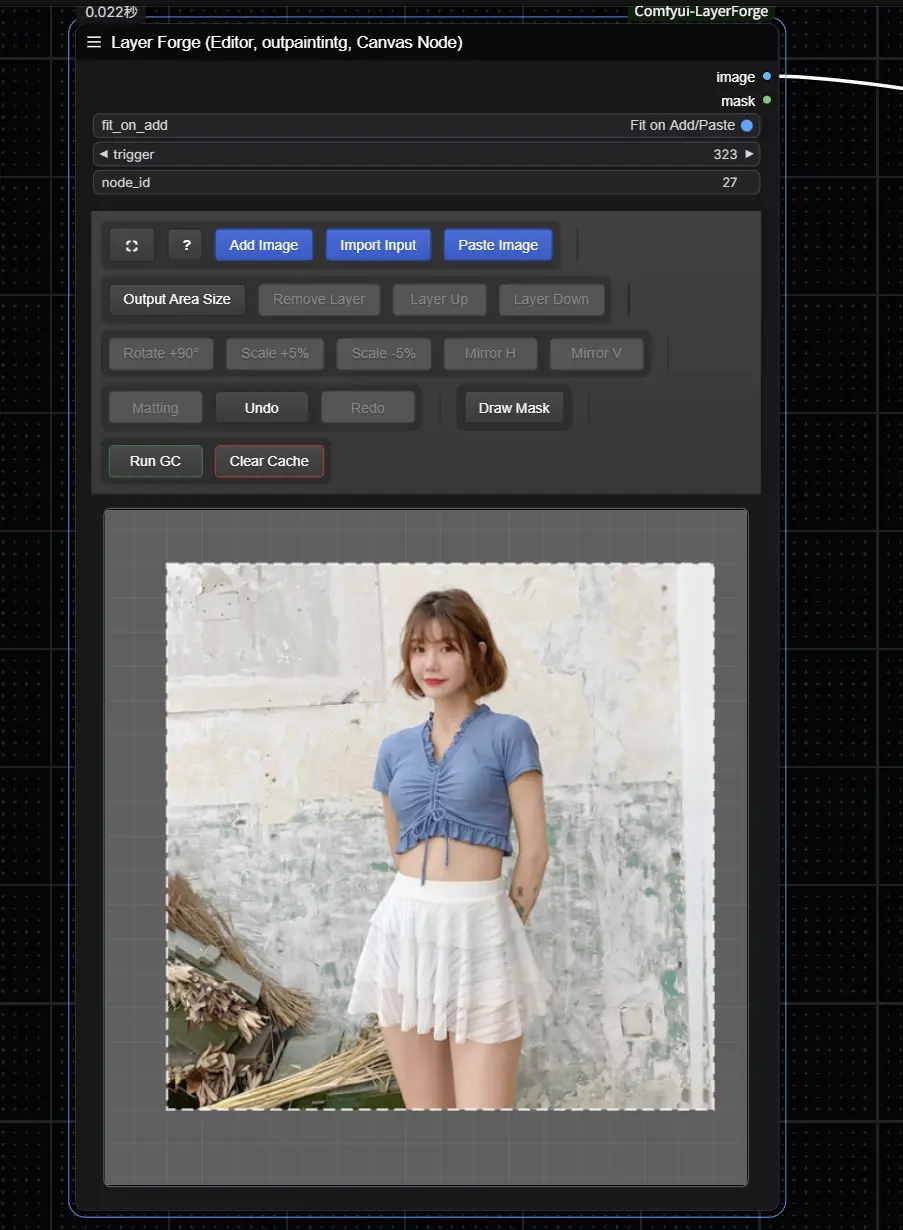

在本篇示例中,将使用ComfyOrg的repackaged版本,所有相关模型文件可在HiDream-I1_ComfyUI仓库中找到。

在开始之前,请确保你的ComfyUI版本至少更新到这个提交之后,以确保你的ComfyUI有HiDream的原生支持。

HiDream-I1工作流

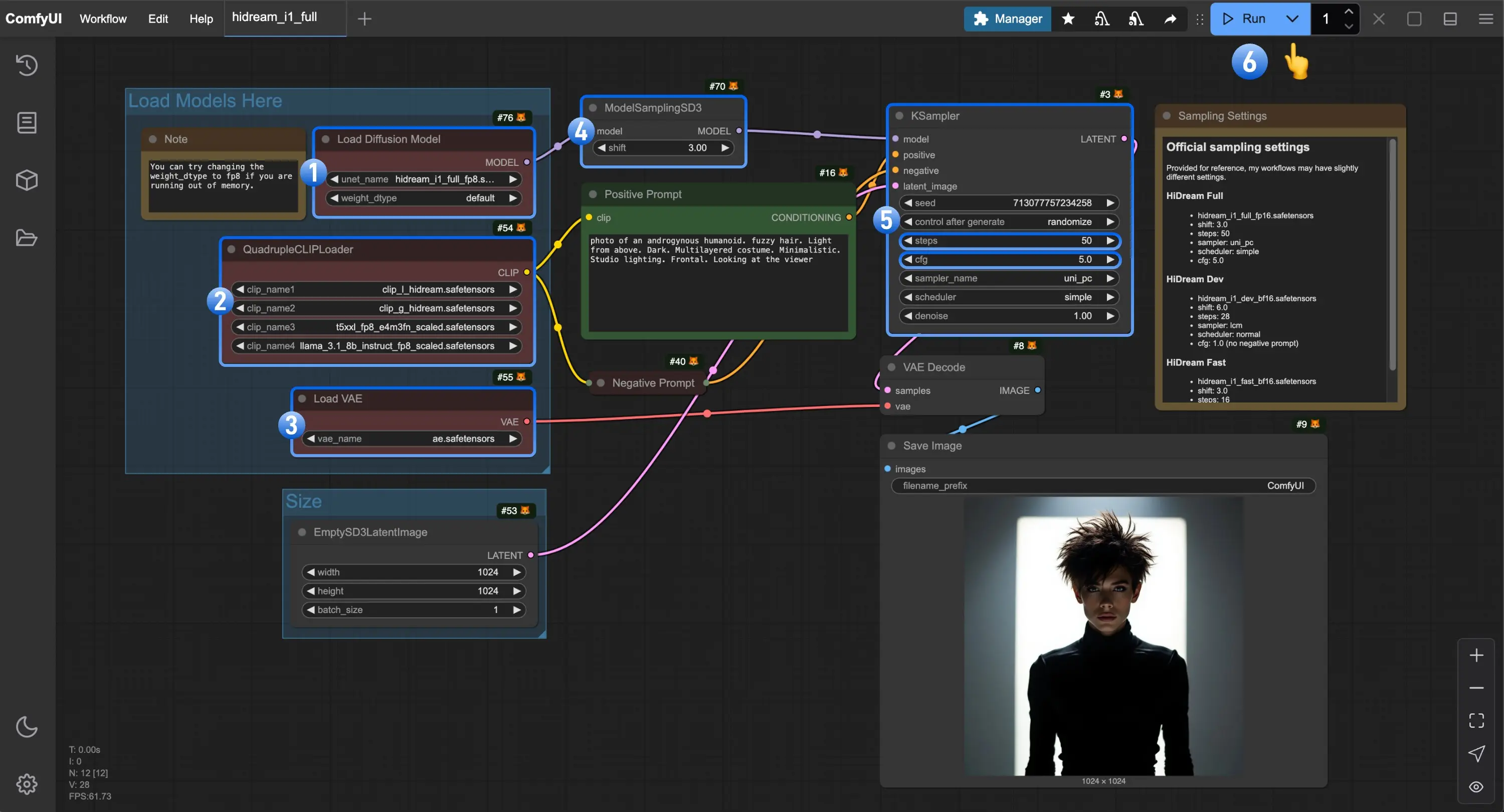

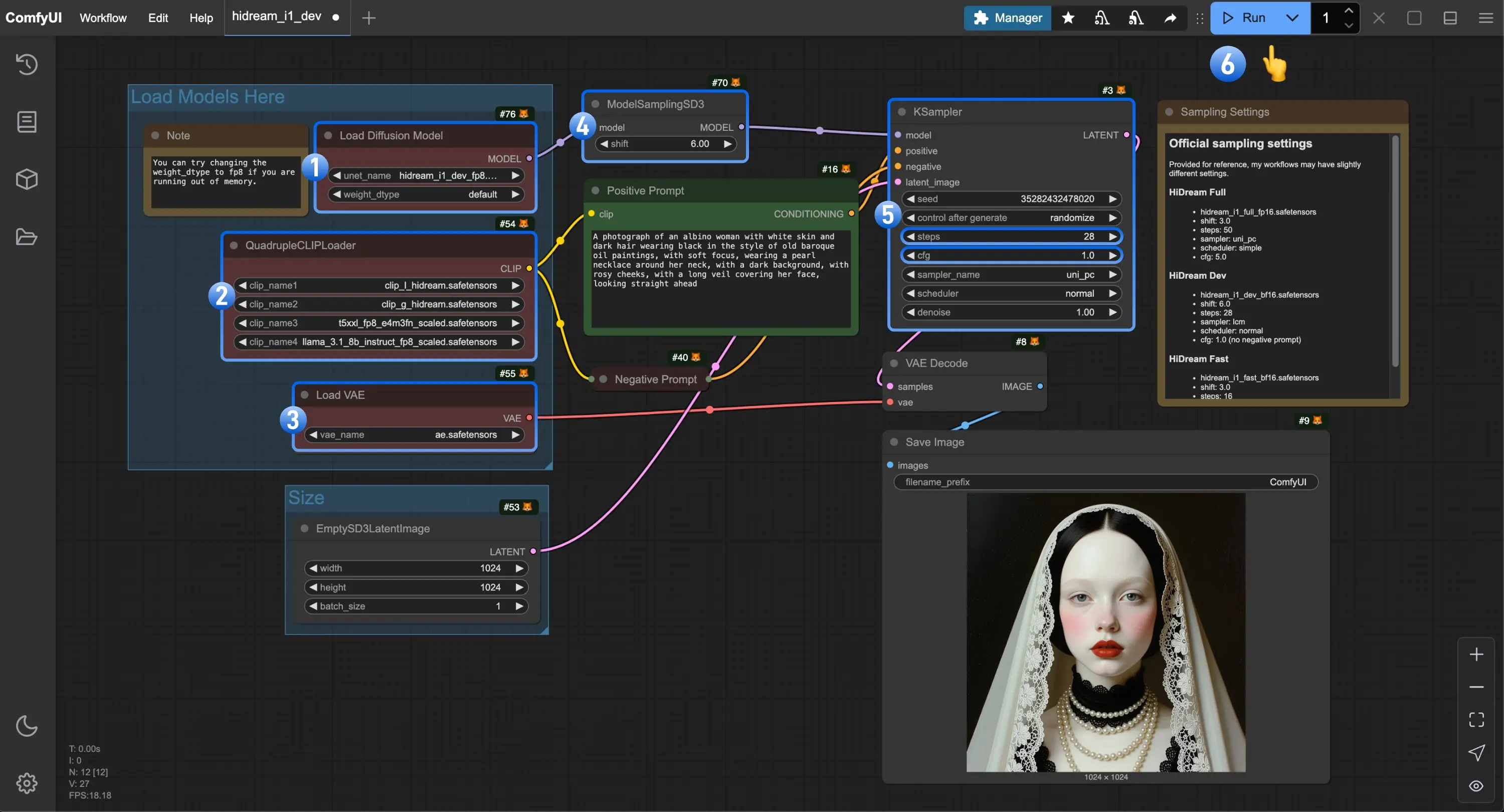

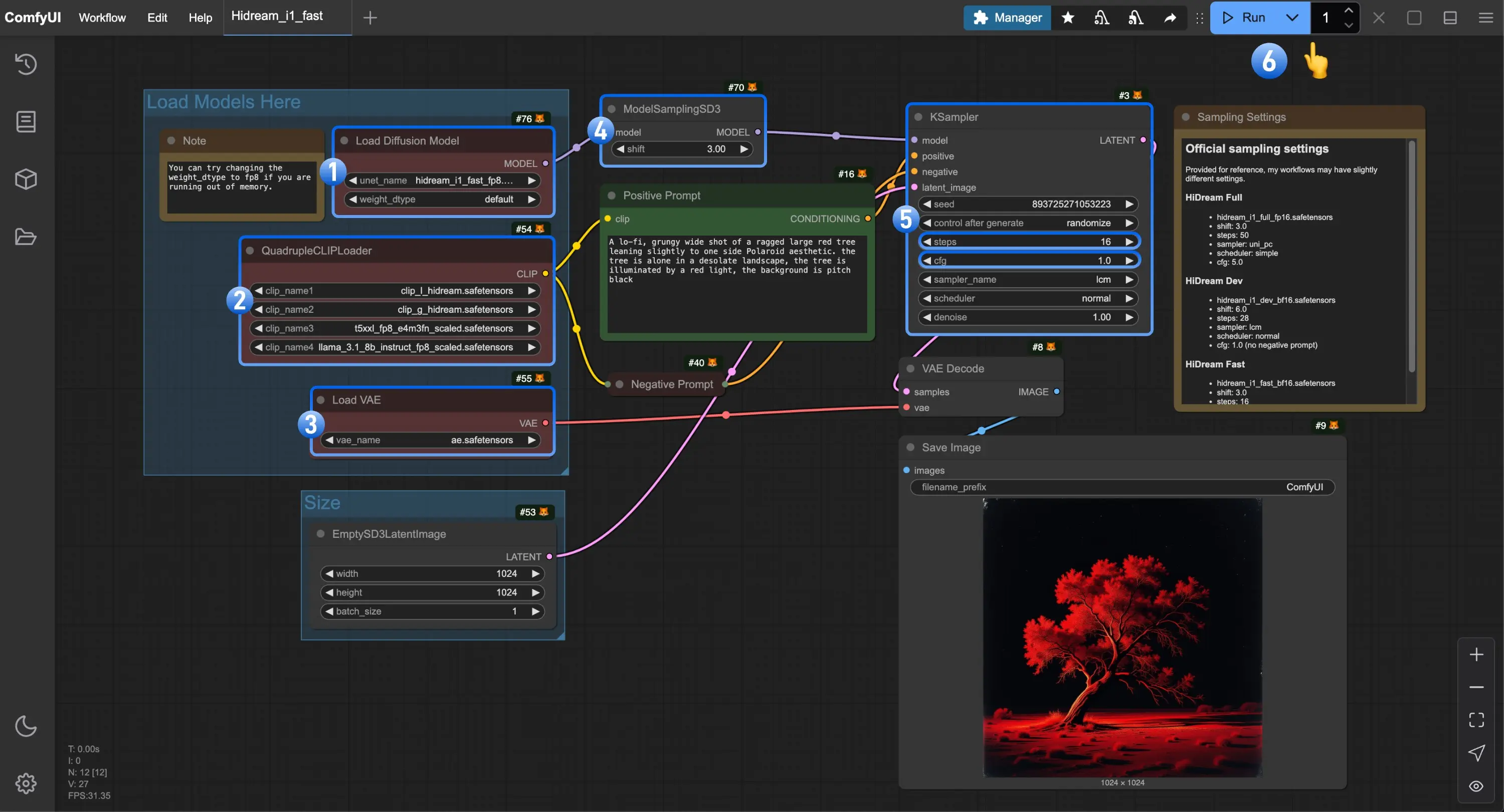

不同ComfyUI原生版本的HiDream-I1工作流模型要求基本相同,只有使用的diffusion models文件不同。以下是不同版本的使用建议:

HiDream-I1-Full:生成质量最高的图像,但对显存要求较高(需要27GB以上显存)。 HiDream-I1-Dev:在生成较高质量的图像的同时,兼顾速度,适合大多数用户。 HiDream-I1-Fast:仅需16步即可生成图像,适合需要实时迭代的场景,对显存要求较低(16GB以上显存)。

对于dev和fast版本,不需要负向提示词,因此在采样时应将cfg参数设置为1.0。

以上三个版本的完整版本对显存要求较高,你可能需要 27GB 以上的显存才能顺利运行。在对应版本的工作流教程中,将会使用 fp8 版本作为示例演示,以保证大多用户都可以顺利运行,不过仍会在对应示例中提供不同版本的模型下载链接,你可以根据你的显存情况来选择合适的文件。

模型安装

以下是共用的模型文件,请点击链接下载并保存到相应位置:

Text Encoders:

clip_l_hidream.safetensors clip_g_hidream.safetensors t5xxl_fp8_e4m3fn_scaled.safetensors(你可能已经下载过此文件) llama_3.1_8b_instruct_fp8_scaled.safetensors

VAE:

ae.safetensors(Flux的VAE模型,如果你之前使用过Flux的工作流,可能已经下载过此文件)

Diffusion Models:这部分将在对应工作流中具体引导下载

📂 ComfyUI/

├── 📂 models/

│ ├── 📂 text_encoders/

│ │ ├─── clip_l_hidream.safetensors

│ │ ├─── clip_g_hidream.safetensors

│ │ ├─── t5xxl_fp8_e4m3fn_scaled.safetensors

│ │ └─── llama_3.1_8b_instruct_fp8_scaled.safetensors

│ └── 📂 vae/

│ │ └── ae.safetensors

│ └── 📂 diffusion_models/

│ └── ... # 将在对应版本的工作流中引导你进行安装 HiDream-I1 Full版本工作流:

FP8版本:hidream_i1_full_fp8.safetensors(需要16GB以上显存) 完整版本:hidream_i1_full_f16.safetensors(需要27GB以上显存) 将下载的模型文件保存到 ComfyUI/models/diffusion_models/文件夹下。

下载工作流图片并拖入ComfyUI中加载。

确保 Load Diffusion Model节点中使用的是hidream_i1_full_fp8.safetensors文件。确保 QuadrupleCLIPLoader中四个对应的text encoder被正确加载:clip_l_hidream.safetensorsclip_g_hidream.safetensorst5xxl_fp8_e4m3fn_scaled.safetensorsllama_3.1_8b_instruct_fp8_scaled.safetensors

确保 Load VAE节点中使用的是ae.safetensors文件。对于 full版本,需要设置ModelSamplingSD3中的shift参数为3.0。对于 Ksampler节点,进行以下设置:steps设置为50cfg设置为5.0(可选) sampler设置为lcm(可选) scheduler设置为normal

点击 Run按钮,或者使用快捷键Ctrl(cmd) + Enter(回车)来执行图片生成。

HiDream-I1 Dev版本工作流:

FP8版本:hidream_i1_dev_fp8.safetensors(需要16GB以上显存) 完整版本:hidream_i1_dev_bf16.safetensors(需要27GB以上显存) 将下载的模型文件保存到 ComfyUI/models/diffusion_models/文件夹下。

下载工作流图片并拖入ComfyUI中加载。

确保 Load Diffusion Model节点中使用的是hidream_i1_dev_fp8.safetensors文件。确保 QuadrupleCLIPLoader中四个对应的text encoder被正确加载:clip_l_hidream.safetensorsclip_g_hidream.safetensorst5xxl_fp8_e4m3fn_scaled.safetensorsllama_3.1_8b_instruct_fp8_scaled.safetensors

确保 Load VAE节点中使用的是ae.safetensors文件。对于 dev版本,需要设置ModelSamplingSD3中的shift参数为6.0。对于 Ksampler节点,进行以下设置:steps设置为28(重要) cfg设置为1.0(可选) sampler设置为lcm(可选) scheduler设置为normal

点击 Run按钮,或者使用快捷键Ctrl(cmd) + Enter(回车)来执行图片生成。

HiDream-I1 Fast版本工作流:

FP8版本:hidream_i1_fast_fp8.safetensors(需要16GB以上显存) 完整版本:hidream_i1_fast_bf16.safetensors(需要27GB以上显存) 将下载的模型文件保存到 ComfyUI/models/diffusion_models/文件夹下。

下载工作流图片并拖入ComfyUI中加载。

确保 Load Diffusion Model节点中使用的是hidream_i1_fast_fp8.safetensors文件。确保 QuadrupleCLIPLoader中四个对应的text encoder被正确加载:clip_l_hidream.safetensorsclip_g_hidream.safetensorst5xxl_fp8_e4m3fn_scaled.safetensorsllama_3.1_8b_instruct_fp8_scaled.safetensors

确保 Load VAE节点中使用的是ae.safetensors文件。对于 fast版本,需要设置ModelSamplingSD3中的shift参数为3.0。对于 Ksampler节点,进行以下设置:steps设置为16(重要) cfg设置为1.0(可选) sampler设置为lcm(可选) scheduler设置为normal

点击 Run按钮,或者使用快捷键Ctrl(cmd) + Enter(回车)来执行图片生成。

使用建议

虽然HiDream-I1支持中文提示词,但建议优先使用英文提示词以保证准确性。 可以使用 fast版本快速生成示例进行验证,然后再用完整版本的模型生成较高质量的图像。

其他相关资源

GGUF版本模型:

HiDream-I1-Full-gguf HiDream-I1-Dev-gguf 使用City96的ComfyUI-GGUF中的 Unet Loader (GGUF)节点替换掉Load Diffusion Model节点来使用GGUF版本模型。

NF4版本模型:

HiDream-I1-nf4 使用ComfyUI-HiDream-Sampler节点来使用NF4版本模型。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...