蚂蚁集团推出基于多模态大语言模型(MLLM)的高性能UI智能体(UI Agent)UI-Venus,它仅以屏幕截图作为输入,通过强化微调(Reinforcement Fine-Tune, RFT)技术,在UI定位(UI Grounding)和导航(UI Navigation)任务上实现了最先进的性能(SOTA)。

- GitHub:https://github.com/inclusionAI/UI-Venus

- 模型:https://huggingface.co/collections/inclusionAI/ui-venus-689f2fb01a4234cbce91c56a

例如,当你使用一个手机应用时,UI-Venus可以根据你的语音指令或文字描述,自动定位到屏幕上的特定按钮或元素(UI Grounding),或者自动完成一系列操作以完成一个任务(如打开一个应用、输入文本、点击按钮等,即UI Navigation)。它就像一个智能助手,能够理解你的指令并直接在图形用户界面中执行相应的操作。

主要功能

- UI Grounding:根据自然语言指令,准确定位屏幕上的UI元素(如按钮、图标等)。

- UI Navigation:根据用户目标,自动规划并执行一系列操作以完成任务,如在应用中导航、输入文本、点击按钮等。

- 多语言支持:支持多种语言的指令,例如在中文和英文界面中都能准确执行任务。

- 复杂任务处理:能够处理复杂的多步骤任务,如在专业软件中完成特定操作。

主要特点

- 高性能:在多个基准测试中,UI-Venus的性能超过了现有的所有开源和闭源模型。

- 数据驱动的训练:通过精心设计的奖励函数和高效的数据清洗策略,使用高质量的训练样本进行强化微调。

- 自进化框架:提出了“自进化轨迹历史对齐与稀疏动作增强”框架,能够动态调整历史推理痕迹,平衡稀疏但关键的动作分布,从而提高复杂UI任务中的规划能力和泛化能力。

- 多模态输入:能够处理多种模态的输入,包括屏幕截图、自然语言指令等,使其能够更好地理解和执行任务。

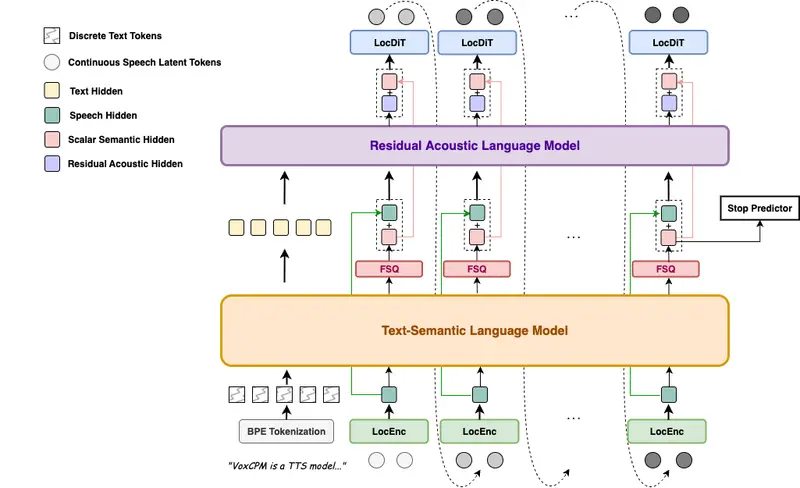

工作原理

- 输入处理:UI-Venus接收屏幕截图和自然语言指令作为输入。

- 强化微调(RFT):基于Qwen2.5-VL模型,通过RFT技术对模型进行微调。RFT利用相对奖励优化策略,通过采样多个轨迹并计算奖励来优化模型的策略。

- 奖励函数设计:为UI Grounding和UI Navigation任务设计了专门的奖励函数,以指导模型学习更准确的定位和导航策略。

- 自进化框架:通过迭代优化历史推理痕迹和增强稀疏动作的采样,使模型能够更好地理解和执行复杂的UI任务。

- 输出执行:模型输出相应的操作指令,如点击、拖动、输入文本等,以完成用户指定的任务。

测试结果

- UI Grounding:

- 在ScreenSpot-V2和ScreenSpot-Pro基准测试中,7B和72B变体分别达到了94.1%/50.8%和95.3%/61.9%的准确率,超过了之前的最佳模型(如GTA1和UI-TARS-1.5)。

- 在OSWorld-G、UI-Vision和CA-GUI等基准测试中,UI-Venus也取得了新的SOTA性能。

- UI Navigation:

- 在AndroidWorld在线UI导航基准测试中,7B和72B变体分别达到了49.1%和65.9%的成功率,超过了现有的所有模型。

- 在AndroidControl和GUI-Odyssey等离线基准测试中,UI-Venus也取得了与现有最佳方法相当的结果。

应用场景

- 自动化测试:自动执行测试脚本,验证应用的功能和性能。

- 智能助手:在手机、电脑等设备上,根据用户指令自动完成任务,如打开应用、输入文本、点击按钮等。

- 专业软件操作:在专业软件(如CAD、Excel等)中,根据用户指令完成复杂的操作。

- 跨语言操作:在多语言界面中,根据用户指令执行任务,支持多种语言的指令。

- 动态交互:在动态环境中(如AndroidWorld)实时交互,根据实时反馈调整策略并完成任务。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...