Rhymes AI推出新型多模态原生模型Aria,这是一个开源的混合专家(MoE)模型,ARIA专门设计来处理和理解多种类型的信息,比如文本、代码、图像和视频,而且它能够像人类一样,不需要特别区分这些不同的信息类型,就能将它们无缝整合在一起。

- 官网:https://rhymes.ai

- GitHub:https://github.com/rhymes-ai/Aria

- 模型:https://huggingface.co/rhymes-ai/Aria

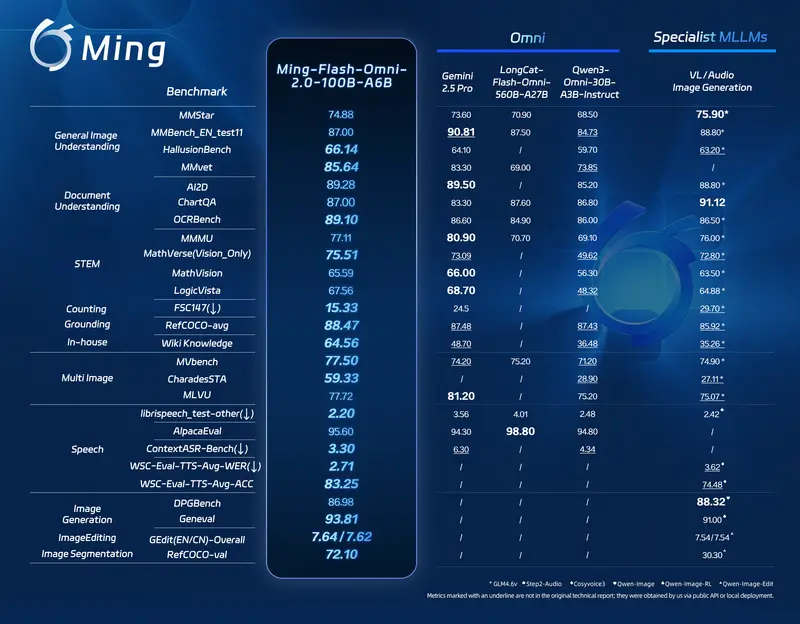

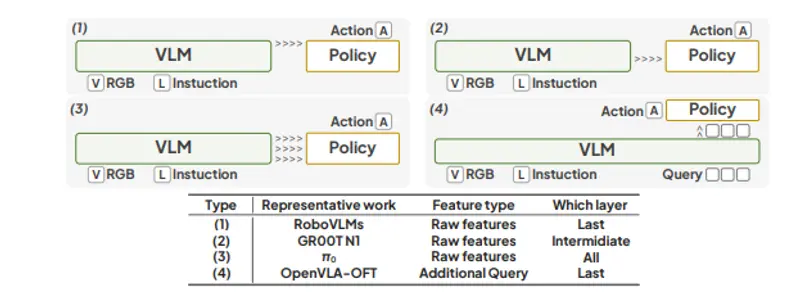

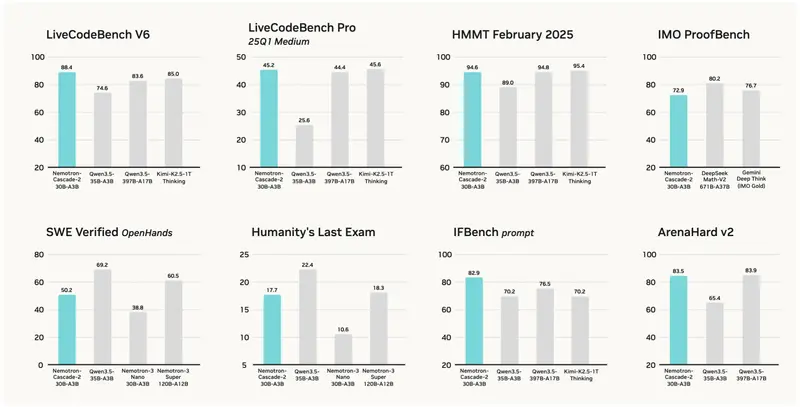

Aria 是一个混合专家模型,每个视觉 Token 和文本 Token 分别激活 3.9B 和 3.5B 参数。它在各种多模态任务中优于 Pixtral-12B 和 Llama3.2-11B,并与最佳的专有模型竞争。Rhymes AI遵循一个四阶段的管道从头开始预训练 Aria,逐步赋予模型强大的语言理解、多模态理解、长上下文窗口和指令跟随能力。

主要功能:

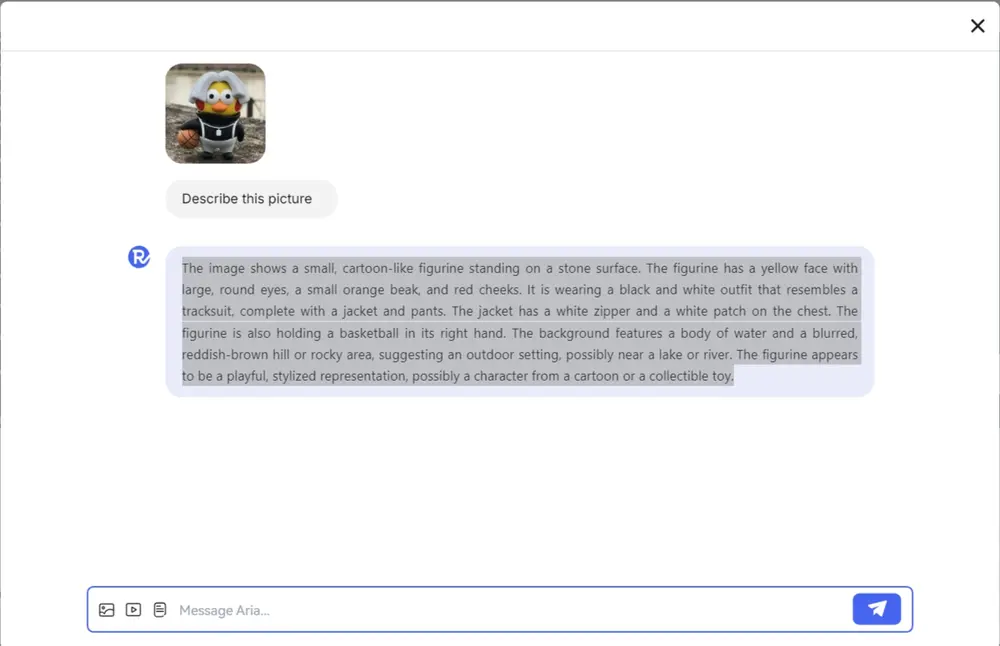

ARIA的主要功能是提供一种全面的理解能力,它能够处理多种输入模态,并且执行各种多模态、语言和编码任务。这包括理解文档内容、识别图像中的场景、阅读和理解代码,甚至还能处理视频内容,比如根据视频内容回答问题。

主要特点:

- 多模态原生:ARIA能够原生地处理多种模态的输入,这意味着它不需要对不同类型的输入进行特别的处理或区分。

- 高性能:在多种多模态任务中,ARIA展现出了超越其他同类模型的性能,甚至能与一些专有模型相媲美。

- 开放性:ARIA的模型权重和代码库都是开源的,这意味着任何人都可以自由地使用、修改和扩展ARIA的功能。

- 高效的训练流程:ARIA通过一个四阶段的训练流程进行预训练,这个流程逐步增强了模型在语言理解、多模态理解、长上下文窗口和指令跟随方面的能力。

工作原理:

ARIA的工作原理基于以下几个关键组件:

- 混合专家模型:ARIA使用了一个精细的混合专家解码器,这使得它在训练和推理时比传统的密集型解码器更快,因为专家的专业化使得参数利用更加高效。

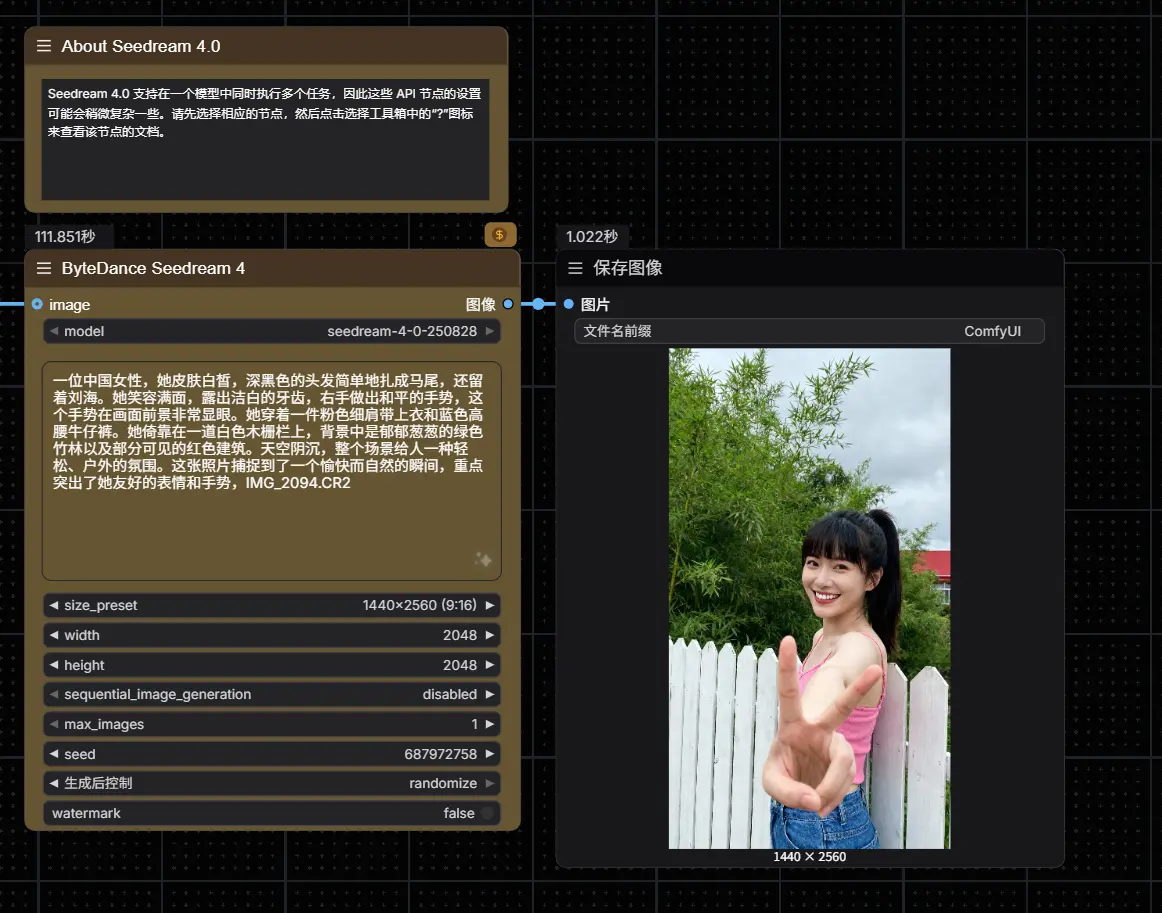

- 视觉编码器:ARIA有一个轻量级的视觉编码器,它能够将图像或视频帧转换成与词嵌入相同特征维度的视觉令牌,从而使得模型能够无缝整合视觉和语言输入。

- 长上下文窗口:ARIA能够处理长达64k令牌的长上下文,这使得它能够有效处理复杂的长文本或视频数据。

具体应用场景:

ARIA的应用场景非常广泛,包括但不限于:

- 教育:ARIA可以帮助创建教育内容,比如根据教科书中的描述生成教学视频。

- 研究:研究人员可以使用ARIA来分析大量的研究数据,比如科学论文中的图表和图像。

- 娱乐:在娱乐行业,ARIA可以用来生成视频内容,比如根据剧本自动生成电影场景。

- 辅助设计:设计师可以利用ARIA来理解设计需求,并生成相应的视觉概念图。

总的来说,ARIA是一个强大的多模态模型,它能够理解和处理多种类型的信息,为各种需要多模态理解的应用提供了强大的支持。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...