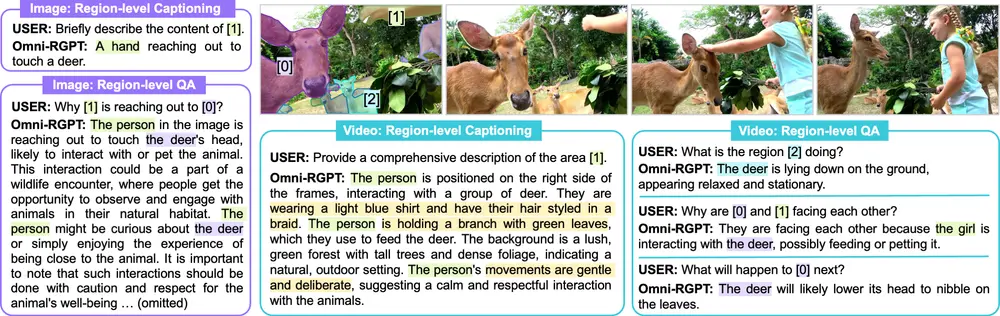

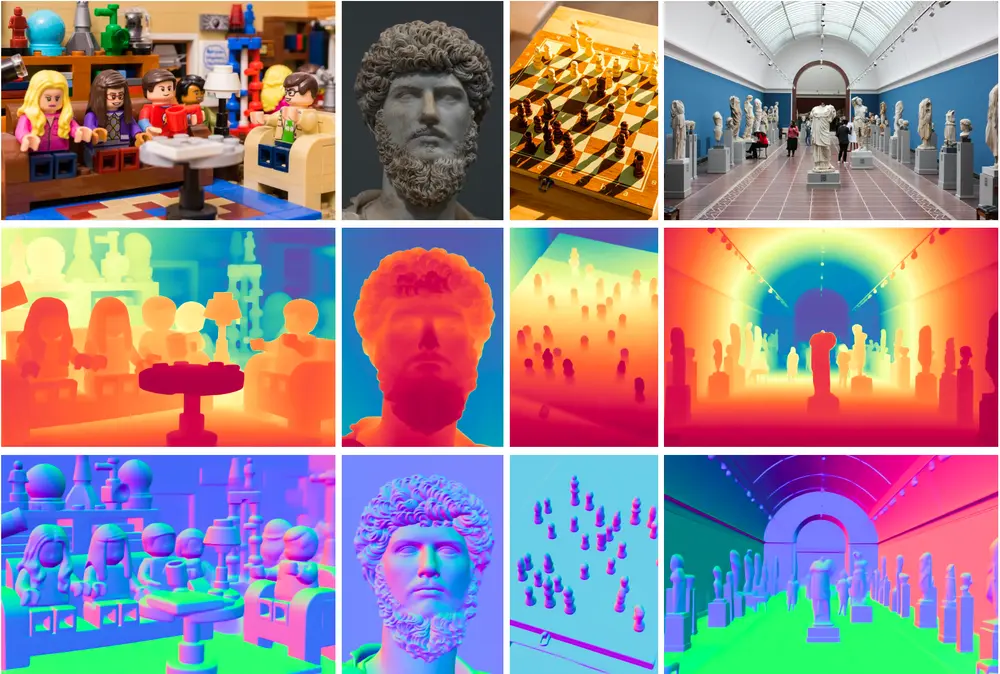

亚琛工业大学和埃因霍温理工大学的研究人员推出diffusion-e2e-ft,通过微调图像条件扩散模型来简化和提高单目深度估计的效率。单目深度估计是指仅使用一张图片来预测场景中每个像素的深度信息。这项技术在许多领域都有应用,比如图像和视频编辑、场景重建、新视角合成以及机器人导航等。

- 项目主页:https://gonzalomartingarcia.github.io/diffusion-e2e-ft

- GitHub:https://github.com/VisualComputingInstitute/diffusion-e2e-ft

- Demo:https://huggingface.co/spaces/GonzaloMG/diffusion-e2e-ft

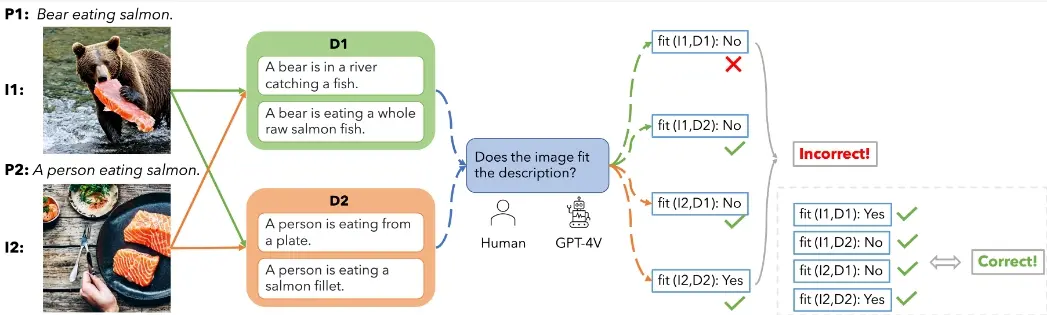

为了优化下游任务的性能,研究人员在单步模型上进行了端到端的微调,并使用特定于任务的损失,得到了一个确定性模型,该模型在常见的零样本基准测试中优于所有其他基于扩散的深度和法线估计模型。研究人员惊讶地发现,这种微调协议也可以直接应用于Stable Diffusion,并且实现了与当前最先进的基于扩散的深度和法线估计模型相当的性能,这使之前工作中的一些结论受到质疑。

主要功能:

- 单步推断:通过改进模型的推断流程,使得原本需要多步计算的过程可以一步完成,大大提高了速度。

- 端到端微调:通过特定的任务损失函数对模型进行微调,以提高特定任务的性能。

主要特点:

- 速度提升:修复了模型的一个关键缺陷后,使得模型的推断速度提高了200倍以上。

- 简单有效:研究表明,简单的端到端微调就可以达到与更复杂的模型相媲美的性能。

- 多模态输入:模型可以接受文本、图像和3D条件作为输入,使其在多种场景下都能发挥作用。

工作原理:

这个模型使用了一种叫做扩散模型的技术,这种技术通过逐步去除噪声来生成数据。在这项工作中,研究人员发现,之前的方法在进行单步推断时效果不佳,是因为推断流程中存在一个未被注意到的错误。通过修正这个错误,模型在单步推断中就能产生合理的预测结果。此外,研究人员还通过端到端的微调,进一步提升了模型在特定任务上的性能。

具体应用场景:

- 自动驾驶:在自动驾驶系统中,可以用来实时估计车辆与周围物体的距离。

- 虚拟现实:在虚拟现实中,可以用来生成更加真实的3D环境。

- 增强现实:在增强现实中,可以用来精确地将虚拟对象放置在现实世界中的正确位置。

- 机器人导航:帮助机器人理解其周围的空间环境,以避免碰撞并规划路径。

总的来说,这篇论文提出了一种改进的图像条件扩散模型,通过修复一个关键的推断错误并进行端到端的微调,使得模型在单目深度估计任务上既快速又准确。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...