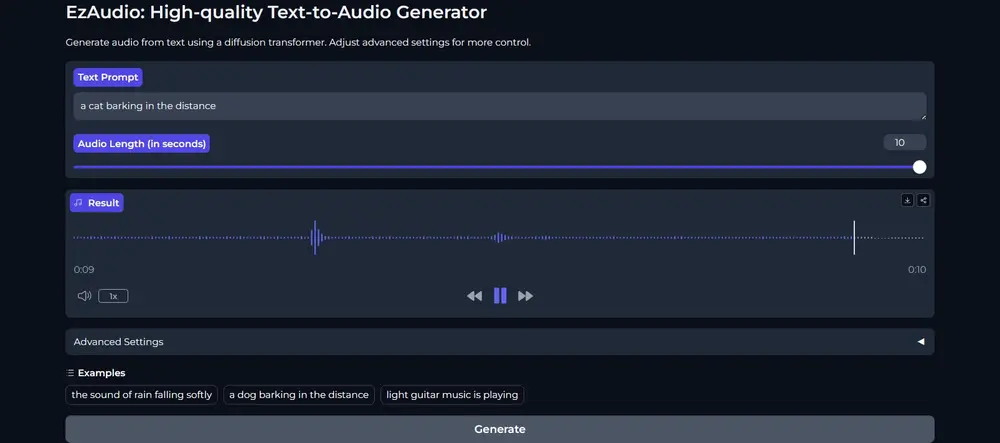

约翰·霍普金斯大学和腾讯人工智能实验室的研究人员推出一种新型的文本到音频(Text-to-Audio,简称T2A)生成技术EzAudio,这项技术的目标是将文本描述转换成相应的音频内容,比如将“一只狗在叫”这样的文本描述转换成狗叫的声音。

- 项目主页:https://haidog-yaqub.github.io/EzAudio-Page

- GitHub:https://github.com/haidog-yaqub/EzAudio

- Demo:https://huggingface.co/spaces/OpenSound/EzAudio

EzAudio是一种基于Transformer的T2A扩散模型,以应对这些挑战。EzAudio包括几个关键创新:(1)研究团队在1D波形变分自编码器(VAE)的潜空间上构建T2A模型,避免了处理2D光谱图表示的复杂性并使用额外的神经声码器。(2)研究团队设计了一种优化的DIT架构,专门针对音频潜表示和扩散建模,这增强了收敛速度、训练稳定性和内存使用,使训练过程更容易、更高效。(3)为了解决数据稀缺问题,研究团队采用了一种数据高效训练策略,利用未标记数据学习声学依赖关系,利用音频-语言模型注释的音频字幕数据进行文本到音频对齐学习,并使用人工标记数据进行微调。(4)研究团队引入了一种无分类器引导(CFG)重缩放方法,通过在较大的CFG分数下实现强大的提示对齐同时保持优秀的音频质量来简化EzAudio,从而消除了寻找平衡这一折衷的最优CFG分数的困扰。EzAudio在客观指标和主观评估方面超越了现有的开源模型,提供了真实的聆听体验,同时保持了简洁的模型结构、低训练成本和易于遵循的训练流程。

主要功能:

EzAudio的主要功能是将文本信息转换为音频。这就像是一个能“听懂”文字并“唱”出来的机器。

主要特点:

- 高效转换:它使用了一种特殊的变换器(Diffusion Transformer),这种变换器在处理音频时既快速又高效。

- 高质量音频:生成的音频听起来非常自然,接近真实的声音。

- 简化训练:通过使用未标记的数据和一些特殊的训练策略,EzAudio可以更容易地学习如何将文本转换为音频。

- 易于使用:它的设计使得研究人员和开发者能够轻松地使用和集成这项技术。

工作原理:

EzAudio的工作原理可以分为几个步骤:

- 文本编码:首先,它读取并理解输入的文本描述。

- 扩散模型:然后,它使用一个基于变换器的模型来逐步从随机噪声中生成音频的潜在表示(就像从一团乱麻中找到头绪)。

- 波形VAE:最后,它通过一个称为变分自编码器(VAE)的模型将这些潜在表示转换成我们可以听到的音频波形。

具体应用场景:

- 语音合成:可以用于生成有声书中的旁白或者为视频游戏的角色配音。

- 音频内容创作:帮助音乐家和音频设计师快速原型设计和创作新的声音效果。

- 辅助技术:为视障人士提供文本到语音的服务,比如将书籍或网页内容转换成语音。

- 语言学习:帮助语言学习者通过听到正确的发音来学习新单词或短语。

总的来说,EzAudio就像是一个高级的语音合成器,它能够将文字描述转换成听起来非常自然的音频,这在很多领域都有广泛的应用前景。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...