视觉-语言模型(Vision-Language Models, VLMs)如 LLaVA、Qwen-VL 等,在图像理解、视觉问答和图文生成等任务中表现优异。这些模型通常依赖一个核心流程:将图像通过视觉编码器提取特征后,再通过一个“连接器”(projector)映射到语言模型的嵌入空间,实现跨模态对齐。

- 论文地址:https://arxiv.org/abs/2509.11986

- GitHub:https://github.com/lyan62/vlm-info-loss

但在这个看似顺畅的过程中,图像中的部分视觉信息可能在投影阶段悄然丢失。这种“隐形损耗”虽不显眼,却可能直接影响模型的理解能力——比如看不清细节导致回答错误,或遗漏关键区域影响字幕生成。

然而,这一问题长期缺乏系统评估。近期,来自哥本哈根大学、微软和剑桥大学的研究团队发表论文,首次提出一套可量化、可分析视觉-语言模型中信息丢失的方法,为理解这类模型的行为提供了新视角。

为什么信息会丢失?

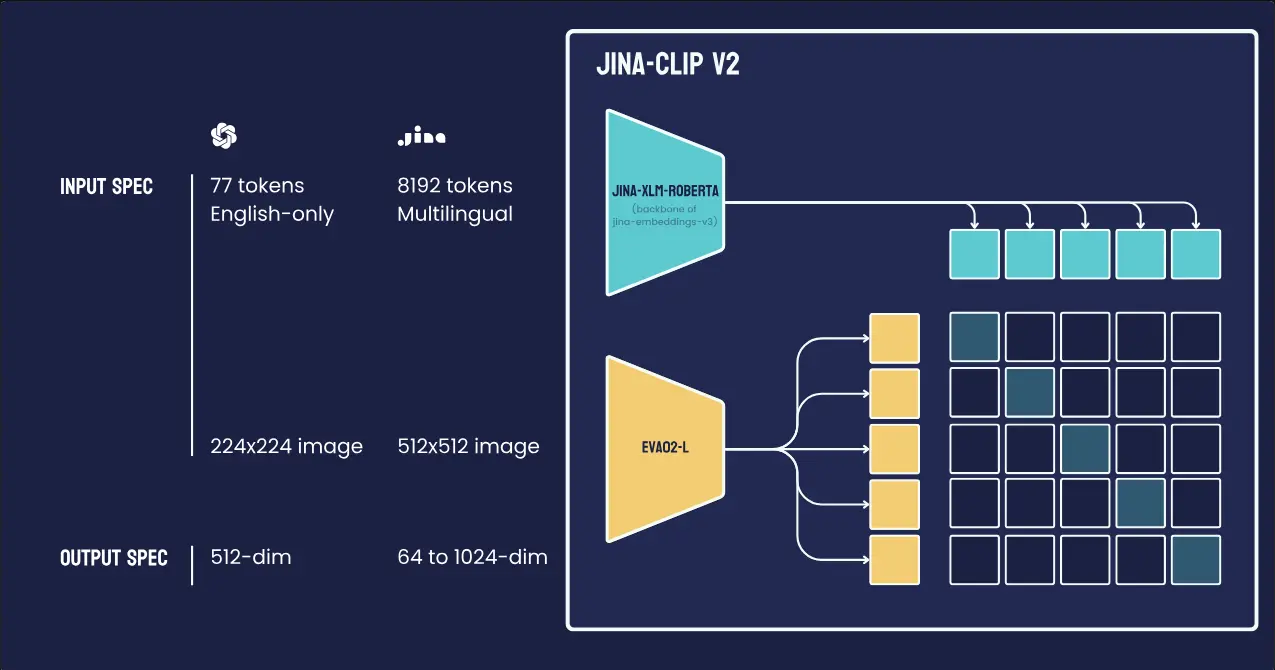

VLM 的典型架构包含两个主要组件:

- 视觉编码器(如 CLIP 的 ViT):负责从图像中提取视觉特征;

- 投影模块(Projector):将高维视觉特征转换为语言模型能处理的嵌入表示。

由于语言模型的嵌入空间是为文本设计的,其结构和分布与原始视觉空间存在差异。因此,当视觉特征被强行“压缩”进该空间时,部分语义或几何信息可能发生扭曲甚至丢失。

过去研究多关注最终任务性能,而忽视了这一中间过程的信息保真度。本文填补了这一空白,提出了两种互补的分析方法。

方法一:k-最近邻重叠比率(KNOR)

衡量局部结构是否被保留

该方法关注的是:图像在视觉空间中的“邻居关系”在投影后是否依然成立。

具体步骤如下:

- 提取每张图像在视觉编码器输出层的嵌入向量;

- 在原始视觉空间中,计算每个图像的 k 个最近邻;

- 将所有图像嵌入经过 projector 映射后,再次计算其在目标嵌入空间中的 k 个最近邻;

- 比较前后两次邻居集合的重叠比例,即 k-NN Overlap Ratio(KNOR)。

解释:若某图像在原始空间中与猫最相似,但在投影后变成了狗的邻居,说明其语义位置发生了偏移——这意味着信息丢失。

发现:

- 多数模型的 KNOR 值介于 40%–60%,表明近半数的邻域关系已被破坏;

- 在 SeedBench 验证集上,LLaVA 的 KNOR 达 61.6%(k=100),相对较好;

- Qwen2.5-VL 的 KNOR 接近 0,意味着其图像嵌入的局部结构几乎完全重构。

这提示我们:即使模型整体性能良好,也可能以牺牲视觉结构一致性为代价。

方法二:嵌入重构

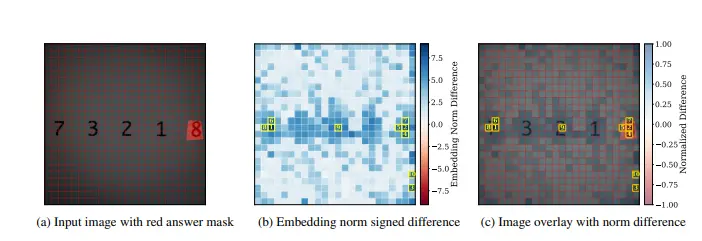

直接测量信息损失程度,并定位到图像块级别

如果说 KNOR 是间接评估,那么“嵌入重构”则是直接探测信息丢失的“探针”。

做法如下:

- 训练一个轻量级神经网络,尝试从 projector 输出的嵌入中反向重构出原始视觉嵌入;

- 使用重构误差(如 MSE)作为信息丢失的度量;

- 将误差回溯至图像的各个 patch(图像块),生成“信息丢失热图”。

优势:不仅能知道“有没有丢”,还能知道“哪里丢了”。

结果表明:

- LLaVA 的平均重构误差最低,说明其 projector 更好地保留了原始视觉信息;

- 重构误差高的图像块往往对应图像中的边缘区域或纹理复杂部位;

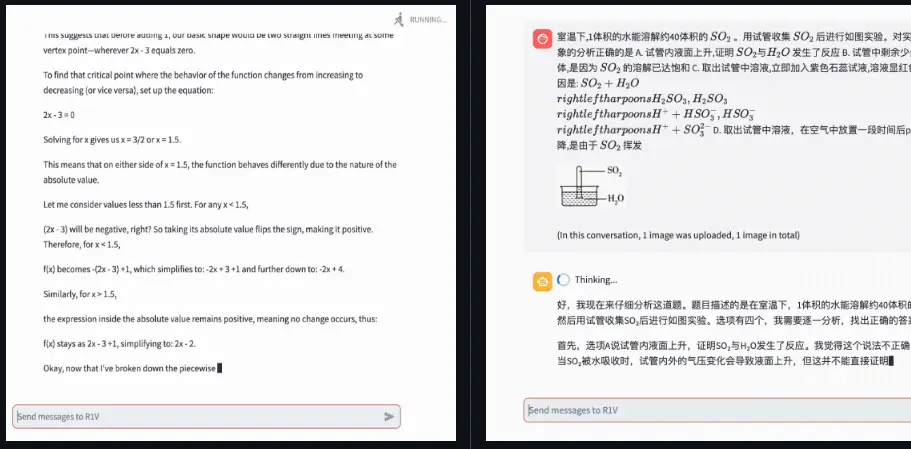

- 更重要的是,高误差区域与视觉问答任务中的错误答案显著相关。

例如,在 VizWiz Grounding 数据集中,模型未能识别出用户标注的问题区域时,这些区域恰好也是重构误差最高的部分。

信息丢失影响了哪些任务?

研究人员进一步验证了信息丢失对下游任务的实际影响:

| 任务 | 影响表现 |

|---|---|

| 视觉问答(VQA) | 信息丢失严重的图像,模型回答准确率明显下降;错误常源于忽略关键物体或误判属性。 |

| 图像检索 | 使用投影后嵌入进行检索时,在 CUB-200-2011 鸟类数据集上的召回率下降达 15%以上。 |

| 图像字幕生成 | COCO 和 Flickr30k 实验显示,重构误差越低,生成字幕的 BLEU 和 CIDEr 分数越高。 |

这些结果共同说明:投影过程不是无损通道,而是潜在瓶颈。

可能的应用方向

这项工作不仅是诊断工具,也为改进模型提供了实用路径:

- 连接器优化设计

可在预训练阶段引入重构损失(reconstruction loss),约束 projector 尽量保留原始视觉结构。 - 模型选择与调试

利用 KNOR 和重构误差作为评估指标,辅助判断不同 projector 架构的有效性。 - 可解释性增强

通过可视化信息丢失热图,帮助开发者理解模型为何“看不清”某些区域。 - 任务适配策略

对信息敏感的任务(如医学图像问答),可优先选用信息保留能力强的模型结构。

相关文章