阿里巴巴推出一款名为 QVQ-Max 的全新视觉推理模型,这是其 Qwen模型系列中的最新成员。QVQ-Max 的独特之处在于它能够理解照片和视频的内容,并对这些信息进行分析和推理,从而提供解决方案。

核心功能与应用场景

视觉推理能力

QVQ-Max 的核心优势在于其强大的视觉推理能力。它能够“看见”、“理解”并“思考”世界中的事物,通过解析图像和识别关键元素,提供深度分析和解决方案。具体应用场景包括:

- 插图设计:帮助设计师快速生成创意插图。

- 视频脚本生成:根据视频内容生成脚本,提升内容创作效率。

- 角色扮演:为角色扮演游戏提供视觉和逻辑支持。

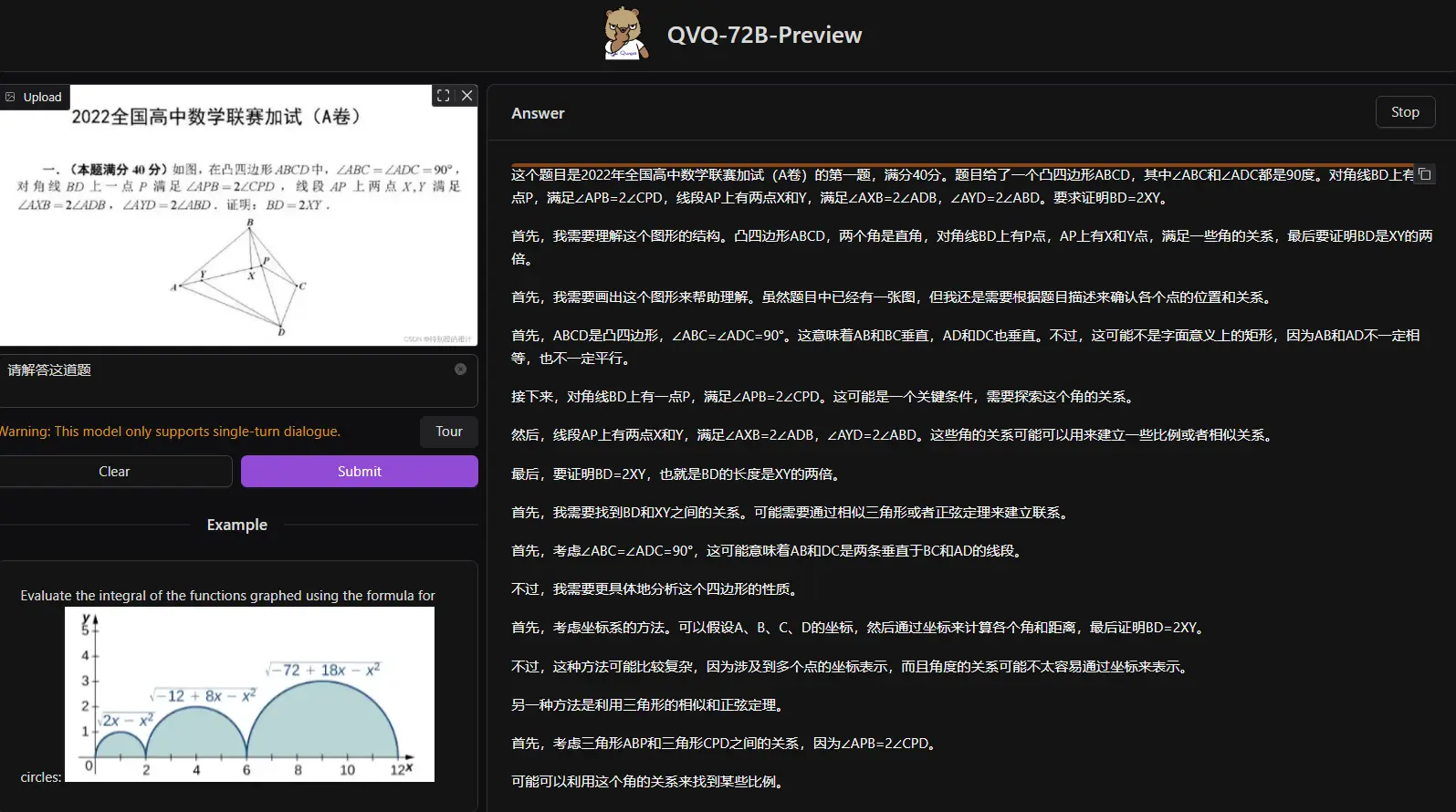

- 教育辅助:解决附带图表的数学和物理问题,辅助教学。

- 烹饪指导:根据食谱图片指导用户烹饪。

多领域应用

与其他 AI 聊天机器人类似,QVQ-Max 不仅可以帮助用户完成工作、教育或个人生活中的任务,还能在更多领域发挥作用。例如:

- 解决复杂问题:通过视觉分析,解决复杂的图表和数据问题。

- 操作设备:帮助用户操作手机和电脑,甚至玩游戏。

- 内容创作:生成高质量的视觉内容,提升创作效率。

未来发展方向

阿里巴巴表示,QVQ-Max 目前只是第一个迭代版本,未来将进行多项改进:

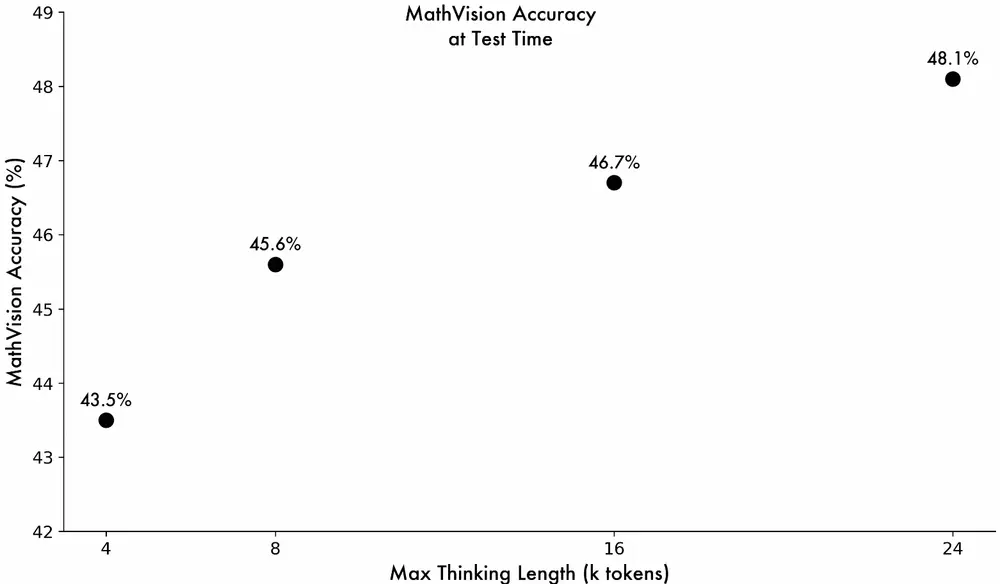

- 提高图像识别准确性:通过“grounding技术”验证观察结果,提升图像识别的准确性。

- 处理多步骤任务:增强模型处理多步骤任务和复杂问题的能力,使其能够操作设备、玩游戏等。

- 扩展交互功能:从仅支持基于文本的交互扩展到包括工具验证和视觉生成的功能,进一步提升用户体验。

如何使用 QVQ-Max

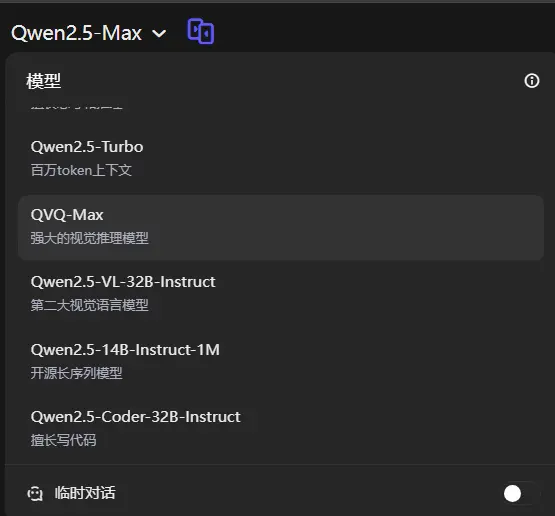

要开始使用 QVQ-Max,用户可以访问 chat.qwen.ai,点击左上角的模型下拉菜单,选择“Expand more models”(展开更多模型),并选中 QVQ-Max。进入聊天框后,用户可以上传视觉内容(如图片或视频),体验其强大的视觉推理能力。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...