今天,Cohere 推出了 Command A,一款专为企业设计的新型先进生成模型,旨在满足企业对快速、安全和高质量 AI 的高要求。Command A 在性能、效率和企业级功能上表现出色,是市场上最高效、最具性价比的 AI 模型之一。

- 模型:https://huggingface.co/CohereForAI/c4ai-command-a-03-2025

- Ollama:https://ollama.com/library/command-a

高性能,低计算需求

Command A 在代理型企业任务上的表现与 GPT-4o 和 DeepSeek-V3 持平或更优,同时显著降低了硬件成本。对于私有部署,Command A 只需两块 GPU 即可运行,而其他模型通常需要多达 32 块。这意味着企业可以在更低的硬件成本下获得更高的性能。

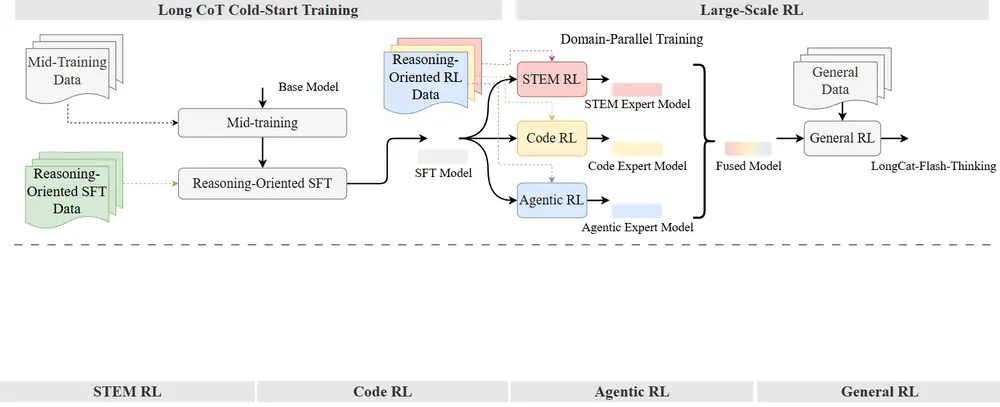

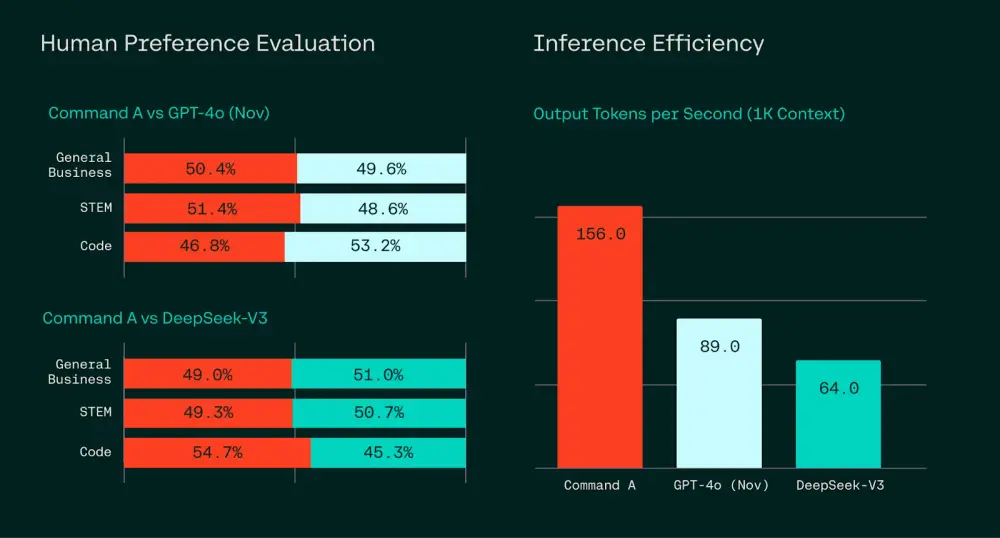

企业任务的人工对比评估胜率。所有示例都由经过专门培训的人工注释员进行盲注,评估企业专注的准确性、指令遵从性和风格。吞吐量比较是Cohere平台上的Command A、GPT-4o和Deepseek-V3(TogetherAI)之间的比较,数据由Artificial Analysis报告。

在业务、STEM 和编码任务的直接人工评估中,Command A 与其更大、更慢的竞争对手表现相当或更优,同时提供更高的吞吐量和效率。这种优势在真实世界的企业数据和情境中尤为明显。

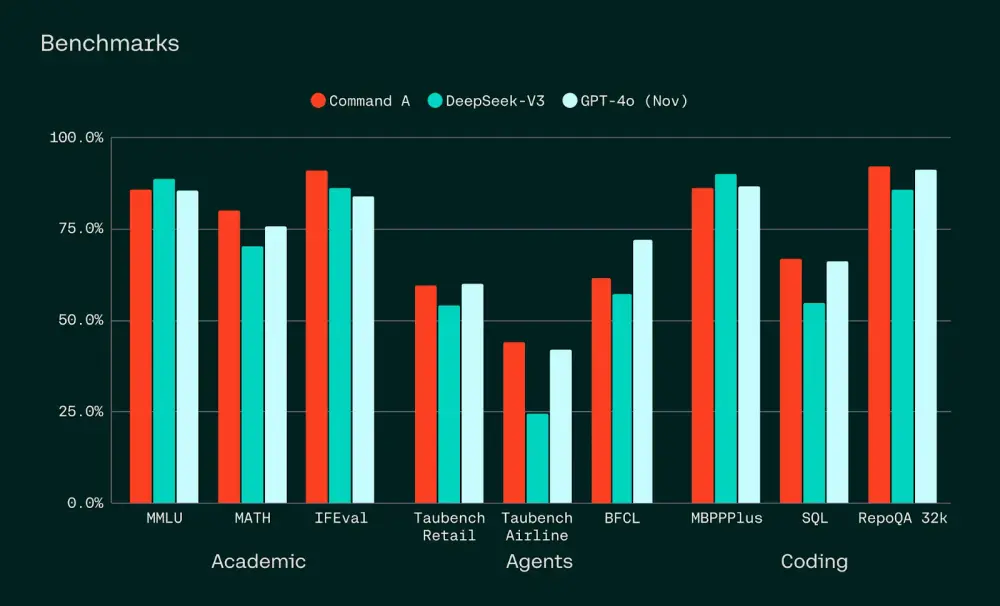

通过学术基准(MMLU、MATH、IFEval)、代理基准(BFCL和Taubench)以及编码基准(MBPPPlus、SQL和RepoQA)来评估性能。

可扩展的效率

Command A 的设计目标是实现极致的效率。它仅需两块 A100 或 H100 即可运行,计算需求远低于其他同类模型。这对于私有部署尤为重要,因为它可以显著降低硬件成本和延迟。

Command A 的输出速度高达 156 tokens/秒,比 GPT-4o 高 1.75 倍,比 DeepSeek-V3 高 2.4 倍。此外,私有部署的 Command A 比基于 API 的访问便宜高达 50%,为企业提供了更具性价比的选择。

在长短文本请求中,Command A每秒处理的令牌数量和获取第一个令牌所需的时间均优于GPT-4o和DeepSeek-V3。

企业级功能

Command A 的设计充分考虑了企业的实际需求。其 256k 的上下文长度是大多数领先模型的两倍,能够处理更长的企业文档。此外,Command A 还具备以下关键功能:

- 检索增强生成(RAG):提供可验证的引用,确保信息的准确性和可靠性。

- 代理型工具使用:能够根据企业内部信息提供准确答案。

- 企业级安全性:确保数据的安全性和隐私性。

- 强大的多语言性能:支持 23 种语言,覆盖全球大多数人口。

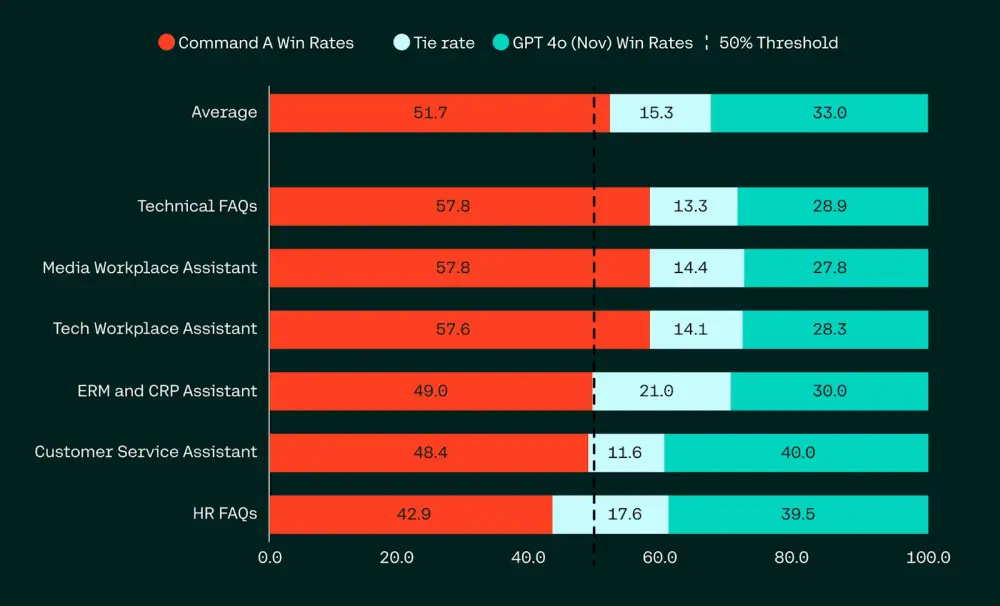

在企业 RAG 使用案例中,比较 Command A 和 GPT-4 的人工评估胜率。所有示例都经过专门训练的人工注释员进行至少三轮盲评,评估流畅度、准确性和响应实用性。

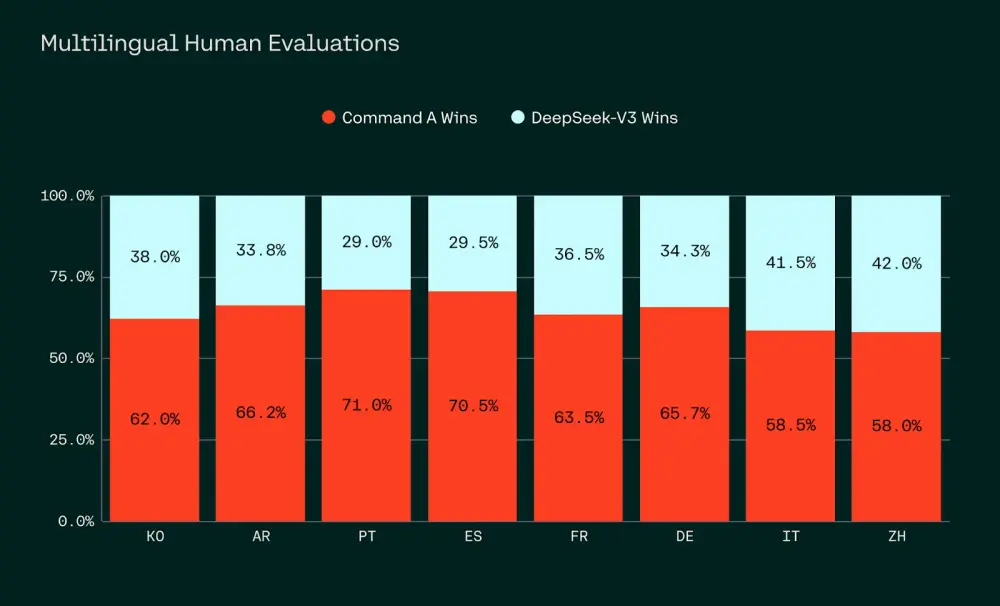

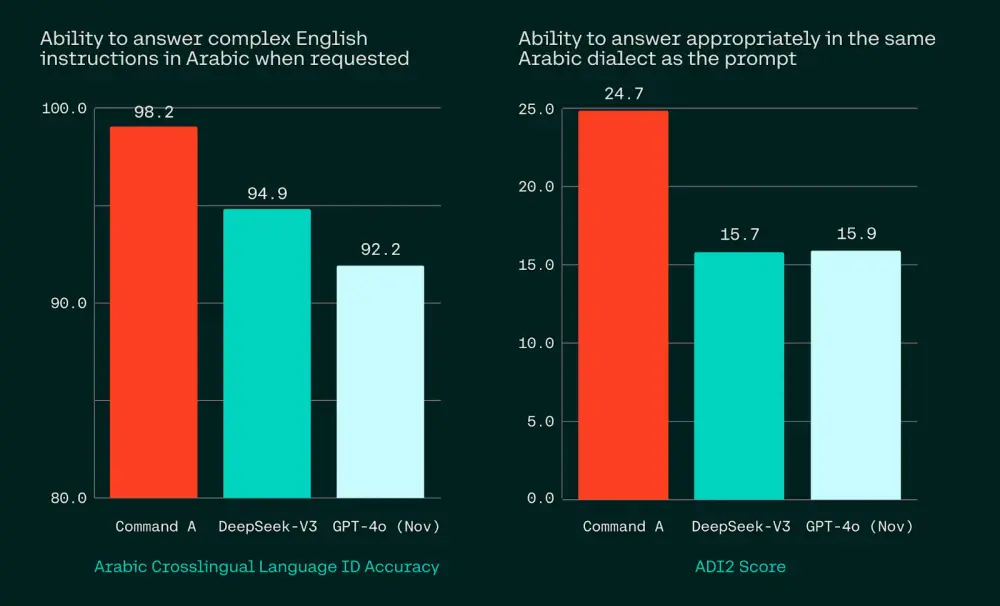

在多语言支持方面,Command A 表现尤为出色,能够以用户相关的方言回答问题,例如阿拉伯语方言,这使其在全球化企业中更具竞争力。

在8种语言的企业任务上的直接人力评估胜率。所有示例都由经过专门培训的人工注释员进行盲注,评估以企业为重点的准确性、指令遵从性和风格。

赋能 AI 代理

Command A 的核心优势之一是其能够根据企业内部数据提供准确答案。客户可以利用它执行各种复杂任务,例如按办公地点查找人力资源政策、审查法律法规和分析长篇财务报告。

2024年Marchisio等人提供的提示的阿拉伯语跨语言行级别通过率(LPR),以及2024年Robinson等人提供的4种阿拉伯方言(埃及、沙特、叙利亚、摩洛哥)单语提示的平均ADI2分数。

下一代 Cohere 模型将帮助金融、医疗保健、制造业、能源和公共部门等行业的客户开发各种 AI 应用。特别地,Command A 将与 Cohere 的安全 AI 代理平台 North 无缝集成,释放企业数据和人员的全部潜力。

North 平台能够安全地利用 CRM 和 ERP 软件等企业工具,并连接到内部数据库和外部网络搜索服务,使企业能够在安全防火墙内构建执行操作的代理。

可用性与定价

Command A 现已在 Cohere 平台上提供,也可在 Hugging Face 上用于研究用途,并即将登陆主要云提供商。对于私有或本地部署的需求,企业可以联系 Cohere 的销售团队获取更多信息。

Cohere API 定价如下:

- 输入 Tokens:$2.50 / 1M

- 输出 Tokens:$10.00 / 1M

相关文章