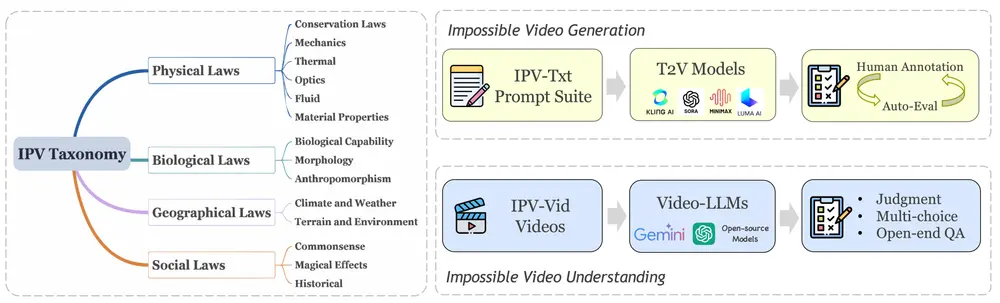

特拉维夫大学和Snap的研究人员推出一种名为 “Nested Attention” 的新机制,用于在文本到图像模型中实现概念个性化。该机制通过在模型的现有交叉注意力层中注入丰富且具有表现力的图像表示,从而在保持模型先验知识的同时,提高了生成图像中特定主体的身份保留能力,并能在单个图像中组合多个个性化概念。

例如,你想生成一张图片,内容是你的朋友在海滩上的照片,你提供了你朋友的一张照片和文本提示“朋友在海滩上”。使用嵌套注意力机制,模型能够将你朋友的面部特征和身份信息有效地融入到生成的图像中,同时保持海滩的环境和氛围。这样,生成的图像不仅保留了你朋友的身份特征,还符合输入的文本提示。

- 个性化图像生成:能够根据给定的文本提示,生成包含特定主体(如人物、宠物等)的图像,且主体的身份特征在不同场景和风格下得以准确保留。

- 多概念组合:允许在单个图像中融合多个来自不同领域的个性化概念,例如将人物和宠物以不同风格呈现于同一画面。

- 平衡身份保留与提示对齐:在生成图像时,既能保持输入文本提示的语义信息,使生成图像与提示高度契合,又能确保主体的身份特征得到良好保留。

- 基于查询的注意力值:引入查询相关的主体值,通过嵌套注意力层为每个生成图像区域选择最相关的主体特征,使得模型可以更精准地捕捉主体细节,而无需将主体的全部外观信息编码在单个标记中。

- 领域通用性:该方法具有通用性,不仅适用于人脸识别等特定领域,也能在非人类领域(如宠物)中增强性能,且不需要专门的重复身份数据集进行训练。

- 基于预训练模型:基于预训练的文本到图像扩散模型,在训练过程中保持原始模型权重不变。

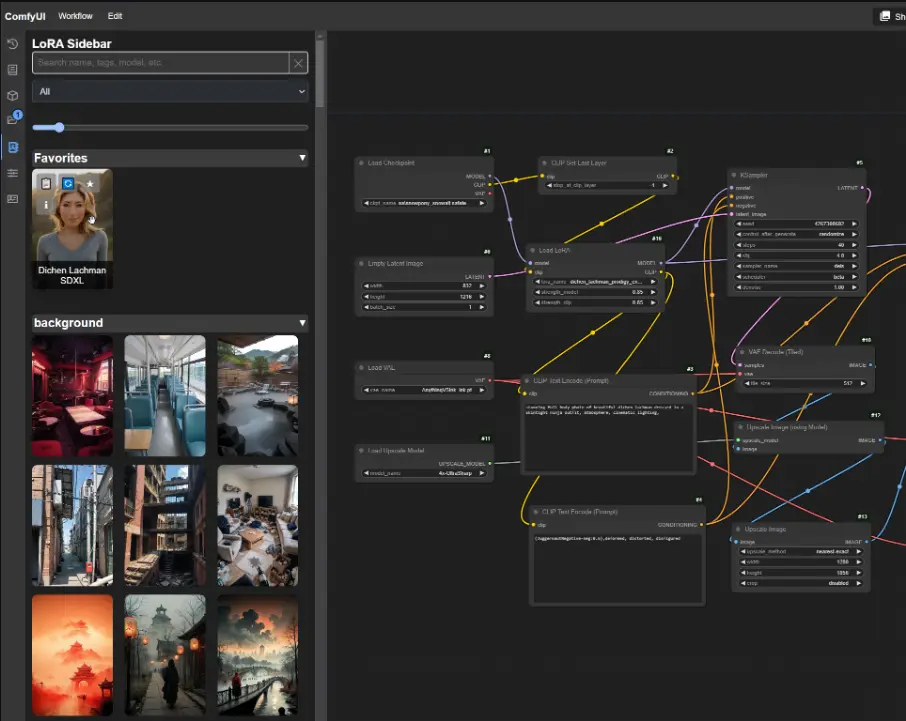

- 编码器处理输入图像:使用基于 CLIP 的编码器处理输入图像,提取多个标记(tokens),这些标记经过 Q-Former 处理后,生成嵌套注意力层所需的键(keys)和值(values)。

- 嵌套注意力机制:在模型的每个交叉注意力层中添加嵌套注意力层。外部层是标准的文本到图像交叉注意力层,将新主体与给定文本标记关联;内部嵌套注意力层则根据生成图像的查询,从输入图像中学习并选择相关的主体特征,为每个查询生成依赖于查询的注意力值,这些值会替换外部层中与主体标记相关的交叉注意力值。

- 训练与优化:利用包含(输入图像、文本提示、目标图像)三元组的数据集进行训练,在训练过程中,向目标图像添加噪声,然后使用扩散模型根据输入图像预测噪声,以学习个性化表示并保持原始模型的先验知识。同时,通过正则化技术避免 “注意力过拟合” 问题,确保模型在关注主体的同时不忽略其他提示信息。

- 艺术创作:如生成特定人物在各种艺术风格(如水彩画、油画、抽象画等)下的图像,或创造不同场景(如公园、森林、海滩等)中的个性化图像,满足艺术创作对多样性和个性化的需求。

- 虚拟形象设计:为虚拟角色或数字形象定制外观,使其在不同情境和风格设定下保持一致的身份特征,可应用于游戏开发、虚拟社交平台等领域。

- 宠物主题创作:生成宠物在不同场景、风格(如卡通风格、写实风格)下的图像,可用于宠物相关的艺术作品、个性化商品设计等。

- 多主体组合创作:将人物与宠物或其他元素组合在同一图像中,展现多样化的创意场景,适用于广告设计、故事插画等需要多种元素融合的场景。