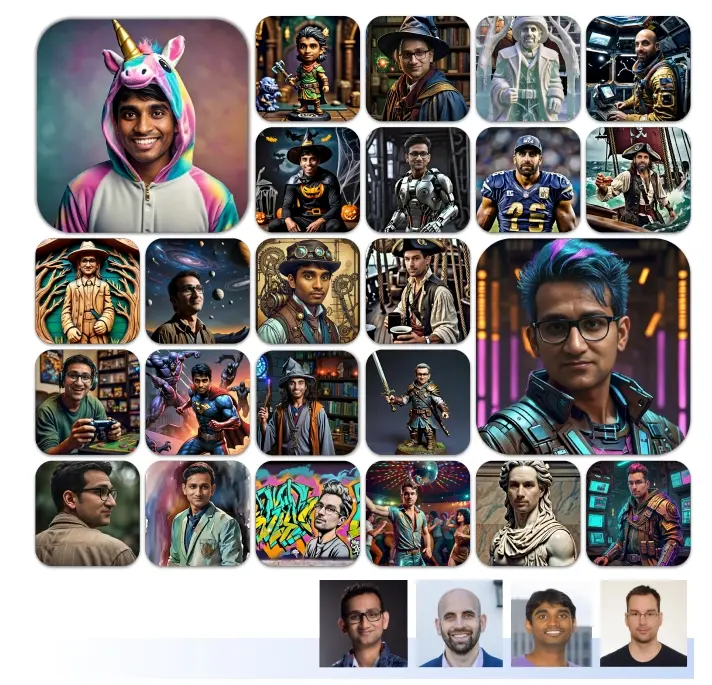

Meta旗下GenAI团队推出个性化图像生成模型Imagine yourself,与传统的基于调整的个性化技术不同,Imagine yourself作为一个无需调整的模型运行,使得所有用户都能利用共享框架,而无需进行个体化调整。简单来说,这个模型可以根据你提供的一张参考照片,生成遵循特定文字描述的新图像,而且不需要对每个新用户进行单独调整。

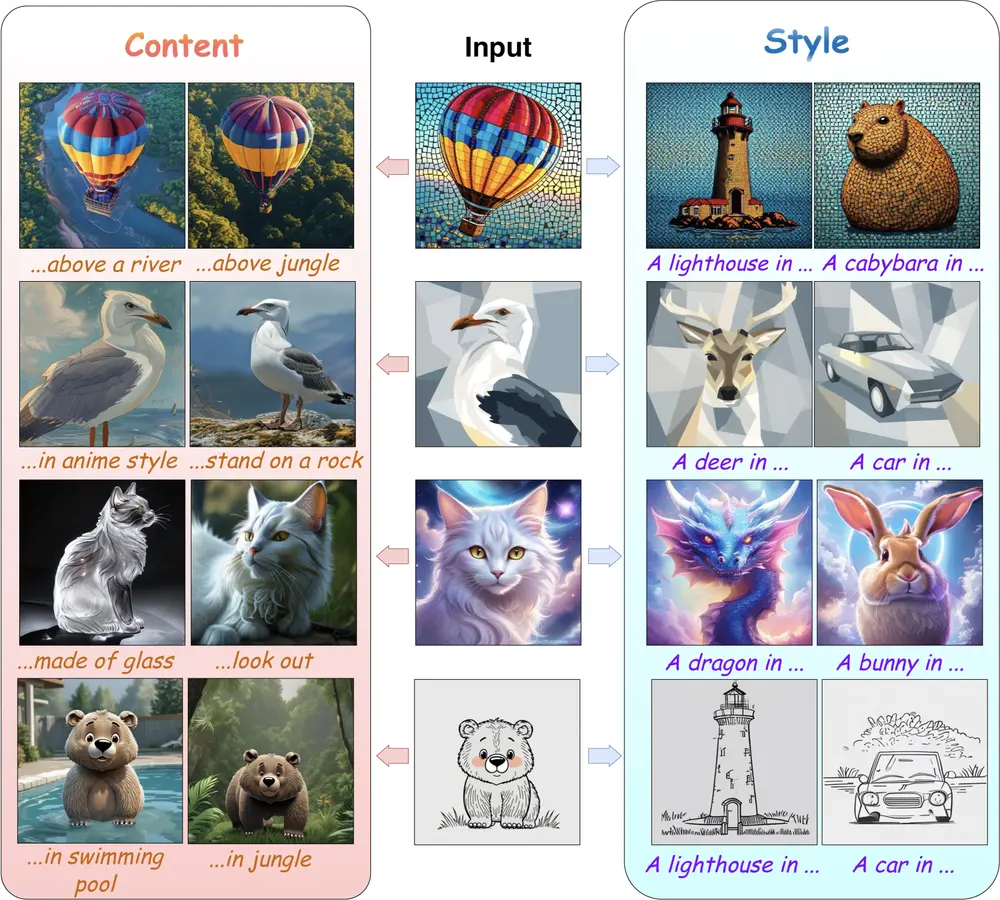

研究团队引入了1)一个新的合成配对数据生成机制来鼓励图像多样性,2)一个带有三个文本编码器和完全可训练的视觉编码器的全并行注意力架构来提高文本忠实度,以及3)一种新颖的从粗到细的多阶段微调方法,逐渐推动视觉质量的边界。我们的研究表明,“想象自己”超越了最先进的个性化模型,展现了在身份保留、视觉质量和文本对齐方面的卓越能力。这个模型为各种个性化应用奠定了坚实的基础。

主要功能:

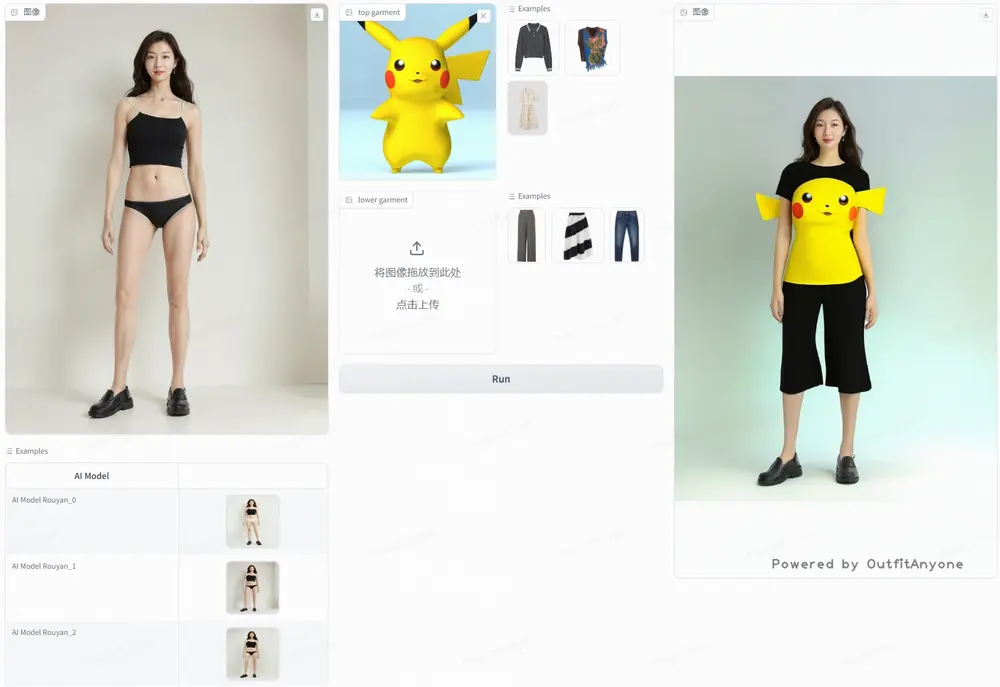

- 个性化图像生成:用户可以输入一张图片和一段描述文字,模型会生成一张新的图片,新图片里的人看起来和参考图片一样,但会按照文字描述进行相应的变化,比如更换服装风格、姿势等。

- 无需用户特定调整:与以往需要针对每个用户进行调整的模型不同,"Imagine yourself"模型无需这样的调整,所有用户共享同一个模型。

主要特点:

- 无需调整:用户无需进行任何个性化调整,即可使用。

- 图像多样性:通过新的合成数据生成机制,鼓励生成更多样化的图像。

- 文本忠实度:采用全新的全平行注意力架构和三个文本编码器,以及一个完全可训练的视觉编码器,以提高对文本的忠实度。

- 视觉质量:采用创新的粗到细多阶段微调方法,逐步提高视觉质量。

工作原理:

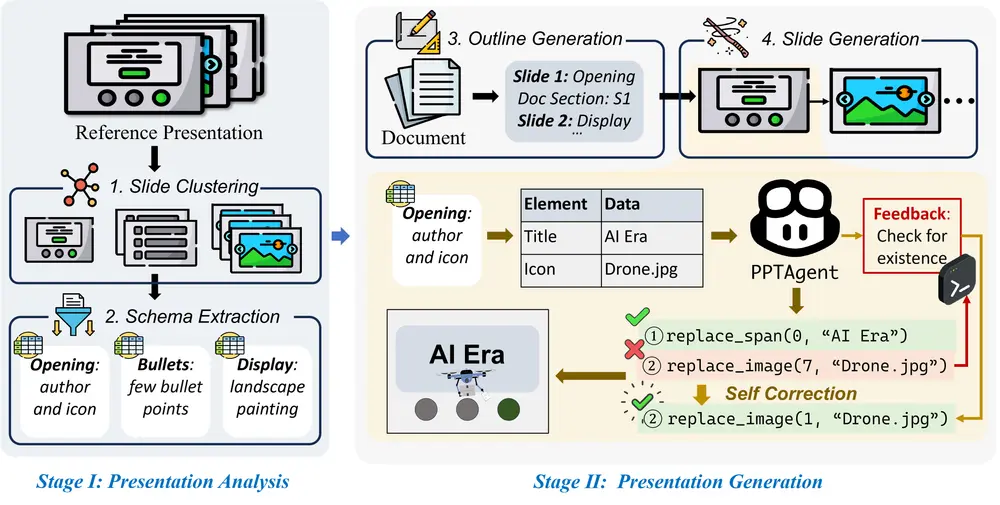

- 视觉编码器:从参考图像中提取身份信息。

- 文本编码器:处理输入的文本提示。

- 全平行图像-文本融合:通过全平行注意力架构将视觉信号和文本信号结合起来。

- 多阶段微调:通过交替使用真实数据和合成数据进行多阶段微调,以达到在可编辑性和身份保持之间的最佳平衡。

具体应用场景:

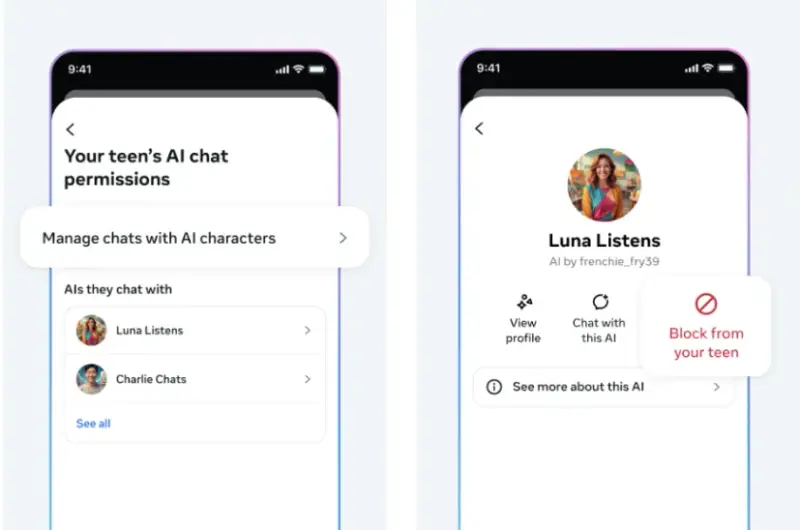

- 社交媒体:用户可以根据文本描述来生成个性化的图片,用于社交媒体分享。

- 娱乐:在游戏或虚拟现实中,玩家可以生成代表自己的虚拟角色或头像。

- 广告和营销:公司可以生成符合特定品牌形象的个性化广告图像。

- 艺术创作:艺术家可以使用这个模型来探索不同的风格和创意。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...