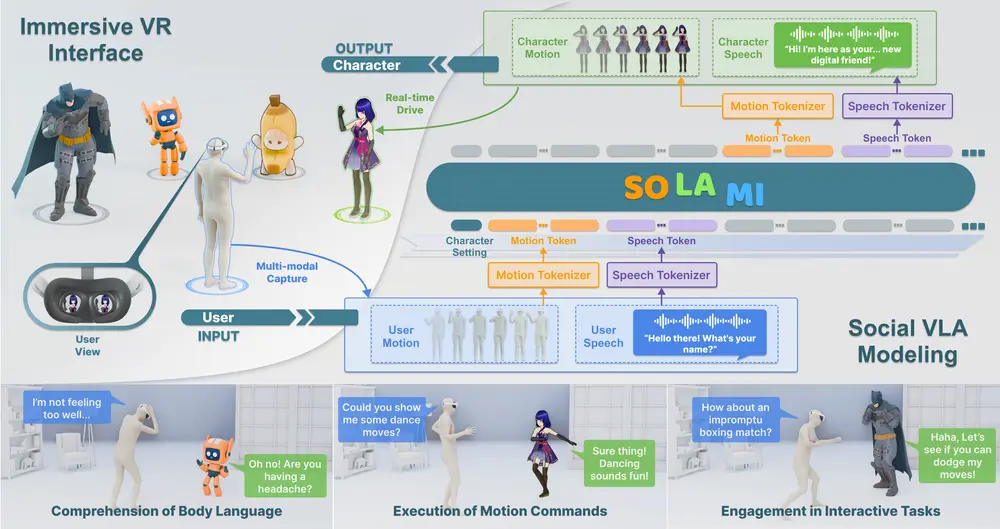

字节跳动的研究人员推出一个统一的视频生成框架Phantom ,通过跨模态对齐实现主体一致性的视频生成(Subject-to-Video, S2V),用于单主体和多主体参考,构建在现有的文本到视频和图像到视频架构之上。该框架的核心思想是从参考图像中提取主体元素,并通过文本指令生成与主体一致的视频内容。

此框架基于阿里开源的Wan2.1模型, ComfyUI-WanVideoWrapper 已经支持Phantom-Wan-1.3B模型。

- 项目主页:https://phantom-video.github.io/Phantom

- GitHub:https://github.com/Phantom-video/Phantom

- 模型:https://huggingface.co/bytedance-research/Phantom

例如,给定一张人物图像和一段描述人物动作的文本(如“一个人在公园里跑步”),Phantom 可以生成该人物在公园跑步的视频,同时保持人物的外貌和动作与参考图像和文本描述一致。

主要功能

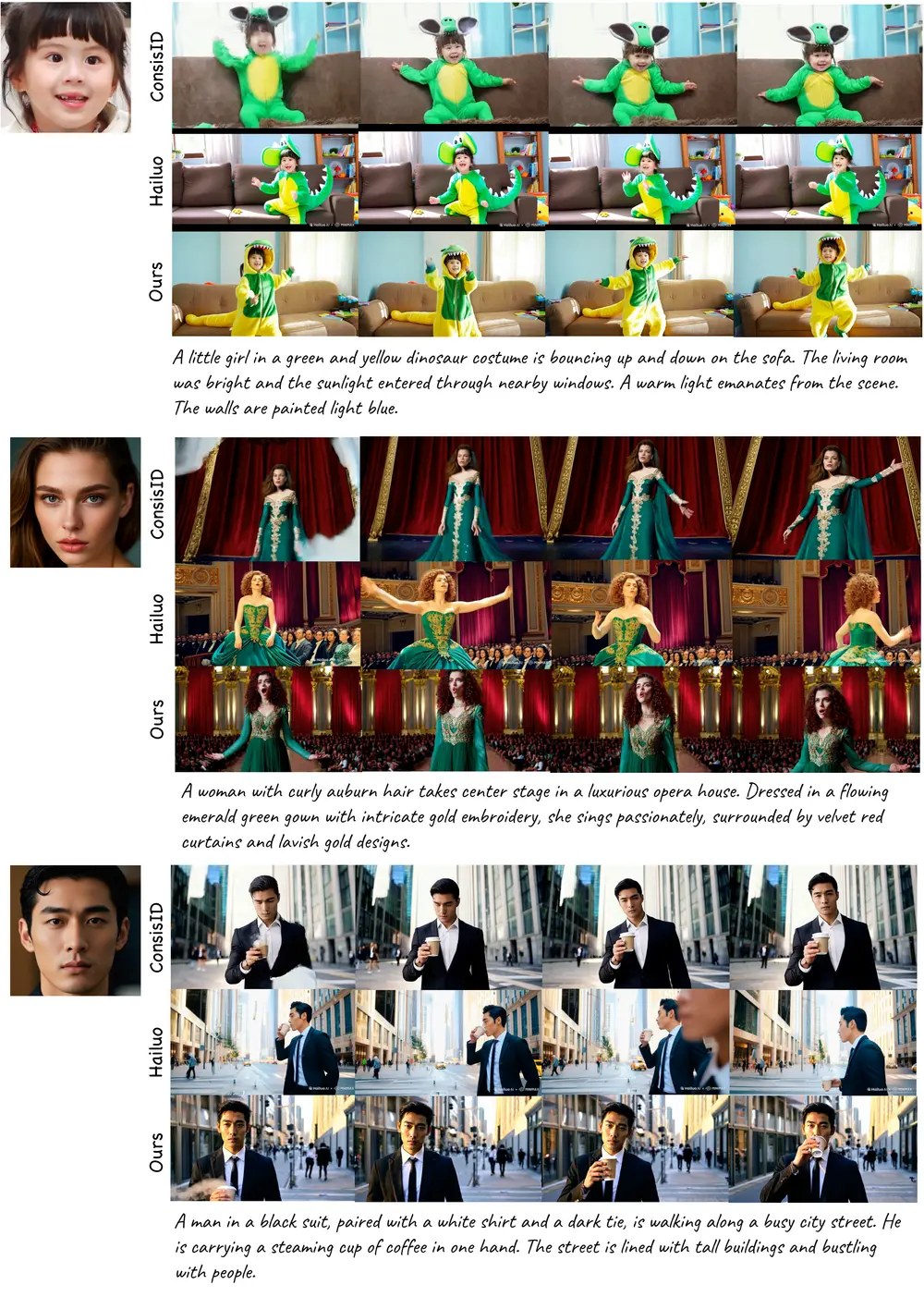

Phantom 的主要功能是 主体一致性视频生成,即在生成视频时确保视频中的主体(如人物、动物、物体等)与输入的参考图像和文本描述保持高度一致。它支持单主体和多主体的视频生成,例如:

- 单主体生成:从一张人物图像生成一段该人物在特定场景中进行特定动作的视频。

- 多主体生成:从多张图像生成包含多个主体互动的视频,如“一个人和一只狗在公园玩耍”。

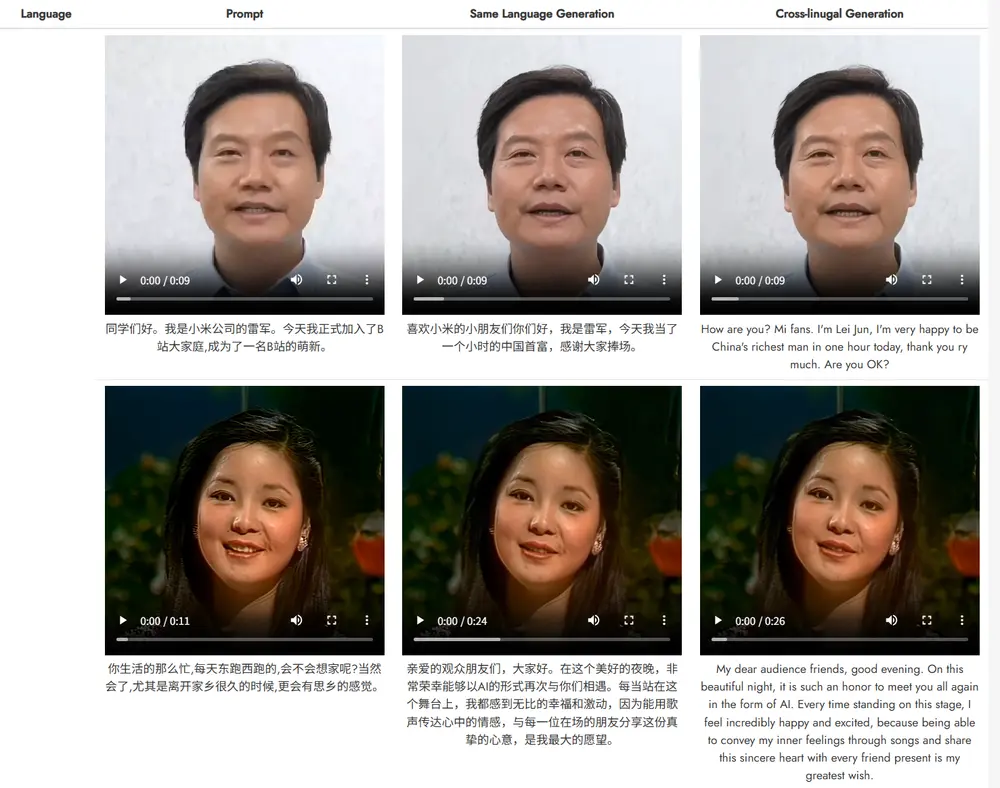

此外,Phantom 还支持 面部 ID 保持,即在视频生成过程中保持人物面部特征的一致性,适用于虚拟试穿、数字人等场景。

主要特点

- 跨模态对齐:Phantom 通过文本、图像和视频的三元组数据结构进行训练,能够同时对齐文本和视觉内容,确保生成视频与输入的文本和图像高度一致。

- 主体一致性:在多主体生成中,Phantom 能够保持多个主体的外观和动作一致性,避免生成的视频中主体出现变形或不自然的过渡。

- 高质量视频生成:Phantom 在视频质量、文本一致性、主体一致性等多维度表现出色,尤其在面部 ID 保持方面具有显著优势。

- 灵活性和扩展性:Phantom 基于现有的文本到视频(T2V)和图像到视频(I2V)架构进行扩展,能够灵活适应不同的应用场景和数据结构。

工作原理

Phantom 的工作原理基于以下关键步骤:

- 数据结构设计:构建文本、图像和视频的三元组数据结构,用于跨模态学习。数据分为 in-paired(从视频中提取关键帧作为参考图像)和 cross-paired(从不同视频中匹配主体元素)两种类型,以避免生成视频简单复制输入图像。

- 模型架构:Phantom 采用 MMDiT 结构,分为未训练的输入头和可训练的 DiT 模块。输入头对视频、文本和参考图像进行编码,将它们的特征分别输入到视觉分支和文本分支中。视觉分支通过 3D VAE 维持视觉一致性,文本分支通过 CLIP 提供语义信息。

- 跨模态对齐:通过文本、图像和视频的联合训练,Phantom 学会如何将文本指令与参考图像内容对齐,从而生成与两者一致的视频。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...