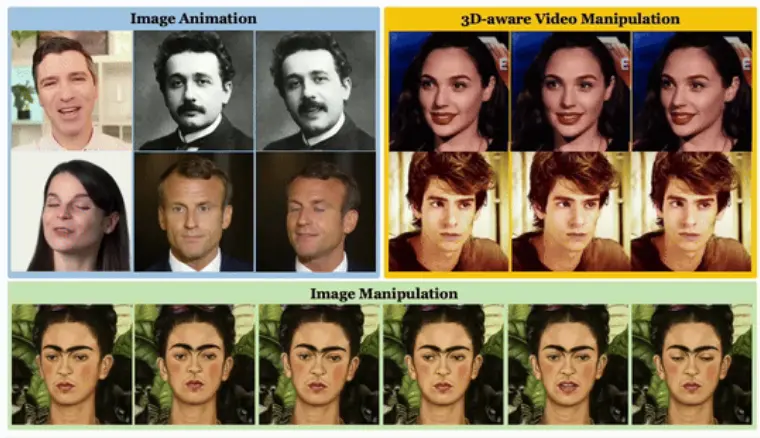

基于潜在扩散的生成模型在肖像图像动画方面取得了显著进展,特别是在短时视频合成方面。例如,Hallo 模型已经展示了令人印象深刻的结果。然而,这些模型在生成长时间视频时面临外观漂移和时间伪影等问题。为了解决这些挑战,复旦大学、百度公司和南京大学的研究人员对 Hallo 进行了更新,提出了 Hallo2 模型。

- 项目主页:https://fudan-generative-vision.github.io/hallo2

- GitHub:https://github.com/fudan-generative-vision/hallo2

- 模型:https://huggingface.co/fudan-generative-ai/hallo2

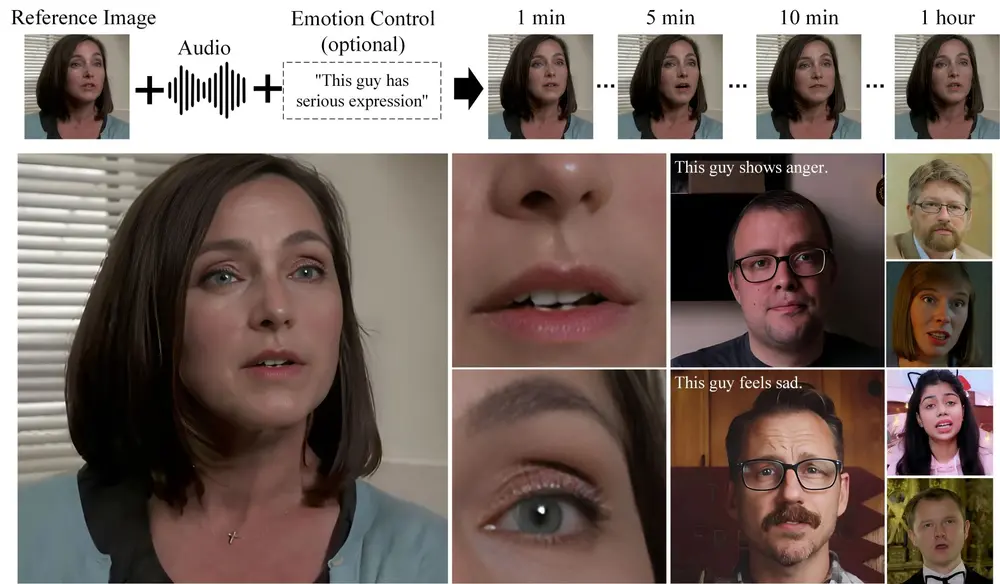

HALLO2是一种用于制作高分辨率、长时间的人像动画的方法。简单来说,HALLO2能够根据一张静态的人像照片和你提供的声音文件,生成一个长时间(比如几十分钟)的、高清晰度(4K分辨率)的动态视频。这个视频里的人像会根据你的声音文件进行口型同步和表情变化,就像真的在说话一样。

例如,你是一名历史老师,你想制作一系列关于历史人物的讲解视频。你可以拍一张自己的肖像照片,然后录制一段讲解的音频。使用HALLO2,你就可以生成一个视频,视频中的你会根据讲解内容自然地说话和做出表情,就像你真的在和观众面对面交流一样。这个视频可以是高清晰度的,而且可以持续很长时间,足够你讲解一个完整的话题。

Hallo2 的主要改进

Hallo2 通过引入几个设计增强功能,显著扩展了其生成长时间高质量肖像视频的能力:

生成长时间视频:

- 条件运动帧图像空间内的增强策略:为了解决外观漂移和时间伪影问题,研究人员在条件运动帧图像空间内引入了增强策略。具体来说,他们采用了带有高斯噪声的补丁丢弃技术,以增强长时间内的视觉一致性和时间连贯性。

4K分辨率肖像视频生成

- 潜在代码的矢量量化:为了实现4K分辨率的视频生成,研究人员实施了潜在代码的矢量量化技术,这有助于减少内存占用和计算成本。

- 时间对齐技术:通过应用时间对齐技术,保持了时间维度上的连贯性。

- 高质量解码器:集成高质量解码器,确保生成的视频在4K分辨率下具有出色的视觉效果。

可调节的语义文本标签

- 语义文本标签作为条件输入:Hallo2 引入了可调节的语义文本标签作为条件输入,这超越了传统的音频提示,提高了生成内容的可控性和多样性。用户可以通过文本提示精确控制肖像的表情和动作。

主要功能和特点:

- 长时间视频生成:HALLO2可以制作长达几十分钟的视频,这比之前的技术只能制作几秒钟的视频要强得多。

- 高分辨率输出:生成的视频可以达到4K分辨率,这意味着视频非常清晰,细节丰富。

- 音频驱动:你只需要提供一段音频,HALLO2就能根据音频中的声音来驱动人像的口型和表情。

- 文本提示增强:除了音频,你还可以提供文本提示,来进一步控制视频中人像的表情和动作。

工作原理:

HALLO2的工作原理可以分为几个步骤:

- 数据增强:通过一种叫做“patch-drop”的技术,结合高斯噪声,来增强视频的视觉效果,使其在长时间播放中保持一致性。

- 向量量化:使用一种叫做VQGAN的技术,通过向量量化潜码,并应用时间对齐技术,来保持视频中的连贯性。

- 高分辨率增强模块:通过一个高质量的解码器,实现4K分辨率的视觉合成。

- 文本提示控制:通过一个适应性层归一化机制,将文本提示融入到生成过程中,以精确控制人像的表情和动作。

实验结果

研究人员在多个公开数据集上进行了广泛的实验,包括 HDTF、CelebV 和他们引入的“Wild”数据集。实验结果表明,Hallo2 在生成长时间肖像视频动画方面达到了最先进的性能,能够成功生成长达数十分钟的丰富且可控的4K分辨率内容。

潜在影响

Hallo2 的提出不仅在技术上取得了突破,还在实际应用中具有巨大的潜力:

- 虚拟助手和客服:生成高质量的长时间视频可以提升虚拟助手和客服系统的用户体验。

- 娱乐和媒体制作:在电影、动画和游戏制作中,Hallo2 可以生成高度逼真的角色动画,提高制作效率。

- 远程通信:在视频会议和远程教育中,Hallo2 可以生成更加真实和互动的虚拟形象,增强沟通效果。

Hallo2 通过引入补丁丢弃技术、矢量量化和时间对齐技术,以及可调节的语义文本标签,显著提升了生成长时间高质量肖像视频的能力。这些改进不仅解决了现有模型的局限性,还为未来的肖像图像动画研究提供了新的方向。随着技术的不断发展,我们有理由相信,未来的生成模型将能够生成更加丰富和多样化的视频内容,为各种应用场景带来更大的价值。

相关文章