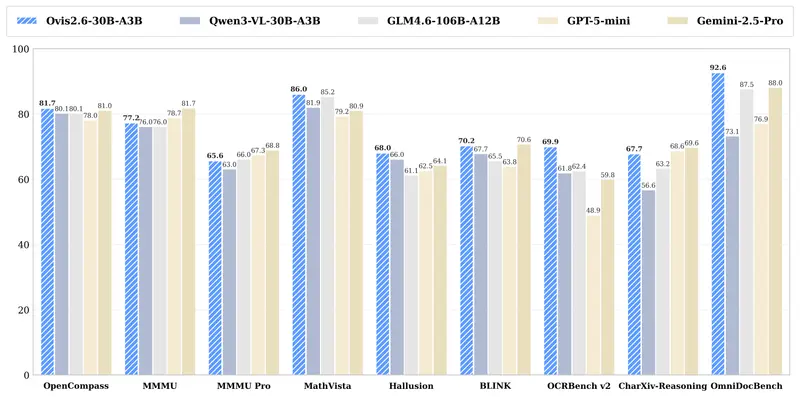

阿里国际正式推出 Ovis2.6-30B-A3B 多模态大语言模型,作为 Ovis 系列的最新迭代版本,它在 Ovis2.5 基础上全面升级主干架构与多模态能力,以更低推理成本实现更强的长上下文、高分辨率图像、复杂文档与视觉推理表现,为企业级多模态理解场景提供更高效、更经济的解决方案。

模型核心定位与架构升级

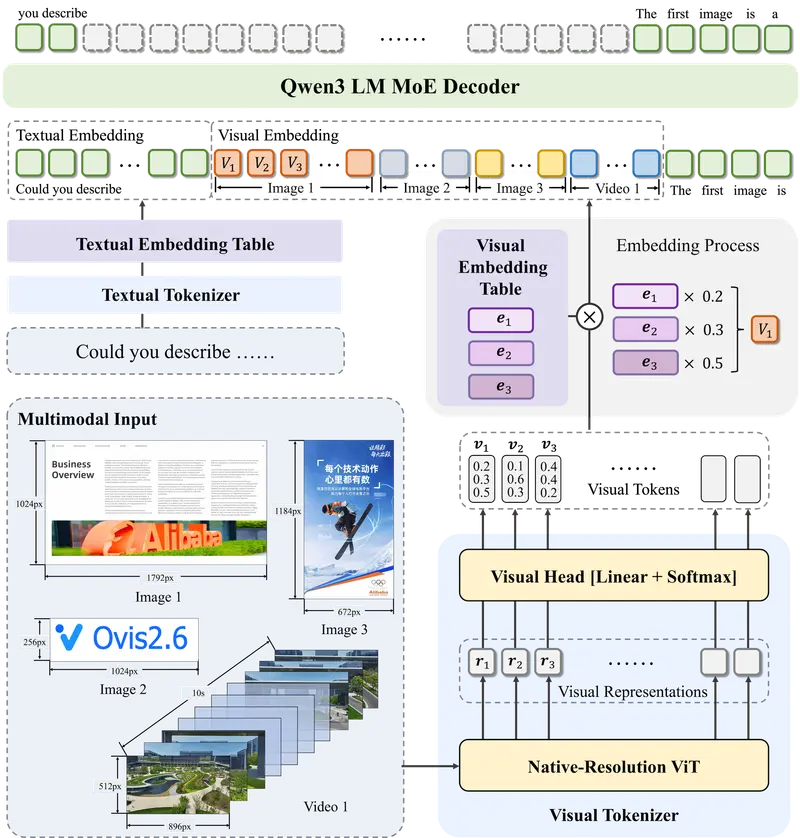

Ovis2.6-30B-A3B 最显著的变化,是将大语言模型主干升级为混合专家(MoE)架构,在保持高效推理的同时,大幅提升模型容量与知识表达能力。

- 模型总参数达到 300 亿,可承载更丰富的世界知识、语言细节与多模态语义信息。

- 推理阶段仅激活约 30 亿参数,在保持高质量输出的前提下,显著降低算力消耗、提升吞吐效率,让大规模部署与高频调用更具成本优势。

这一架构升级,让 Ovis2.6 实现了“大模型容量 + 小模型推理成本”的兼顾,更适合电商、跨境、企业服务、文档自动化等实际业务场景落地。

四大核心能力全面增强

1. MoE 架构:高性能与低成本的平衡

依托 MoE 混合专家架构,Ovis2.6 实现了参数规模与推理效率的双重突破:

- 总参数量 30B,知识覆盖更广、语义理解更细、生成更稳定。

- 激活参数量仅约 3B,推理速度更快、显存占用更低、部署成本更亲民。

- 在多轮对话、复杂图文理解、长文档处理等场景下,性能提升明显。

2. 长上下文 + 高分辨率,处理更复杂视觉输入

Ovis2.6 大幅扩展了模型对长文本与高清图像的处理上限,进一步强化信息密集型场景能力:

- 文本上下文长度扩展至 64K tokens,可直接处理超长报告、多页合同、长篇说明书等内容。

- 支持最高 2880×2880 超高分辨率图像输入,能够捕捉图像中更精细的结构、文字、细节与关系。

- 特别适用于多页文档问答、跨页信息整合、复杂图表分析、高清商品图理解等任务。

3. 图像思考:从“被动看图”到“主动分析”

本次更新中,Ovis2.6 新增标志性能力——“图像思考”(Image Thinking),将传统被动式视觉输入升级为主动式认知推理:

- 模型可在推理过程中主动调用视觉工具,如裁剪、放大、旋转、局部重审视等操作。

- 在思维链中对图像关键区域进行多轮、反复、聚焦式分析,实现更接近人类的视觉理解逻辑。

- 在复杂场景图、推理类图文题、工业图纸、医学影像、复杂界面等任务上,准确率显著提升。

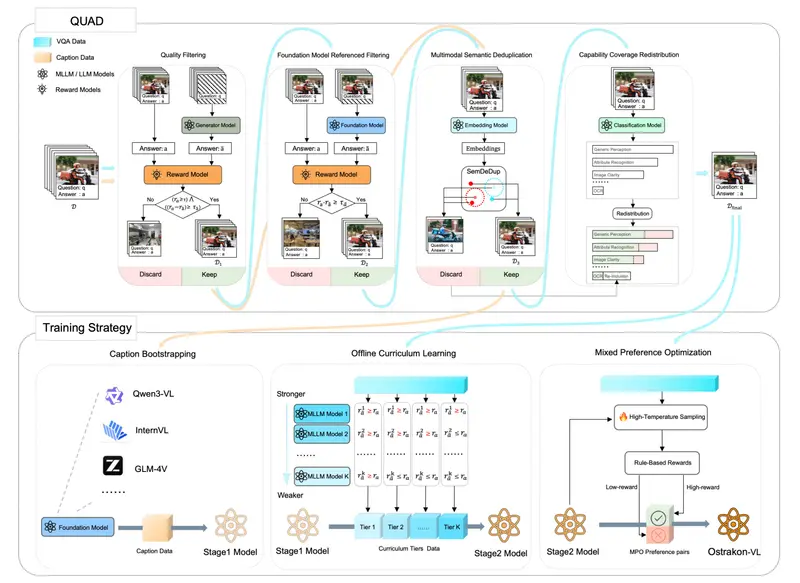

4. OCR、文档、图表能力深度强化

延续 Ovis 系列在信息密集型视觉任务上的优势,Ovis2.6 进一步强化结构化信息理解能力:

- 高精度 OCR 识别,支持复杂版式、手写、印章、水印、倾斜、模糊等常见场景。

- 深度 文档理解,可提取标题、段落、表格、目录、注释并进行逻辑整合。

- 专业 图表与示意图分析,能读懂折线图、柱状图、流程图、架构图并做归纳、对比、推理与总结。

- 不只“提取文字”,更能对内容进行理解、计算、对比、推断、总结,真正实现文档智能化。

场景价值总结

Ovis2.6-30B-A3B 面向真实产业场景,重点强化以下能力:

- 低成本规模化部署:MoE 架构降低推理门槛,适合高频、高并发、长时运行的企业场景。

- 超长上下文 + 高清图像:适配长文档、多页报表、高清商品图、工业图纸等。

- 主动式图像思考:提升复杂视觉推理任务的准确性与可靠性。

- 强文档与图表能力:满足跨境电商、企业办公、金融报表、教育、法律、政务等领域的结构化理解需求。

作为阿里国际 Ovis 多模态模型家族的最新成员,Ovis2.6 以更高效、更经济、更强大的多模态理解能力,为视觉语言协同任务提供新一代底座支持。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...