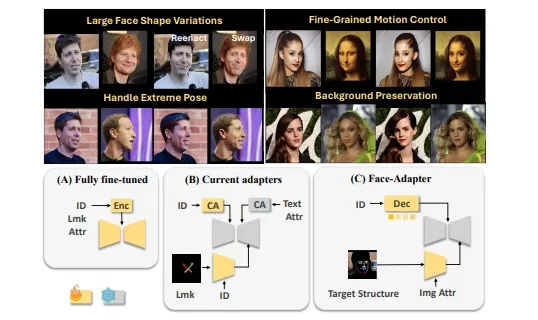

来自浙江大学、腾讯、 VIVO和南洋理工大学的研究人员推出Face-Adapter,这是一个专为预训练扩散模型设计的高效且有效的适配器,用于实现高精度和高保真的面部编辑。经过观察,开发人员发现无论是人脸重演还是交换任务,它们都涉及到目标结构、身份和属性的组合。因此,开发人员的目标是在一个模型中充分解耦这些因素的控制,以实现这两个任务。

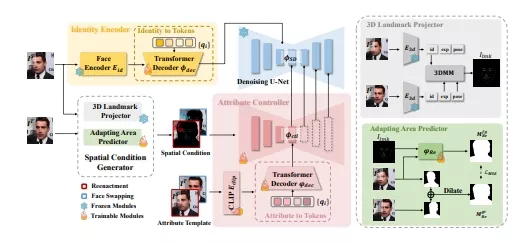

具体来说,Face-Adapter包括:1) 一个空间条件生成器,用于提供精确的地标和背景信息;2) 一个即插即用的身份编码器,通过变压器解码器将面部嵌入转移到文本空间;3) 一个属性控制器,负责整合空间条件和详细的属性信息。FaceAdapter在运动控制精度、ID保留能力和生成质量方面,与完全微调的人脸重演/交换模型相比,展现出相当甚至更优越的性能。此外,FaceAdapter还能够与各种StableDiffusion模型无缝集成。

主要功能:

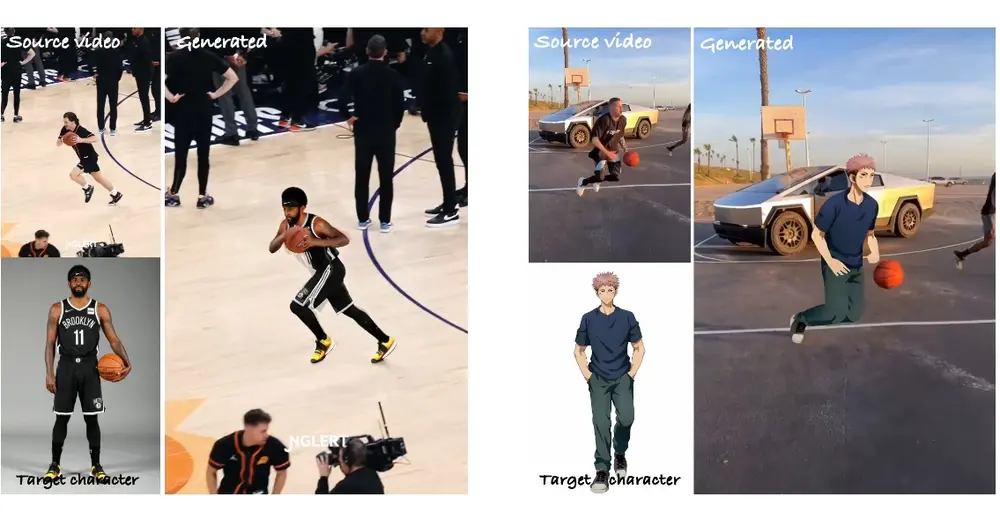

Face-Adapter的主要功能是实现人脸重演(reenactment)和人脸交换(swapping)。人脸重演是指将一个人的表情和动作转移到另一个人的脸上,而人脸交换则是将一个人的面部特征转移到另一个人的身上,同时保持后者的动作和属性不变。

主要特点:

- 高精度控制:Face-Adapter可以精细控制目标结构、身份(ID)和属性,以实现人脸重演和交换。

- 高效性:与完全微调的人脸重演/交换模型相比,Face-Adapter在运动控制精度、身份保留能力和生成质量方面表现相当甚至更优。

- 即插即用:作为一个适配器,它可以无缝集成到各种StableDiffusion模型中,无需对整个模型进行训练。

工作原理:

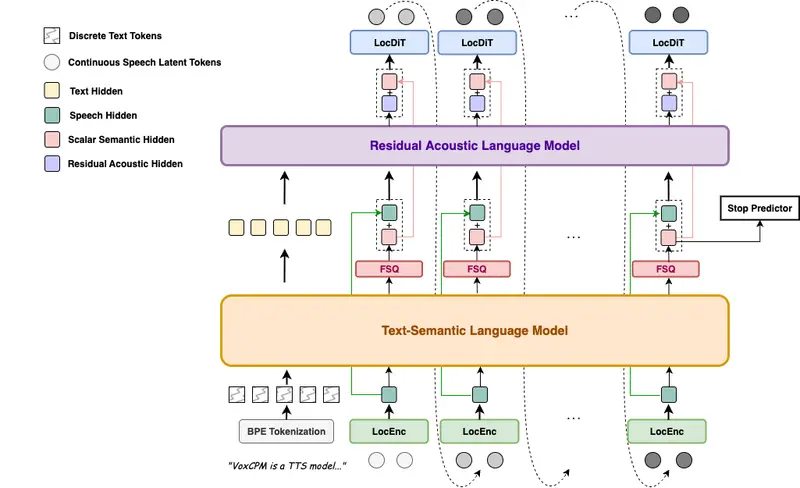

Face-Adapter包含三个主要组件:

- 空间条件生成器(Spatial Condition Generator):自动预测3D先验标志点和变化前景区域的掩码,为后续的控制生成提供更合理和精确的指导。

- 身份编码器(Identity Encoder):使用预训练的识别模型提取面部嵌入,并通过变换解码器将其转换为文本空间,从而大大提高生成图像中身份的一致性。

- 属性控制器(Attribute Controller):结合空间条件和详细属性,包括目标运动的标志点和不变的背景。

具体应用场景:

Face-Adapter的应用场景包括:

- 影视制作:在电影或电视剧中,可以通过Face-Adapter将某个演员的表情和动作转移到另一个演员的身上,或者将一个演员的面部特征应用到另一个场景中。

- 虚拟现实(VR)和增强现实(AR):在VR或AR应用中,用户可以通过Face-Adapter实时地将虚拟角色的面部特征与自己的面部动作同步。

- 社交媒体和娱乐:用户可以利用Face-Adapter在社交媒体上分享具有自己面部特征的虚拟角色或进行人脸交换的趣味视频。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...