在数字化时代,文档处理和理解是许多行业和研究领域的核心需求。从学术论文到商业报告,从技术手册到专利文件,文档的高效转换和理解对于信息提取、知识管理和自动化流程至关重要。然而,传统的文档处理方法往往依赖于复杂的多步骤流程或大型预训练模型,这些方法要么效率低下,要么计算成本高昂。

- 模型地址:https://huggingface.co/ds4sd/SmolDocling-256M-preview

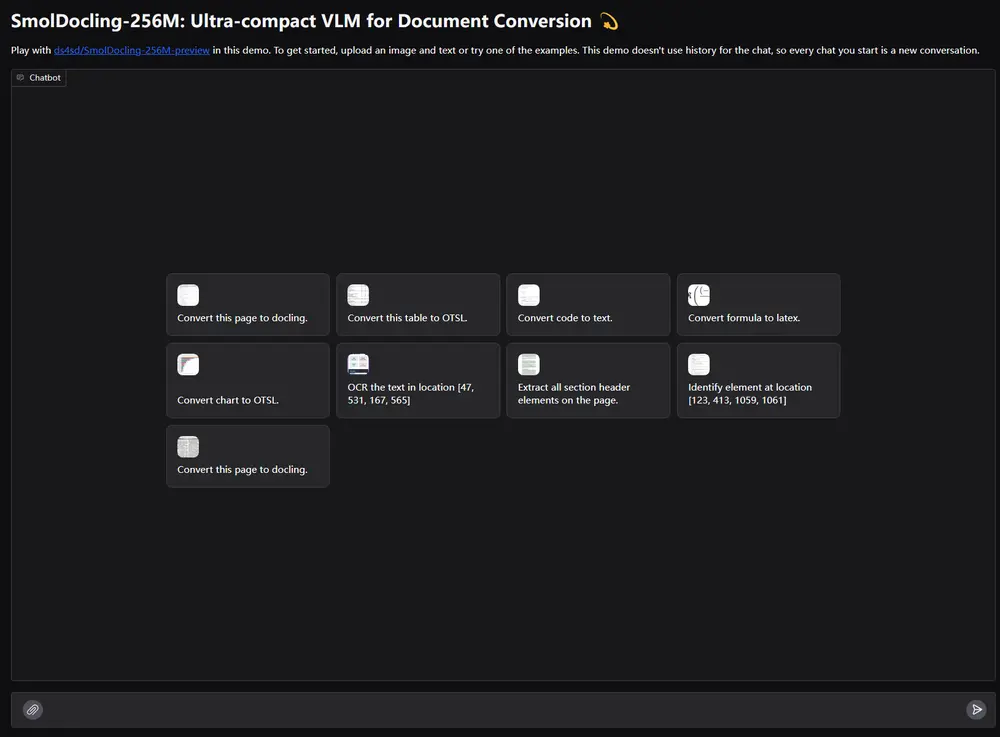

- Demo:https://huggingface.co/spaces/ds4sd/SmolDocling-256M-Demo

IBM Research 和 Hugging Face 的研究团队联合推出了一种创新的解决方案——SmolDocling,这是一个超紧凑的视觉语言模型,旨在以高效的方式实现端到端的多模态文档转换。

主要功能

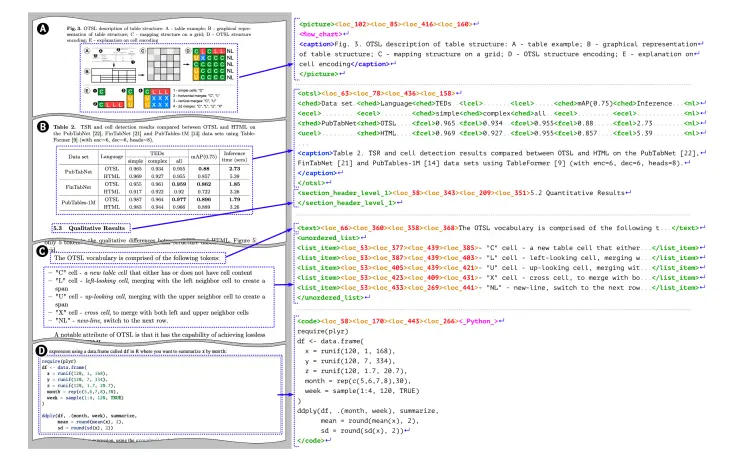

SmolDocling 的核心功能是将文档页面图像转换为结构化的文档标记格式(DocTags),这种格式能够全面捕捉文档的内容、结构和空间位置信息。它能够处理各种类型的文档,包括但不限于:

- 商业文档:如合同、报告和财务报表。

- 学术论文:涵盖各种学科的研究论文。

- 技术报告:如工程设计文档和实验报告。

- 专利文件:包含复杂的图表和技术说明。

- 表格和代码:能够精确识别并转换表格内容和代码片段。

SmolDocling 不仅能够识别文档中的文本内容,还能理解其布局结构,例如标题、段落、列表、图表、公式等元素的位置和类型。此外,它还能将这些元素以统一的格式输出,便于后续的处理和分析。

主要特点

SmolDocling 的设计具有以下显著特点:

- 超紧凑模型:SmolDocling 基于 Hugging Face 的 SmolVLM-256M 架构,参数量仅为 256M,远小于常见的大型视觉语言模型(如 Qwen2.5-VL 和 GPT-4o)。这使得 SmolDocling 在保持高性能的同时,显著降低了计算资源需求,提高了模型的可扩展性和实用性。

- 端到端转换:与传统的多步骤文档处理流程不同,SmolDocling 能够直接从文档图像生成结构化的 DocTags 格式,无需依赖复杂的预处理或后处理步骤。这种端到端的处理方式不仅提高了效率,还减少了因多步骤处理导致的误差累积。

- 丰富的输出格式:SmolDocling 输出的 DocTags 格式能够详细描述文档的结构和内容,包括文本、图表、表格、代码等元素的位置和类型。这种格式不仅易于人类阅读,也便于机器解析和进一步处理。

- 多模态理解:SmolDocling 结合了视觉和语言处理能力,能够同时处理文档的图像和文本内容,实现更全面的文档理解。

工作原理

SmolDocling 的工作原理基于深度学习中的视觉语言模型(VLM)架构。其主要流程如下:

- 视觉编码:输入的文档页面图像首先通过一个视觉编码器(如 SigLIP)进行处理,提取图像的视觉特征。这些特征被重新整形并通过投影和池化操作转换为与语言模型兼容的格式。

- 文本提示融合:视觉特征与用户提供的文本提示(如任务描述)的文本嵌入相结合,形成一个统一的输入序列。

- 自回归预测:结合后的序列被送入一个大型语言模型(LLM),模型通过自回归的方式逐步预测 DocTags 格式的输出序列。这个过程利用了 LLM 的强大生成能力和对上下文的理解能力,生成结构化的文档表示。

- DocTags 格式:输出的 DocTags 格式能够详细描述文档的结构和内容,包括文本、图表、表格、代码等元素的位置和类型。这种格式不仅易于人类阅读,也便于机器解析和进一步处理。

应用场景

SmolDocling 的高效性和多功能性使其在多个领域具有广泛的应用前景:

- 学术研究:在学术界,SmolDocling 可以快速将学术论文和研究报告转换为结构化的格式,便于研究人员提取关键信息、进行文献综述和数据分析。

- 商业文档处理:企业可以利用 SmolDocling 将商业文档(如合同、报告)快速转换为可编辑和可分析的格式,提高工作效率和信息管理能力。

- 技术文档管理:对于技术文档(如工程设计文档、用户手册),SmolDocling 能够准确提取表格、代码和图表等关键信息,便于技术团队进行文档维护和知识共享。

- 专利分析:在专利领域,SmolDocling 可以帮助研究人员和专利律师快速提取专利文档中的技术细节和图表,加速专利检索和分析过程。

- 教育领域:教师和学生可以利用 SmolDocling 将教学材料(如讲义、教材)转换为电子格式,便于在线教学和学习。

- 医疗文档处理:在医疗领域,SmolDocling 可以处理医疗报告和研究论文,提取关键信息,辅助医疗决策和研究。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...