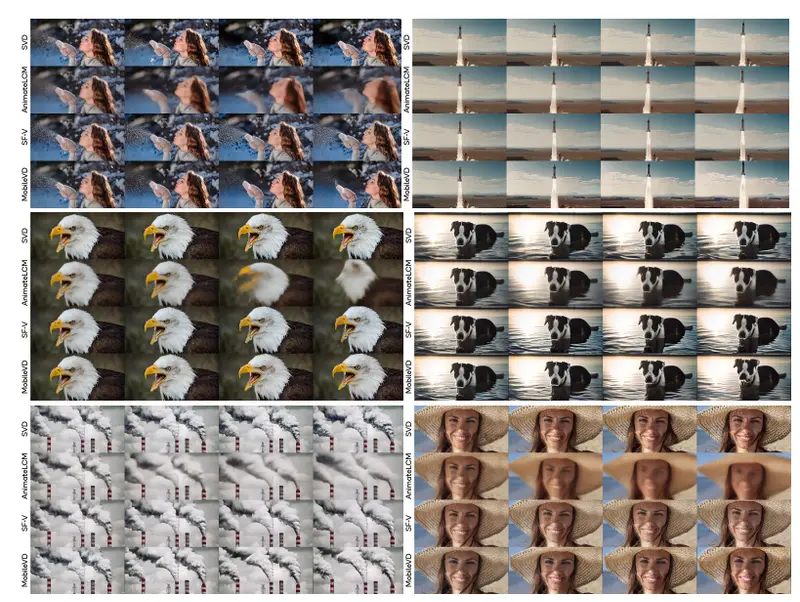

高通AI研究院推出了一个为移动设备优化的视频生成模型Mobile Video Diffusion(MobileVD),该模型的目标是在保持生成视频的质量和控制力的同时,显著降低计算需求,使得在移动设备上使用视频扩散技术成为可能。MobileVD通过优化Stable Video Diffusion(SVD)中的时空UNet,并引入了新的剪枝技术,显著减少了内存和计算需求。

例如,我们想要在手机上生成一个短视频,内容是一个在公园里跑步的人。使用MobileVD,我们可以从一个静态图片开始,通过迭代去噪过程,生成一系列连贯的帧,最终形成一个视频。这个过程不仅需要考虑到视频中的人物动作,还要处理背景、光照变化等,以确保视频的逼真度和连贯性。

主要功能:

- 视频生成:在移动设备上生成高质量的视频内容。

- 计算优化:通过模型优化,显著降低了视频生成的计算和内存需求。

- 实时性:能够在较短的时间内完成视频的生成,适合实时应用。

主要特点:

- 高效率:MobileVD比SVD快523倍,计算量从1817.2 TFLOPs降低到4.34 TFLOPs。

- 质量保持:尽管计算量减少,但视频质量(以FVD衡量)仅略有下降,从171降低到149。

- 快速部署:能够在智能手机上快速生成视频,如在Xiaomi 14 Pro上1.7秒内生成一个14帧的512×256像素视频。

工作原理:

MobileVD的核心是优化SVD模型,通过以下方式实现:

- 降低分辨率:减少UNet输入的空间分辨率,以适应移动设备的内存限制。

- 多尺度表示:在UNet中引入额外的时空下采样和上采样操作,以减少内存和计算成本。

- 通道压缩:通过通道漏斗(channel funneling)技术减少模型参数。

- 剪枝技术:通过学习性剪枝技术减少UNet中的时空块数量。

- 单步去噪:采用对抗性微调,将去噪步骤减少到单步,加速视频生成。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...