来自加州大学伯克利分校、牛津大学、哈佛大学、卡耐基梅隆大学、香港大学、加州大学戴维斯分校的研究人员推出数据生成管道Gen4Gen,它用于创建一个名为MyCanvas的数据集,旨在提高文本到图像扩散模型在个性化多概念合成方面的性能。这个项目的目标是解决当前个性化技术在处理多个概念时的局限性,特别是在复杂场景和简单文本描述之间存在不匹配的问题。

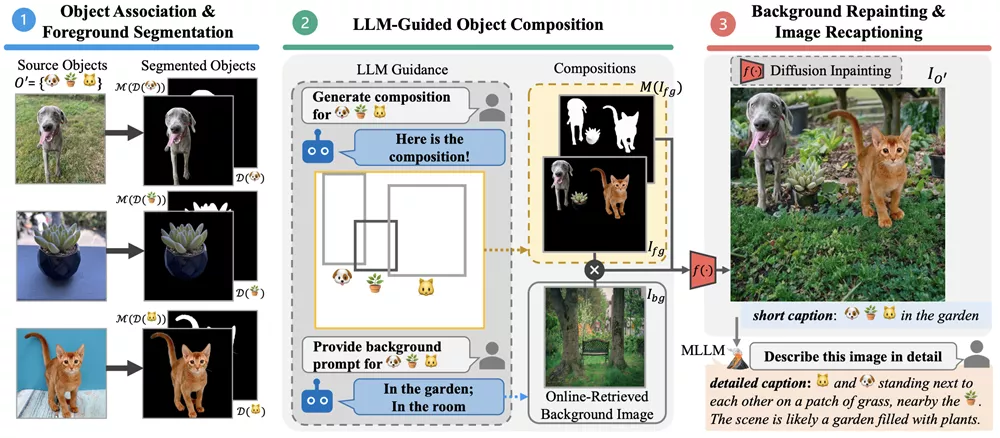

这个数据管道结合了最新的生成性模型,例如前景提取、大语言模型(LLM)、多模态大语言模型(MLLM)和图像修复技术,以半自动方式创建高质量的个性化图像和文本描述。

主要功能和特点包括:

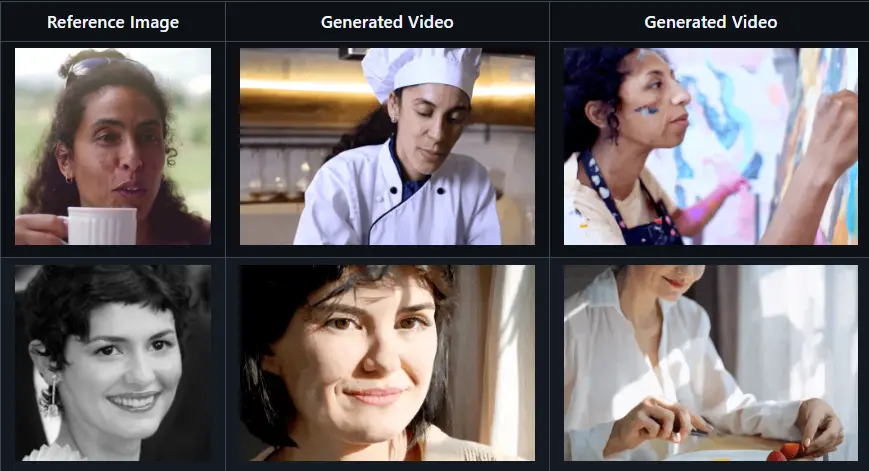

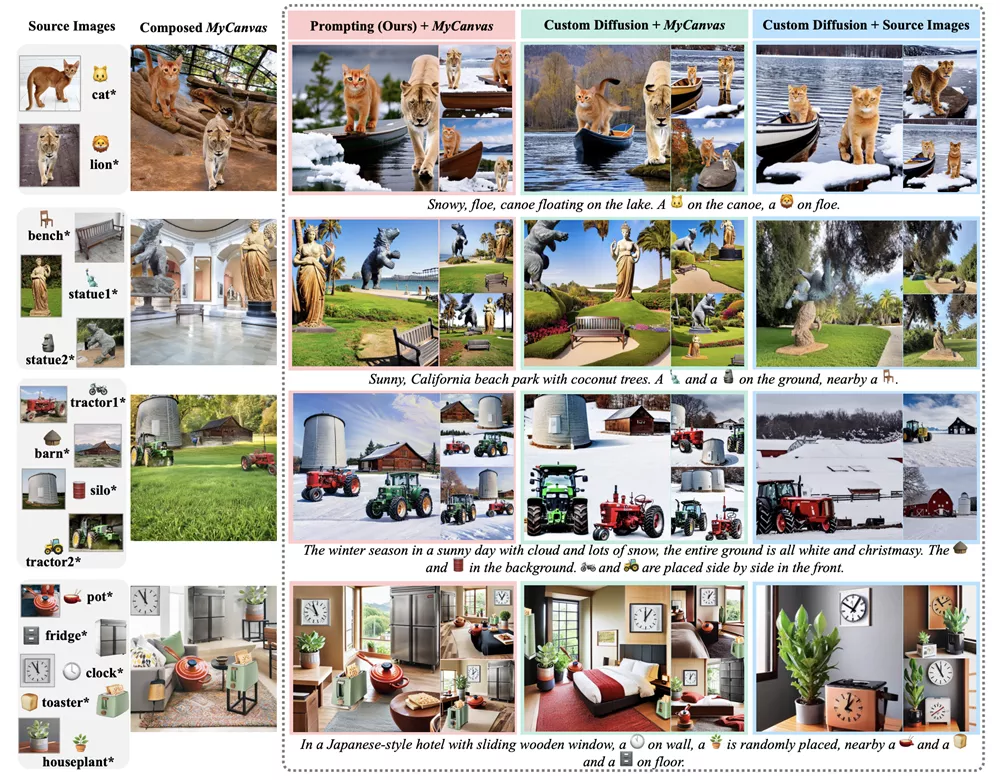

主要功能是利用用户提供的少量图片代表多个概念,然后通过Gen4Gen管道将这些概念组合成现实的场景,并提供详细的文本描述。

- 半自动化数据集创建:Gen4Gen利用生成模型将个性化概念组合成复杂场景,并伴随详细的文本描述。

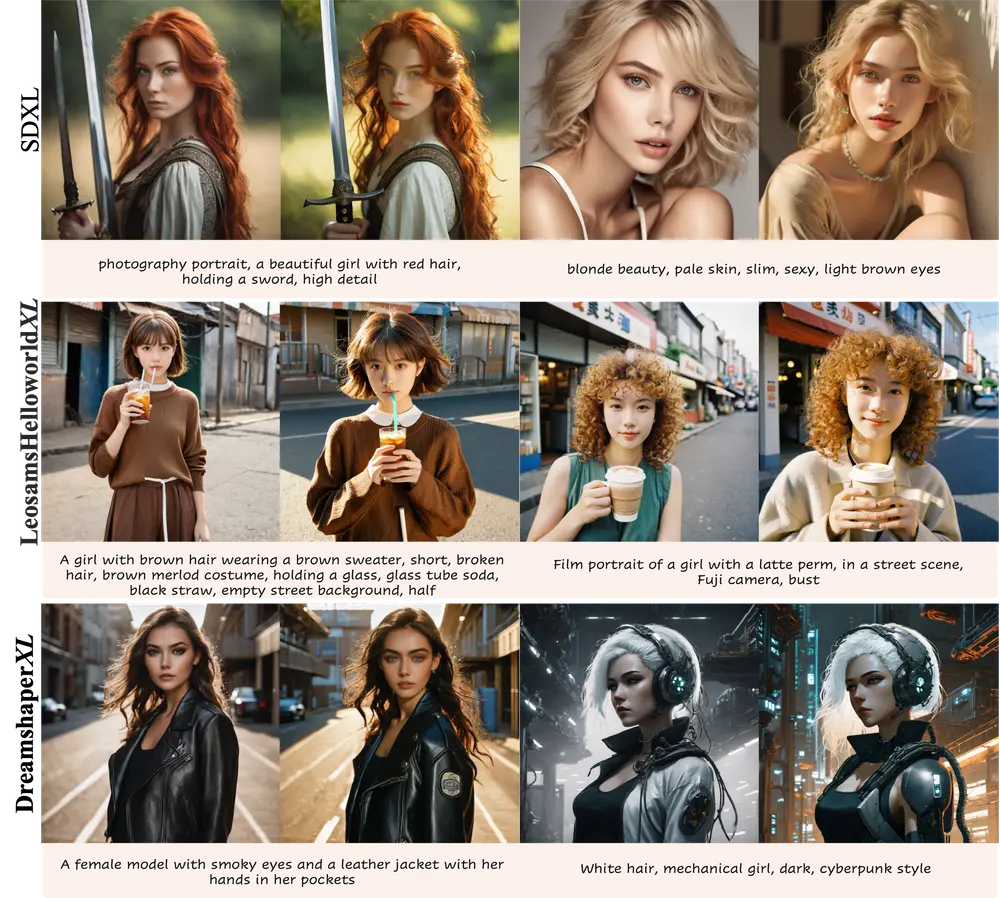

- 高质量数据集:MyCanvas数据集包含超过10,000张图像,这些图像在质量上经过人工筛选,以确保高分辨率和真实感。

- 全面评估指标:论文提出了两个评估分数(CP-CLIP和TI-CLIP),用于更全面地量化多概念个性化文本到图像扩散方法的性能。

工作原理:

- 对象关联与前景分割:首先,使用类别无关的显著性对象检测器来分割给定对象的前景。

- LLM引导的对象组合:然后,利用大型语言模型(LLM)提供可能的边界框组合,形成复合前景图像及其对应的掩模。

- 背景重绘与图像重描述:使用扩散模型将前景图像嵌入到互联网上检索到的背景图像中,生成最终图像。同时,使用多模态大型语言模型(MLLM)为最终图像提供详细描述。

具体应用场景:

- 个性化图像生成:MyCanvas数据集可以用于训练和评估文本到图像扩散模型,以生成包含用户个性化概念(如宠物、特定物品等)的图像。

- 图像编辑和合成:在图像编辑软件中,可以使用Gen4Gen技术来合成包含多个对象的复杂场景,用于创意设计或视觉效果制作。

- 教育和研究:在教育领域,MyCanvas可以作为教学工具,帮助学生理解复杂场景的构建和图像生成技术。

Gen4Gen和MyCanvas项目展示了通过改进数据质量和提示策略,可以在不修改模型架构或训练算法的情况下,显著提高多概念个性化图像生成的质量。这为计算机视觉社区在创建针对各种挑战性任务的高质量数据集方面提供了新的可能性。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...