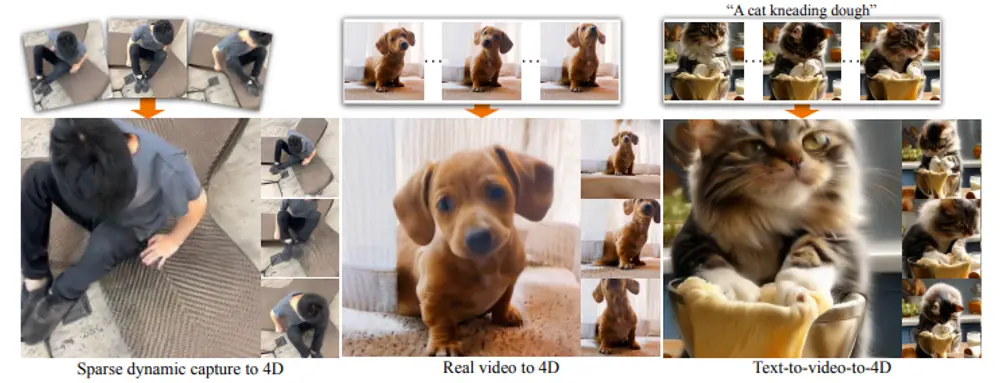

Google DeepMind、哥伦比亚大学和加州大学圣地亚哥分校的研究人员推出创新技术CAT4D,用于从单目视频创建4D(动态3D)场景。CAT4D利用多视图视频扩散模型,结合多种数据集进行训练,以实现在任何指定的相机姿态和时间戳下进行新视角合成。这种方法可以将单个单目视频转换为多视图视频,并通过优化一个可变形的3D高斯表示来进行稳健的4D重建。

例如,你有一个视频,内容是一只猫在揉面团。使用CAT4D技术,可以从这个视频创建出4D场景,让你能够从任意新的角度和时间点观察这个场景,就像你真的在不同时间和不同位置观察真实世界中的猫一样。

主要功能和特点

- 新视角合成:能够在任何指定的时间和视角下合成场景的图像。

- 多视图视频生成:从单目视频生成多视图视频,增加了视角的多样性。

- 4D重建:通过优化3D高斯表示,重建动态场景。

- 数据集多样性:结合了真实和合成数据源,提高了模型的泛化能力。

- 创意能力:能够从真实或生成的视频生成4D场景。

工作原理

CAT4D的工作流程分为两个阶段:

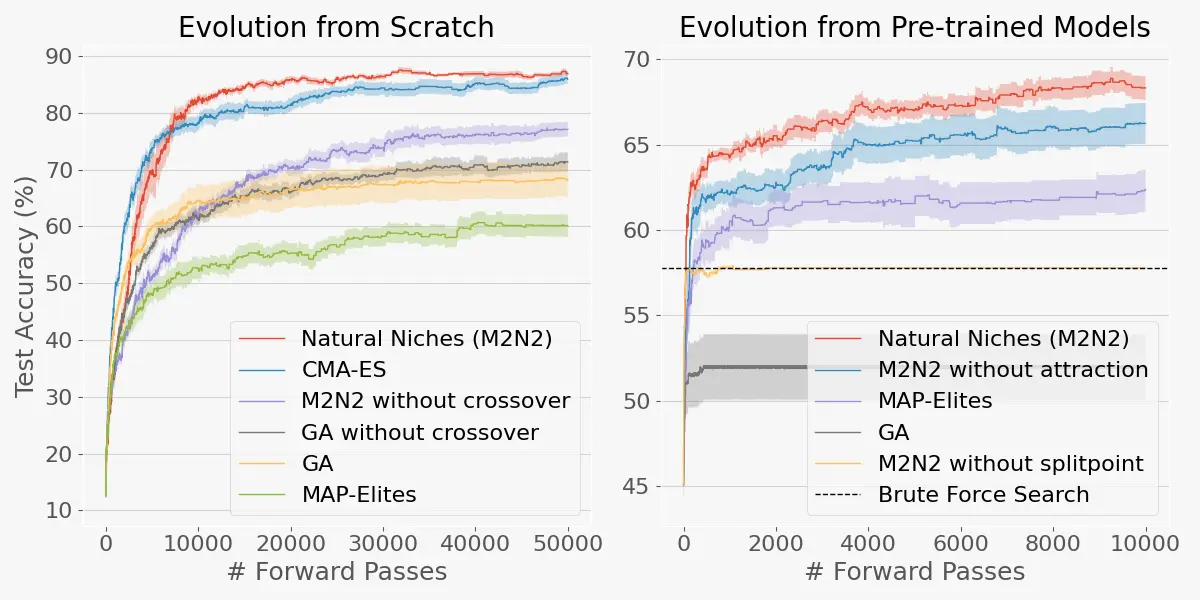

- 多视图视频扩散模型:接受不同视点和时间捕获的输入图像,并合成在任何指定新视点和新时间下的场景外观。这个模型基于CAT3D的扩散模型构建,通过3D自注意力机制连接所有图像潜在表示,并引入时间条件编码来增强时间对齐。

- 动态3D场景重建:使用生成的多视图视频,通过优化一个可变形的3D高斯表示来进行4D重建。这个过程涉及到从多视图视频中提取动态3D模型,并使用光度重建损失进行优化。

具体应用场景

- 电影制作:可以用于创建复杂的动态场景,提高视觉效果。

- 视频游戏:为游戏角色和环境提供更加真实的动态交互。

- 增强现实(AR):在AR应用中提供更加真实的3D场景,提升用户体验。

- 机器人技术:帮助机器人更好地理解和预测动态环境中的3D变化。

- 教育和模拟:创建虚拟的教育培训环境,模拟真实世界的动态场景。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...