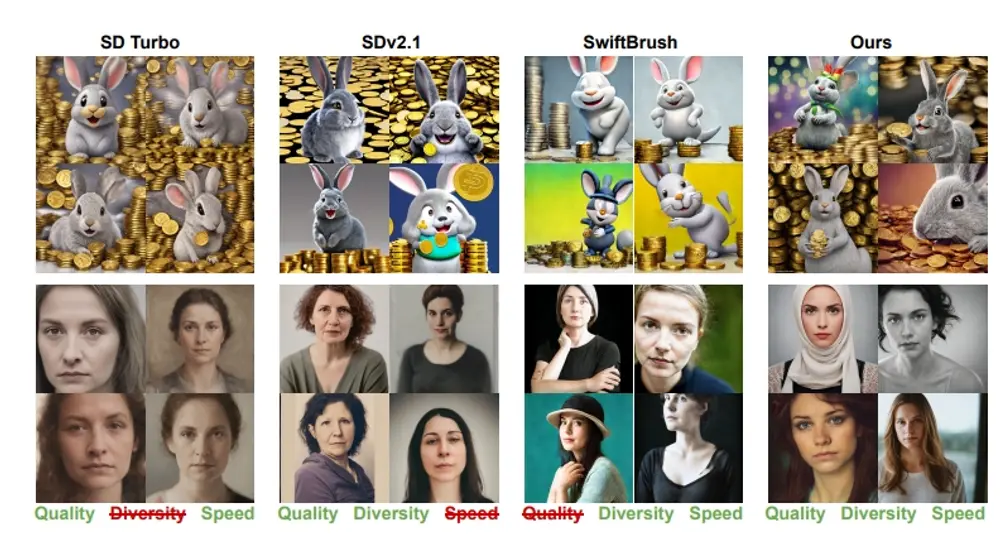

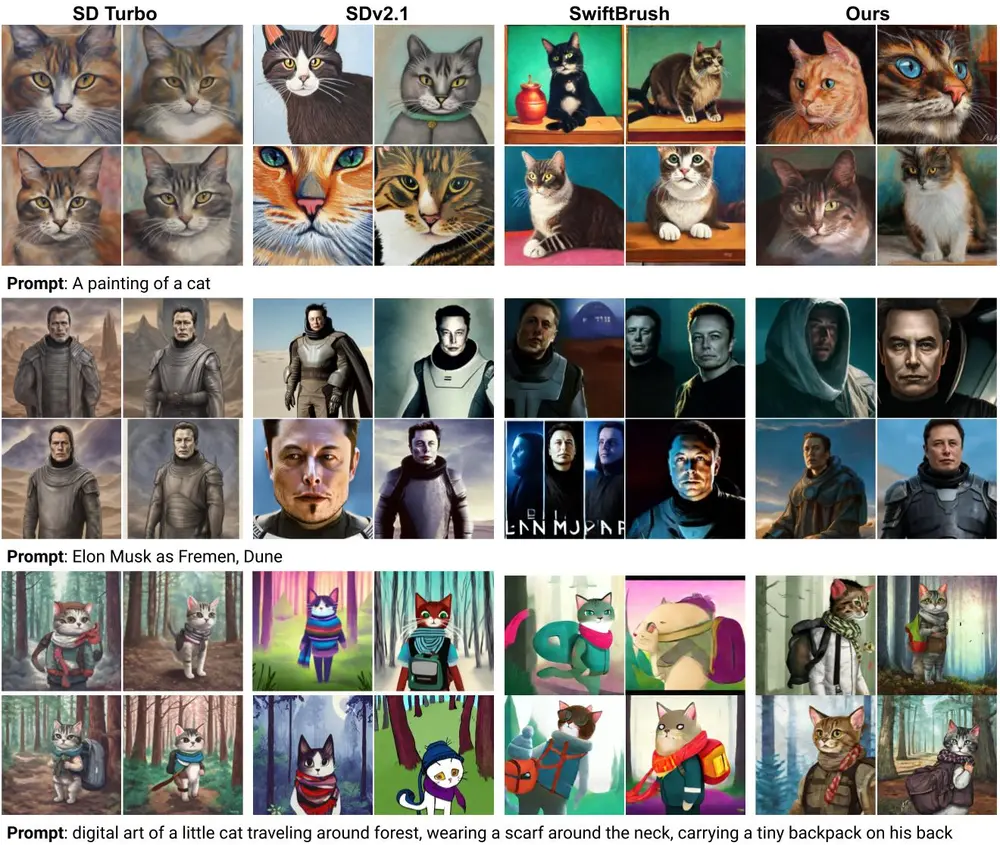

越南VinAI 研究和胡志明邮电技术学院的研究人员推出SwiftBrush v2,这是一个先进的文本到图像扩散模型,它通过优化训练方法和引入新的损失函数,比如“clamped CLIP loss”,来提高图像质量和文本图像对齐度。最终,通过模型融合技术,SwiftBrush v2 能够超越它的“老师”模型,生成比之前更优秀的图像。

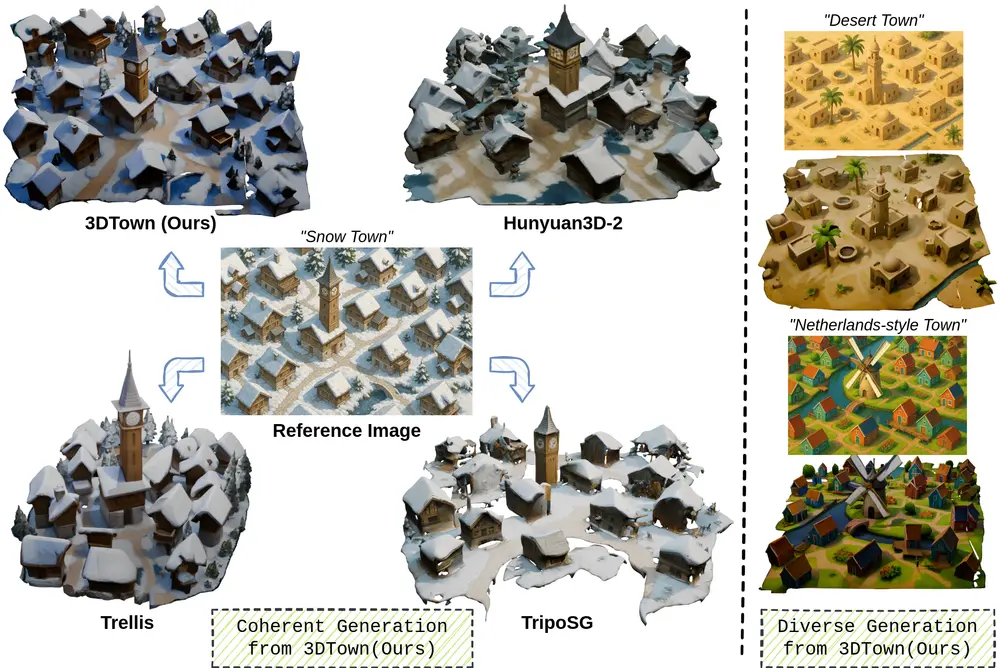

SwiftBrush是一款杰出的一步式文本到图像的扩散模型。起初,研究人员探讨了SwiftBrush与SD Turbo之间质量与多样性之间的权衡:前者在图像多样性方面表现出色,而后者则在图像质量上更胜一筹。这一观察结果激发了研究团队在训练方法上的改进提案,包括更好的权重初始化以及高效的LoRA训练。此外,研究团队引入了一种新颖的受约束CLIP损失函数,它增强了图像与文本的一致性,并带来了图像质量的提高。值得一提的是,通过结合使用高效LoRA训练和全量训练得到的模型权重,研究团队实现了一款新的最先进的一步式扩散模型,该模型达到了8.14的FID分数,并超越了所有基于GAN的方法和多步稳定扩散模型。

例如,你是一位游戏设计师,需要快速预览一个场景的概念。你只需要描述你想要的场景,比如“一个未来都市,高耸的摩天大楼,霓虹灯闪烁”,AI 就能生成一幅接近你想象中的图像。这大大加快了设计过程,因为你不需要等待艺术家一笔一划地完成作品。

主要功能

- 文本到图像的转换:将文本描述直接转换成视觉图像。

- 高质量图像生成:生成高分辨率、逼真的图像。

- 多样化输出:能够根据同一描述生成风格多样的图像。

主要特点

- 一步生成:与多步骤生成过程不同,这种模型能够一步生成最终图像,大大提高了效率。

- 图像与文本的高匹配度:生成的图像与输入的文本描述高度相关。

- 无需额外训练数据:使用一种称为“Variational Score Distillation”的方法,可以在不需要额外图像数据的情况下训练模型。

工作原理

这个过程就像是有一个魔法画布,开始时是一片混乱的噪声。AI 模型通过阅读你提供的文本描述,逐渐在这画布上“扩散”出清晰的图像。这个过程称为“扩散模型”,它通过模拟数据从有序状态逐渐变为无序状态,然后再学习如何逆转这一过程,从而从噪声中恢复出清晰的图像。

具体应用场景

- 艺术创作辅助:帮助艺术家快速生成草图或概念图。

- 游戏和电影行业:快速生成场景概念,加速前期制作流程。

- 广告和营销:根据广告文案快速生成吸引人的视觉内容。

- 社交媒体:用户可以根据自己的描述生成个性化的图像和表情包。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...