随着技术的进步,视频生成模型已经能够创造出令人惊叹的高质量视频片段。然而,这些模型在实际应用中面临着一些显著的障碍,主要集中在计算资源的需求上。目前市场上的领先模型,例如Sora、Runway Gen-3以及Movie Gen,虽然能够生成极为逼真的视频内容,但它们的训练和运行却需要大量的计算资源,包括成千上万的GPU和数百万小时的训练时间。此外,每生成一秒钟的视频往往需要几分钟的时间,这无疑增加了使用成本,限制了这类技术的应用范围。

新方案:Reducio-DiT

为了解决上述问题,来自复旦大学和微软的研究团队共同开发了一种新的解决方案——Reducio-DiT。这一创新性模型通过引入图像条件下的变分自编码器(VAE),有效地压缩了视频数据的潜在空间,从而大幅度减少了存储和处理视频所需的数据量。Reducio-DiT的关键在于其能够识别并利用视频中的冗余信息,在保证视频质量的前提下,将潜在表示的空间压缩至原来的1/64。

主要功能

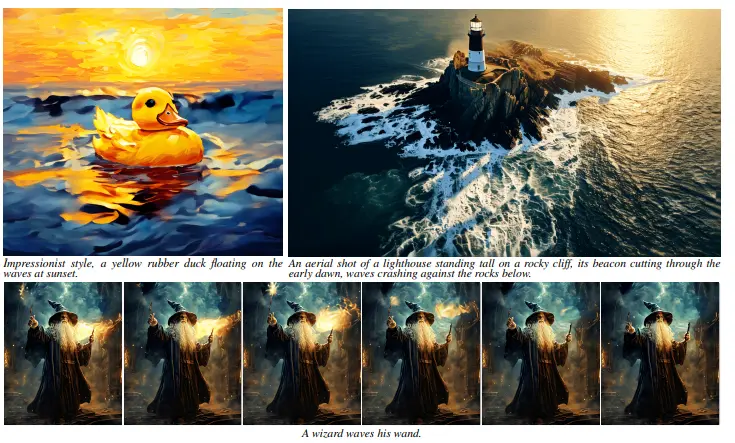

视频压缩:将视频编码到一个极小的潜在空间,相比传统的2D VAE,Reducio-VAE能够实现64倍的潜在空间压缩。 高分辨率视频生成:能够生成1024×1024分辨率的视频,且生成速度快。 文本到视频的生成:采用两阶段视频生成范式,先进行文本到图像的生成,然后基于文本和图像生成视频。

主要特点

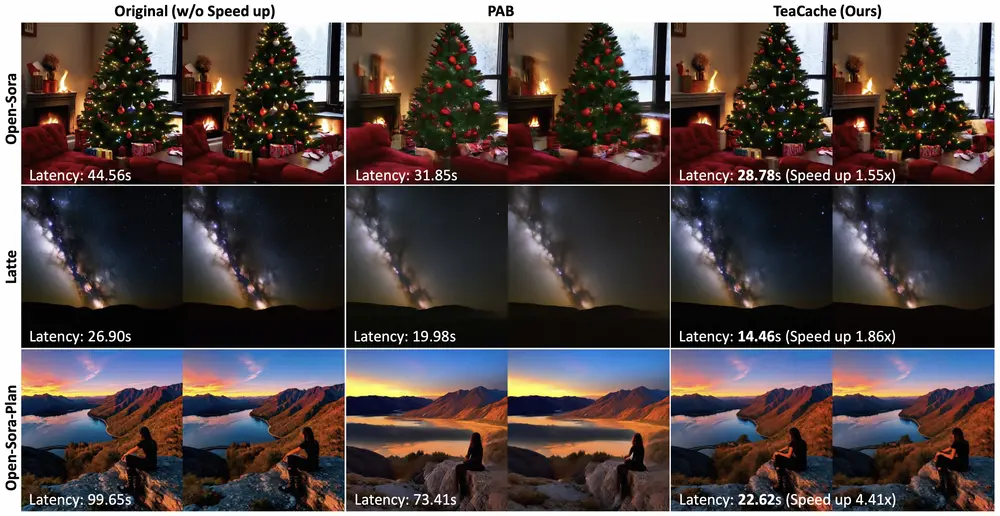

高效的训练和推理:模型在训练和推理时的效率显著提高,能够在单个A100 GPU上在15.5秒内生成16帧的1024×1024视频剪辑。 高保真度:即使在极端压缩的情况下,也能保持视频的高保真度。 内容图像条件:利用内容图像作为条件,进一步压缩视频潜在空间,仅用少量潜在变量表示运动信息。

工作原理

Reducio-VAE:通过3D编码器将输入视频压缩到一个4096倍下采样的紧凑空间,并使用3D解码器结合中间帧的特征金字塔作为内容条件进行重建。 Reducio-DiT:基于Reducio-VAE,使用扩散变换器(DiT)模型,结合文本条件和图像条件,实现快速训练和高质量视频生成。

技术亮点

高效压缩:Reducio-DiT通过其独特的VAE设计,实现了视频潜在空间的高效压缩,压缩率达到了惊人的4096倍。 双阶段生成机制:首先,利用文本到图像的技术生成基础图像;随后,基于这些图像作为先验知识,通过扩散模型生成视频帧。这种方法有效地分离了视频中的运动信息和静态背景,进一步优化了计算效率。 保持视觉一致性和时间连贯性:通过多阶段训练策略,确保生成的视频不仅在视觉上具有高度的一致性,而且在时间维度上也表现出良好的连贯性。

实际应用价值

Reducio-DiT不仅极大地提高了视频生成的速度和效率,更重要的是,它为那些受限于计算资源的行业提供了一个更加经济实惠的选择。相比之前的方法,Reducio-DiT在UCF-101数据集上的表现尤为突出,速度提升了16.6倍,同时保持了优秀的视频质量(FVD评分318.5)。这标志着高分辨率视频生成技术正逐渐变得更加普及和可访问,为视频内容创作者提供了更多的可能性。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...