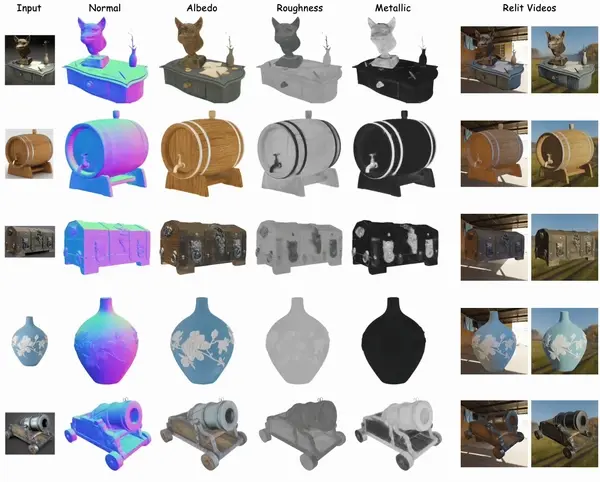

上海交通大学、中国科学技术大学、香港中文大学和上海人工智能实验室的研究人员推出为BroadWay,它能够提升文生视频模型的质量,而且不需要额外的训练。这就像是给视频生成模型安装了一个“涡轮增压器”,让它在不增加额外负担的情况下,生成更加流畅和动态的视频。

BroadWay 由两个主要组件组成:1)时间自引导通过减少不同解码器块之间的时间注意力图差异,提高了生成视频的结构合理性和时间一致性。2)基于傅里叶的运动增强通过放大地图的能量,增强了运动的幅度和丰富性。广泛的实验表明,BroadWay 显著提高了文本到视频生成的质量,且几乎没有额外的成本。

主要功能:

BroadWay的主要功能是提高文本到视频生成模型的输出质量。具体来说,它通过改进视频中的时间一致性和动作幅度,解决了生成视频可能出现的结构不合理、时间不一致,以及动作缺乏等问题。

主要特点:

- 无需训练:BroadWay是一种无需额外训练的方法,这意味着它可以在不增加计算成本的情况下提升现有模型的性能。

- 即插即用:它可以轻松地集成到现有的T2V模型中,无需修改模型的内部结构。

- 参数自由:BroadWay不引入新的参数,而是通过调整现有模型的注意力机制来提升性能。

工作原理:

BroadWay主要通过两个组件来工作:

- 时间自引导(Temporal Self-Guidance):这个组件通过减少不同解码器块之间的时间注意力图的差异,来提高视频结构的合理性和时间一致性。

- 基于傅里叶的运动增强(Fourier-based Motion Enhancement):这个组件通过放大时间注意力图中的高频成分来增强视频中的动作幅度和丰富性。

具体应用场景:

BroadWay可以应用于多种需要将文本转换为视频的场景,例如:

- 娱乐和社交媒体:用户可以输入一段描述性的文本,生成相应的视频内容,用于娱乐或在社交媒体上分享。

- 教育和培训:在教育领域,可以根据教科书中的描述自动生成教学视频,帮助学生更好地理解复杂的概念。

- 新闻和报道:新闻机构可以利用BroadWay快速生成新闻报道的背景视频,提高报道的吸引力。

- 广告和营销:营销人员可以基于产品描述生成吸引人的视频广告,以吸引潜在客户的注意力。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...