想象一下,你拍了一段空无一人的街道视频,现在想把一只奔跑的猫放进画面里——不仅要让它看起来真实,还要让它和周围环境产生互动:地上要有影子,经过水坑要有倒影,被路灯照到要反光。更神奇的是,你只需要告诉AI"猫在第一帧站在这里,最后一帧跑到那里",它就能自动算出中间所有帧的画面,让猫自然地跑完全程。

这就是PISCO想要实现的目标:精准视频实例插入——把任意物体插入现有视频,让它在指定时间、指定位置出现,并自动产生逼真的运动和场景互动。

解决了什么问题?

目前AI视频编辑领域面临一个尴尬局面:

- 传统视频修复工具需要你一帧一帧画出物体的轮廓,工作量巨大

- 参考图引导的编辑方法只能大概控制风格,无法精确指定"物体在第3秒出现在画面左边"

- "先修图再生成视频"的流程会破坏原视频的背景,导致画面闪烁或变形

- 基于3D重建的方法计算量巨大,而且对复杂运动束手无策

PISCO要解决的核心问题是:如何让普通用户用最少的工作量(只提供几张关键帧),就能在视频中精准插入物体,并保证画面自然、物理合理、背景不变?

- 项目主页:https://xiangbogaobarry.github.io/PISCO

- GitHub:https://github.com/taco-group/PISCO

- 模型:https://huggingface.co/xiangbog

研究背景

AI视频生成技术正在从"生成一段还行的视频"向"精准控制视频的每个细节"转变。对于电影制作、广告后期、短视频创作等专业领域,创作者需要的不是"差不多"的效果,而是"指哪打哪"的精确控制。

PISCO由德州农工大学、Visko平台、韩国科学技术院和斯坦福大学的研究团队联合开发,团队目前已释出模型,此模型是基于阿里开源的Wan系列模型。

主要功能

PISCO就像一个精通视频魔术的AI导演,核心能力可以概括为:

1. 精准时空控制——想放哪就放哪

- 单帧控制:只提供第一帧的物体图片和位置,AI自动推断后续运动

- 首尾帧控制:提供第一帧和最后一帧,AI自动补全中间过程

- 任意关键帧控制:在任意时间点插入控制帧,AI灵活调整运动轨迹

2. 自动运动传播——物体自己会动

插入的物体不会僵在原地,而是会根据场景自动产生合理的运动:

- 汽车会沿着道路行驶,转弯时车身会倾斜

- 人物会自然地走路、跑步,肢体动作协调

- 物体会受重力影响,抛物线轨迹符合物理规律

3. 物理场景适应——和周围环境互动

插入的物体不会"浮"在画面上,而是会和场景产生真实的互动:

- 光影效果:物体表面会反射环境光,产生符合光源方向的明暗变化

- 阴影投射:物体会在地面、墙面投下逼真的影子

- 水面倒影:经过水坑、湖面时会产生倒影和涟漪

- 遮挡关系:当物体走到树后、车后会自然被遮挡

4. 背景严格保留——只改想改的地方

原视频中的其他元素完全不受影响:

- 背景中的行人、车辆继续原来的运动

- 风吹树叶、水流波动等自然现象保持不变

- camera移动、变焦等拍摄手法完整保留

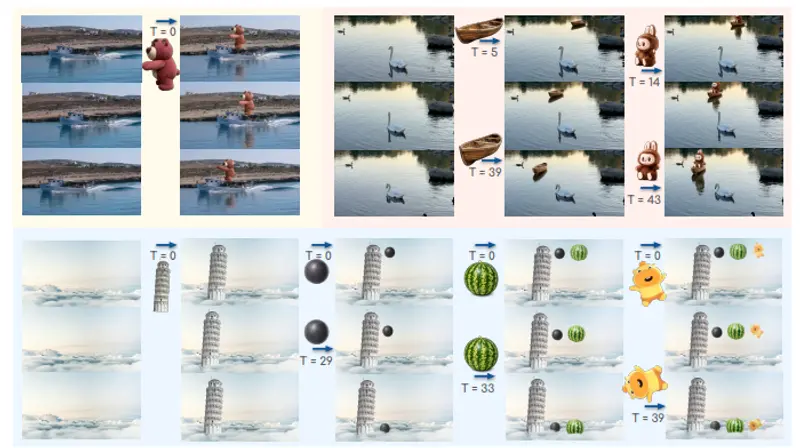

5. 扩展应用——不止于插入

基于同样的技术,PISCO还能实现:

- 背景替换:保留前景人物,换一个新的背景场景

- 物体 repositioning:把画面中的物体移到另一个位置

- 速度调整:让物体运动变快或变慢

- 尺寸调整:放大或缩小画面中的物体

- 动态模拟:创造"如果物体走另一条路会怎样"的假设场景

主要特点

相比现有的视频编辑方案,PISCO有四大核心优势:

特点一: sparse control——少即是多

这是PISCO最大的创新。传统方法需要用户逐帧标注物体的位置和形状,一个10秒的视频就要画250帧。而PISCO只需要用户提供几张关键帧(甚至可以只有一张),就能完成整个视频的插入。

这就像动画制作中的"关键帧动画"——原画师只画几个关键姿势,中间帧由助手补全。PISCO把这个过程完全自动化了。

特点二:分布保持技术——画面不闪烁

现有方法在处理 sparse 控制时,经常会出现画面闪烁、颜色突变、物体时隐时现等问题。这是因为AI模型在处理"部分信息缺失"时会产生不稳定的输出。

PISCO发明了分布保持时序掩码技术(DPTM)——先用最近的关键帧填补缺失的画面,保持视频的整体连贯性,再在内部标记哪些是真数据、哪些是填补的,让AI既能参考填补信息,又不会把它当成真实指令。这彻底解决了闪烁问题。

特点三:几何感知——懂物理的AI

PISCO不仅懂图像,还懂三维空间关系。通过引入深度信息,它能判断:

- 物体应该在前景还是背景

- 什么时候应该被其他物体遮挡

- 光线从哪个方向来,阴影应该投在哪里

这让插入的物体不再是"贴图",而是真正"融入"场景。

特点四:可扩展性——控制越多,效果越好

PISCO的设计非常灵活:用户提供的关键帧越多,效果就越好,但即使只有很少的控制,也能产出可用的结果。这种"渐进式改进"的特性,让不同需求的用户都能找到适合自己的工作流。

工作原理

用大白话讲,PISCO是怎么实现" sparse 控制"的?

可以把PISCO的工作流程想象成一个"接力赛"式的创作过程:

第一步:准备素材(数据预处理)

就像导演拍摄前需要准备场景和道具,PISCO需要两类素材:

- 干净背景视频:去掉目标物体的原始视频(可以用AI自动去除)

- 物体素材:目标物体的图片、轮廓、深度信息

深度信息就像是物体的"3D身份证",告诉AI这个物体哪里凸、哪里凹,距离镜头有多远。

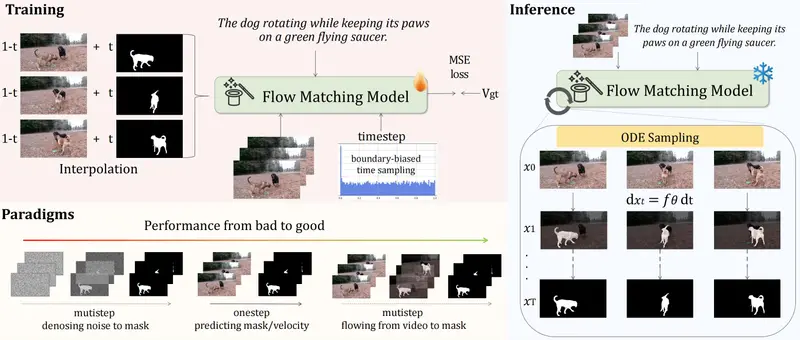

第二步:动态信息引导(VIG)——学会"举一反三"

这是PISCO的训练秘诀。研究人员在训练时,会随机"藏"掉大部分关键帧信息,只留一小部分让AI学习。

比如一个50帧的视频,训练时可能只给AI看第1帧、第25帧和第50帧,其他帧都屏蔽掉。AI必须学会根据这三帧,推断出中间47帧的画面。

这种训练方式让PISCO具备了强大的"脑补"能力——即使只给一帧,它也能合理推断后续运动;给的帧越多,推断就越准确。

第三步:分布保持时序掩码(DPTM)——解决闪烁难题

这是PISCO的核心技术创新。当用户只提供 sparse 关键帧时,存在一个技术难题:

视频AI模型通常先把视频压缩成"令牌"(一种数字摘要)再处理。如果直接把缺失的帧填成黑色,压缩后的令牌会"分布异常",导致输出画面闪烁、变色。

PISCO的解决方案很聪明:

- 像素级填补:先用最近的关键帧复制填补缺失的帧,让整个视频看起来是完整的

- 令牌级掩码:在压缩后的令牌中,标记出哪些是真实数据、哪些是填补的

- 可用性通道:专门设计一个信号通道,告诉AI"这一帧是真的还是假的"

这样既保持了视频的整体连贯性(分布正常),又让AI知道该信什么、不该信什么。

第四步:几何感知条件——让物体"立"在场景中

为了让插入的物体和场景互动自然,PISCO引入了深度信息:

- 背景深度:告诉AI场景的远近关系,哪里是地面、哪里是远景

- 物体深度:告诉AI物体的立体形状

当AI知道"物体在3米外,地面在脚下,路灯在左上方"时,它就能自动计算出合理的阴影、倒影和遮挡关系。

第五步:外观增强训练——应对复杂情况

现实场景很复杂:物体可能被部分遮挡,光线可能不均匀。PISCO通过两种增强技术提升鲁棒性:

- 非模态补全:训练AI想象"被挡住的部分长什么样",这样即使输入的物体图片不完整,也能生成完整的插入效果

- 重光照增强:训练AI适应不同的光照条件,让物体能自然融入各种光线环境

第六步:渐进式训练——从简单到复杂

PISCO的训练分为五个阶段,循序渐进:

- 适配器预热:先学会接收新的输入格式

- 适配器微调:优化条件注入方式

- 联合微调:让整个系统协同工作

- 增强训练:加入复杂情况的处理能力

- 分辨率扩展:从低分辨率逐步提升到高分辨率

这种渐进式训练保证了模型的稳定性和最终效果。

测试结果

PISCO在严格的基准测试中表现优异,以下是关键结果:

测试一:与现有方法的全面对比

研究人员在PISCO-Bench基准测试上对比了多种方案:

- "修图+视频生成"流程:背景保真度很差,原视频的细节大量丢失

- 视频修复模型(CoCoCo、VideoPainter):需要逐帧掩码,且生成的物体经常模糊或变形

- 参考引导的视频编辑(VACE、UniVideo):无法控制精确位置,物体尺寸和轨迹经常出错

相比之下,PISCO在各项指标上都明显优于这些基线方法。

关键发现:sparse 控制的优势

当只提供第一帧控制时,PISCO已经能生成合理的结果;当提供首尾两帧时,效果大幅提升;当提供五帧控制时,质量达到最佳。

这验证了PISCO的核心设计理念:控制信号越多,效果越好,但即使很少的控制,也能产出可用的结果。

测试二:主观质量评估

在VBench感知质量评测中(评估视频的审美质量、运动平滑度、时序一致性等):

- PISCO在"主体一致性"(插入的物体是否保持同一外观)上得分超过91分,显著优于其他方法

- 在"图像质量"和"审美质量"上也位居前列

- 背景保持能力与专门的修复模型相当,同时运动质量更好

测试三:扩展应用验证

研究人员测试了PISCO的多种扩展功能:

- 背景替换:能保留前景物体的同时,生成全新的背景场景

- 物体重定位:能把物体移到新位置,并自动调整光影和遮挡

- 速度调整:能通过调整关键帧间隔,实现加速或减速效果

- 尺寸调整:能放大或缩小物体,并保持场景比例协调

这些扩展功能都无需重新训练,直接利用PISCO的核心能力即可实现。

关键结论

- sparse 控制是可行的:不需要逐帧标注,几张关键帧就能实现高质量的视频实例插入

- 分布保持技术有效:DPTM技术彻底解决了 sparse 控制导致的闪烁和变色问题

- 几何感知很重要:引入深度信息显著提升了物理合理性和场景融合度

- 可扩展性强:控制信号越多,效果越好,用户可以根据需求灵活选择

未来展望

PISCO代表了AI视频编辑向"精准控制"迈进的重要一步。未来的发展方向可能包括:

- 实时化:从离线处理发展到实时编辑,让用户即时看到效果

- 交互式编辑:支持用户中途调整,AI实时响应修改

- 多物体协同:同时插入多个物体,并让它们之间产生合理的互动

- 物理仿真增强:不仅能生成逼真画面,还能预测物体的物理行为(如碰撞、破碎)

当这些技术成熟,"用说话的方式做视频特效"将成为现实——每个人都能成为自己生活的导演。

相关文章