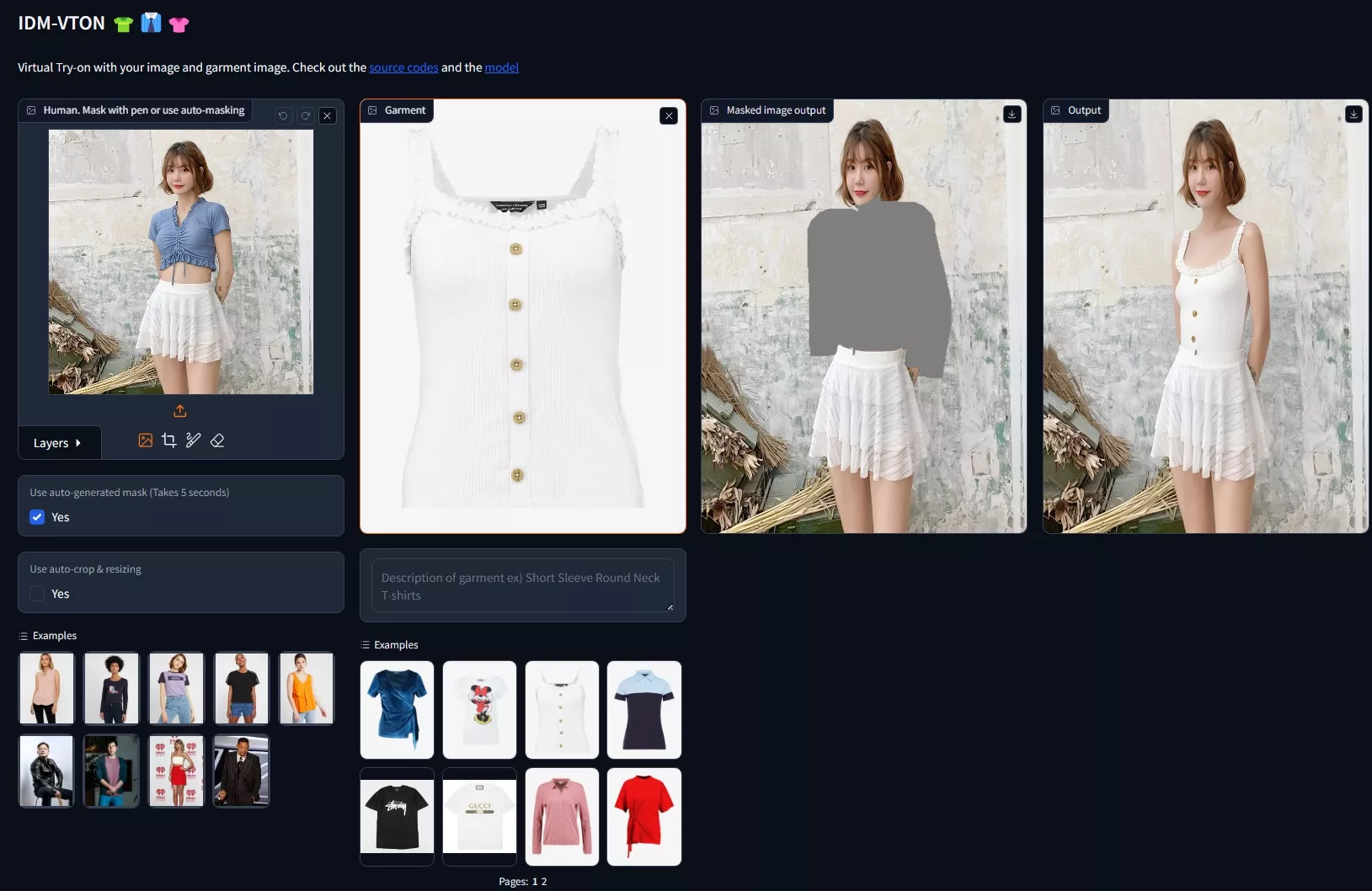

来自韩国科学技术院和OMNIOUS.AI的研究人员推出虚拟服装试穿技术IDM-VTON,该技术能够根据分别描绘人物和服装的图像对,渲染出人物穿着精选服装的视觉效果。虚拟试穿是一种计算机视觉技术,它可以根据一个人的图片和一件衣服的图片,生成这个人穿上这件衣服的图像。这项技术对于电子商务用户来说非常有用,因为它可以提供个性化的购物体验,让用户在不实际穿上衣服的情况下,就能预览衣服穿在自己身上的样子。

- 项目主页:https://idm-vton.github.io

- GitHub:https://github.com/yisol/IDM-VTON

- Demo:https://huggingface.co/spaces/yisol/IDM-VTON

- 模型地址:https://huggingface.co/yisol

例如,你在网上看到一个喜欢的T恤设计,但不确定它穿在你身上会是什么样子。使用这项技术,你可以上传一张你的照片,系统会生成一张你穿着这件T恤的图片。这样,你就能在购买之前有个大致的了解,这件衣服是否适合你。

相关:

主要功能和特点:

- 高保真度:该方法(IDM-VTON)能够生成高保真的虚拟试穿图像,这包括衣服的图案、纹理、形状和颜色等细节的精确呈现。

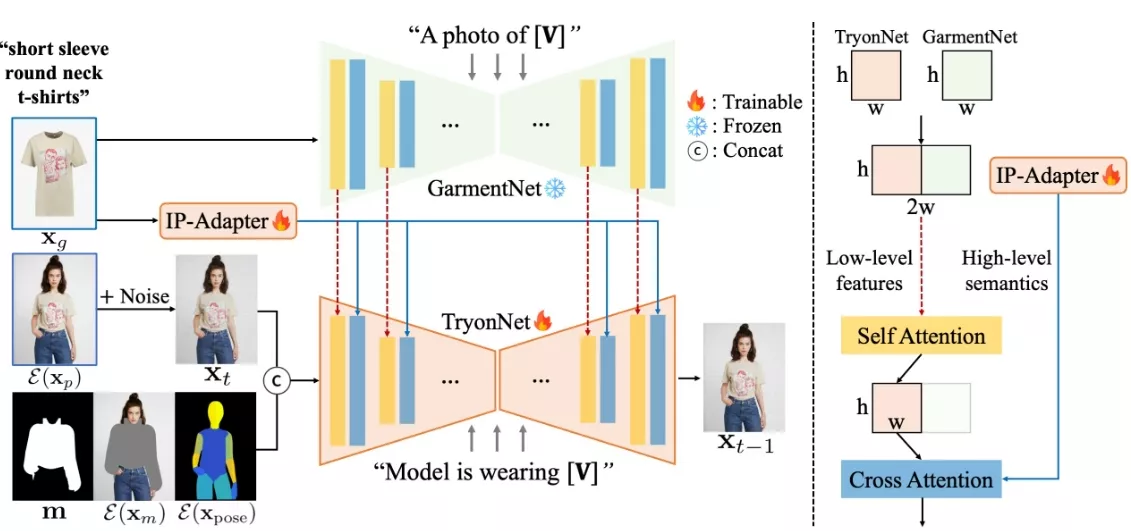

- 改进的扩散模型:通过设计新的注意力模块,将衣服图像的高层语义和低层特征有效地编码到基础的UNet模型中。

- 真实世界适应性:提出了一种定制化方法,使用一对人和衣服的图像对模型进行微调,以提高在真实世界场景中的适应性和图像质量。

- 详细的文本提示:为了增强生成图像的真实性,研究者们还提供了关于衣服和人物图像的详细文本提示。

工作原理:

- 扩散模型:这是一种生成模型,它通过逐步向数据中添加高斯噪声(正向过程)和逐步去噪(逆向过程)来生成样本。

- 文本到图像的扩散模型(T2I):这类模型能够根据文本提示生成图像,它们使用预训练的文本编码器对文本进行编码。

- 注意力机制:通过交叉注意力层和自注意力层,将衣服的高层语义和低层特征融合到模型中,以此来控制图像的生成过程。

具体应用场景:

- 电子商务:用户可以在线上购物时,上传自己的照片并选择喜欢的衣服,系统会生成用户穿上所选衣服的图像,帮助用户做出购买决策。

- 时尚设计:设计师可以使用这种技术来预览服装设计在不同体型和姿势的人身上的效果,而无需制作实体样衣。

- 个性化推荐:电商平台可以根据用户的个人风格和历史偏好,推荐适合的服装,并展示个性化的试穿效果。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...