在手机上完成一连串操作——比如从微信复制一段文字,粘贴到备忘录,再分享给钉钉好友——对人类来说是日常小事。但对 AI 来说,这是一次复杂的多步决策挑战。

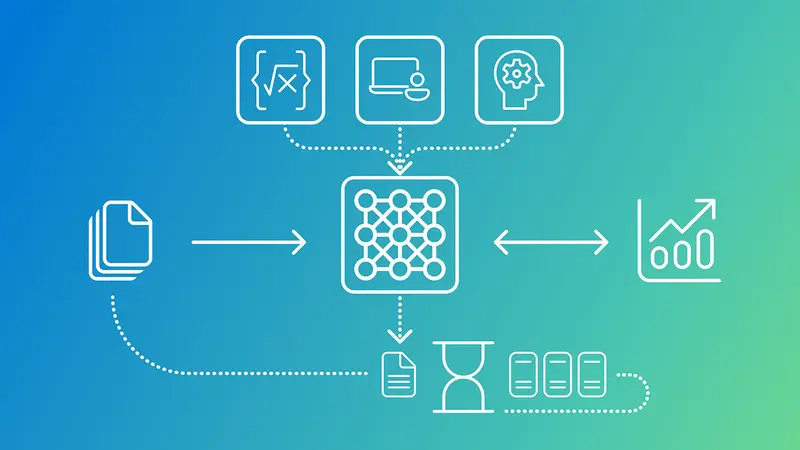

近年来,基于多模态大语言模型(MLLM)的 GUI 代理在自动化图形界面任务中展现出潜力。然而,它们普遍面临两个难题:

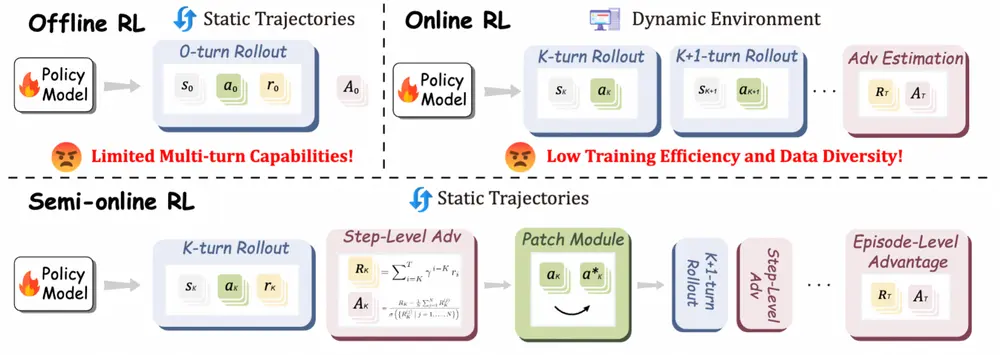

- 在线强化学习(Online RL)能持续优化策略,但训练成本高、不稳定;

- 离线强化学习(Offline RL)依赖历史数据,效率高但难以捕捉长期奖励,泛化能力受限。

为解决这一矛盾,浙江大学与阿里通义实验室联合提出一种新范式:半在线强化学习(Semi-online Reinforcement Learning),并在此基础上构建了全新的 GUI 自动化框架 —— UI-S1。

- GitHub:https://github.com/X-PLUG/MobileAgent/tree/main/UI-S1

- 模型:https://huggingface.co/mPLUG/UI-S1-7B

该方法不仅提升了训练效率,还在多个基准测试中达到开源 7B 模型中的 SOTA 表现。

什么是“半在线”?一种更贴近真实交互的训练方式

UI-S1 的核心思想是:用离线数据模拟在线过程。

它不直接与环境实时交互(像 Online RL 那样昂贵),也不完全静态回放轨迹(像传统 Offline RL 那样僵化)。相反,UI-S1 在每次训练回放时,保留模型自身的推理上下文和动作输出,同时引入专家轨迹作为参考,动态修正偏差。

这种方式既保留了离线训练的稳定性,又逼近了在线学习的反馈机制,从而更好地优化长期任务表现。

研究人员将这种新模式称为 Semi-online RL,并设计了一套完整的训练与评估体系。

关键技术亮点

✅ 1. Patch Module:让“走偏”的轨迹也能继续学

在真实任务中,模型可能在某一步做出与专家不同的选择,导致后续路径完全偏离。传统方法往往直接丢弃这类样本。

UI-S1 引入 Patch Module,当检测到动作分歧时,自动注入专家动作,并生成合理的“合成推理”内容来补全上下文。这样,即使模型中途犯错,训练仍可继续,显著提升数据利用率。

类比:就像老师发现学生解题走错方向,不是打叉了事,而是帮他回到正轨后继续讲解。

✅ 2. 双层优势优化:兼顾短期准确与长期成功

GUI 多步任务需要平衡两个目标:

- 短期每一步是否正确?

- 长期整条任务能否完成?

为此,UI-S1 设计了 双层优势函数(Dual-level Advantage),结合:

- 步级优势(Step-level):衡量单步决策质量;

- 剧集级优势(Episode-level):关注最终任务完成情况。

并通过引入 折扣未来回报(discounted future returns)增强对远期奖励的感知能力,使策略更倾向于选择能导向最终成功的动作序列。

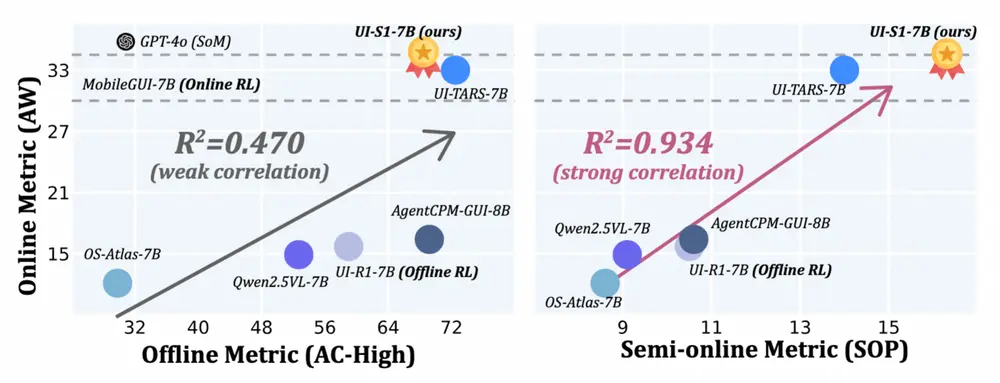

✅ 3. 新评估指标 SOP:更贴近真实性能

现有的离线评估方式常与真实在线表现脱节。为此,团队提出 Semi-Online Performance (SOP) 指标。

SOP 的评估方式更接近真实使用场景:

在模型生成的历史上下文中,逐步执行后续动作,观察其连续决策能力。实验表明,SOP 与真实在线性能高度相关,是一个更具指导意义的评估标准。

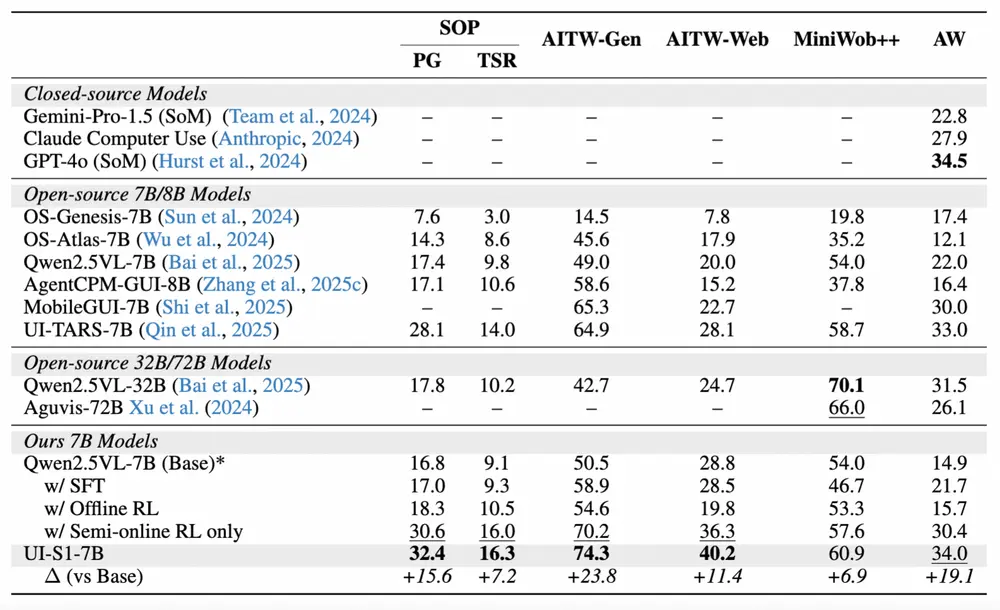

实验结果:全面领先

在多个主流 GUI 自动化基准上的测试显示,UI-S1-7B 实现了显著提升:

| 基准 | 提升幅度 |

|---|---|

| AndroidWorld(在线指标) | +12.0% |

| AITW-Gen(复杂多步任务) | +23.8% |

| AndroidControl-High(单步精度) | +15.5% |

| GUI Odyssey | +7.1% |

特别是在涉及跨应用信息传递、长程规划的任务中,UI-S1 明显优于基线模型和其他离线训练方法。

更重要的是,这些改进是在不增加额外在线交互成本的前提下实现的——完全依赖预收集轨迹完成训练。

应用场景广泛

UI-S1 不只是一个学术框架,它的设计理念适用于多种现实自动化需求:

- 移动设备自动化

自动完成 App 间跳转、信息搬运、设置调整等高频操作。 - Web 流程自动化

处理网页表单填写、数据抓取、多页导航等重复性任务。 - 桌面办公辅助

集成于办公软件中,协助文件整理、邮件回复、会议安排等。 - 游戏与应用测试

用于自动化功能测试、UI 覆盖检测,提高开发效率。

随着 MLLM 对视觉-语言-动作的联合理解不断深化,这类代理正从“能看会说”走向“能做会想”。

相关文章