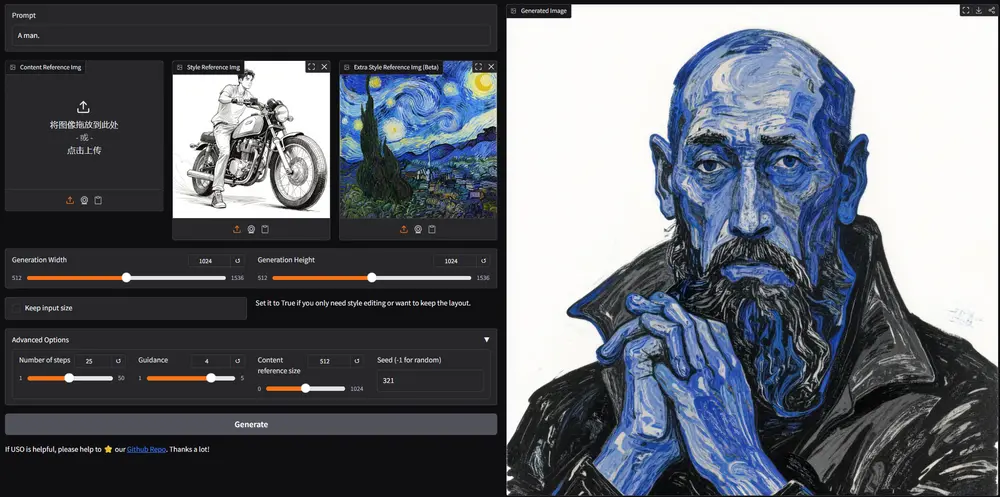

字节跳动智能创作实验室UXO项目组近期发布了UXO家族的新成员——USO(统一风格-主体优化定制模型)。这款模型打破了现有技术中“风格驱动”与“主体驱动”生成相互孤立的困境,能在单一框架下自由组合任意主体与风格,既保证生成图像的主体一致性(如人物身份不偏差),又确保风格高保真(如油画风不褪色),同时避免“塑料感”肖像问题。更重要的是,字节跳动将开源项目全流程资源,包括训练代码、推理脚本、模型权重及数据集,助力开源社区进一步探索图像生成技术。

- 项目主页:https://bytedance.github.io/USO

- GitHub:https://github.com/bytedance/USO

- 模型:https://huggingface.co/bytedance-research/USO

- Demo:https://huggingface.co/spaces/bytedance-research/USO

为什么需要USO?现有图像生成的核心痛点

在USO出现前,图像生成领域长期存在“风格与主体难以兼顾”的问题:

- 风格驱动模型:这类模型(如部分艺术风格迁移工具)优先保证风格相似性,但容易“牺牲主体”——比如将人物照片转化为梵高风格时,可能丢失人物面部特征,甚至出现肢体比例失真;

- 主体驱动模型:这类模型(如部分人像生成工具)专注保留主体一致性,但风格适配能力弱——比如想让同一人物分别呈现“水墨风”“赛博朋克风”,需要切换不同模型,且风格融合生硬;

- 任务孤立性:两种需求对应两套技术框架,开发者若需同时支持风格与主体定制,需单独适配接口、调试参数,开发成本高,生成效果也难以统一。

USO的设计初衷,正是通过“统一框架+特征解耦”,让“风格”与“主体”从“对抗关系”变为“协同关系”,实现“任意主体+任意风格”的自由组合。

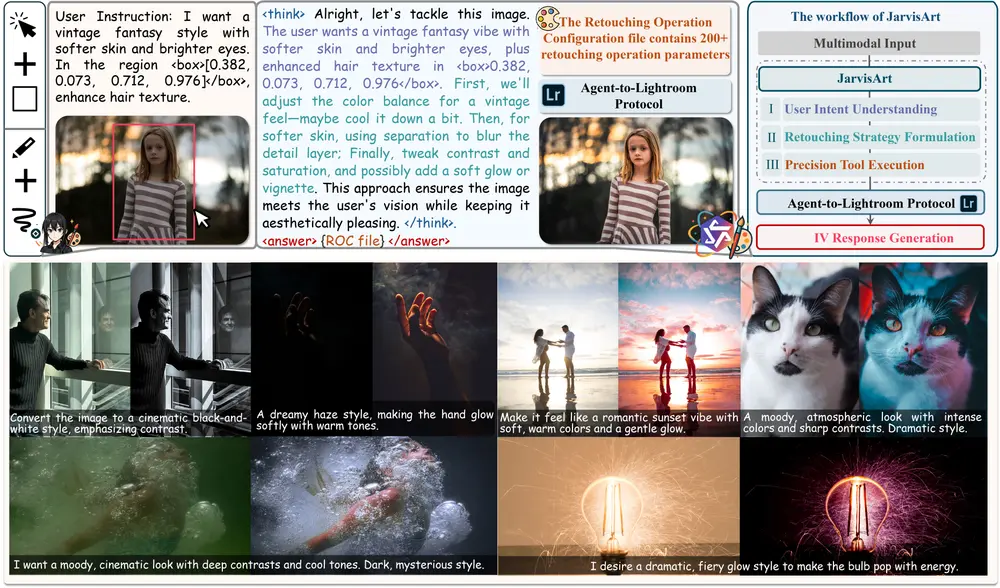

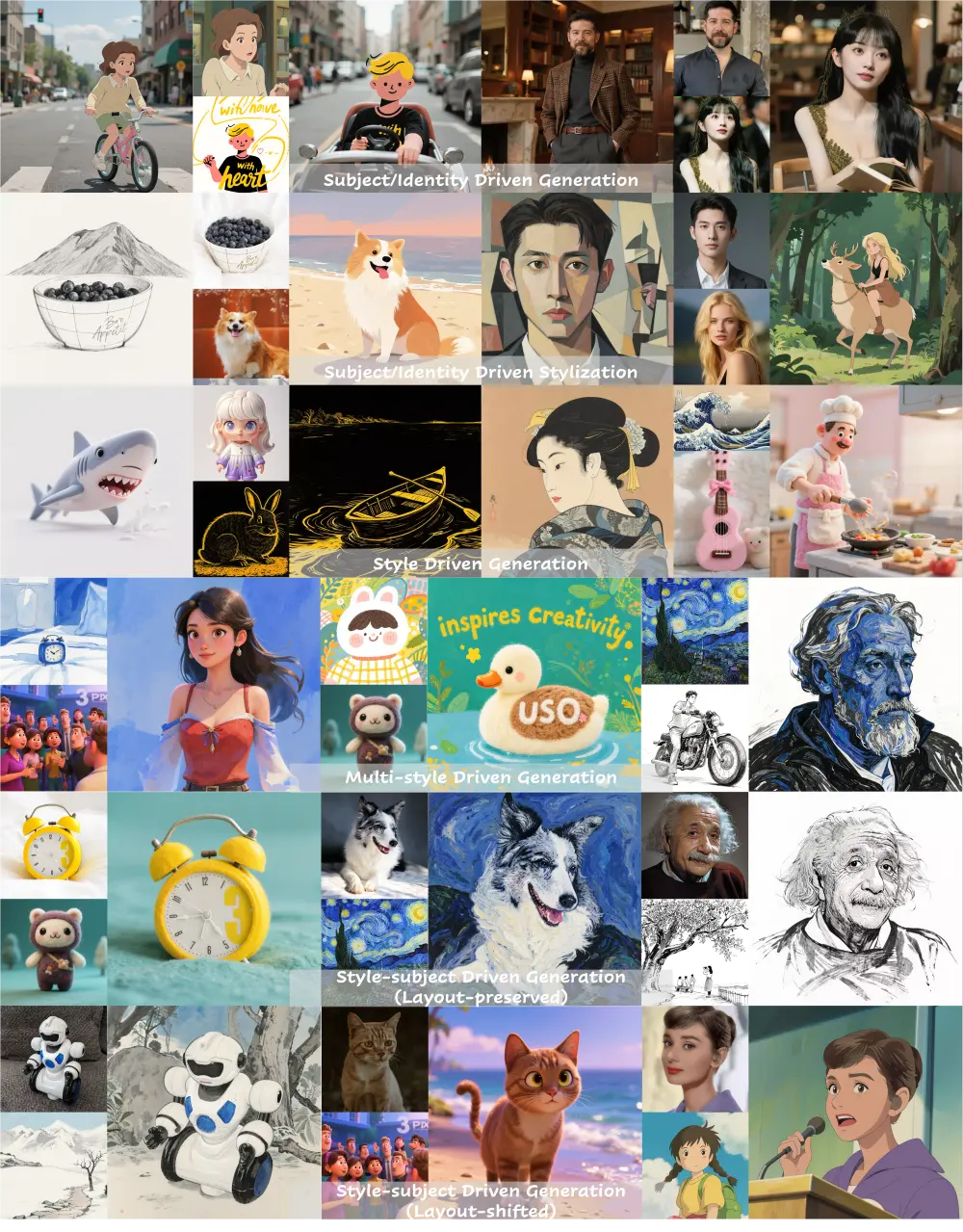

核心能力:三大生成模式,覆盖多场景创作需求

USO的核心价值在于“灵活应对不同生成需求”,无论是纯风格迁移、纯主体保留,还是两者结合的定制化生成,都能通过统一接口实现,覆盖图像编辑、艺术创作、视觉设计等高频场景:

1. 风格驱动生成:精准复刻风格,不丢细节

输入“内容图像+风格图像”,USO能将风格完整迁移到主体上,同时保留风格的细节特征:

- 例:将普通猫咪照片(内容图像)与莫奈《睡莲》(风格图像)输入模型,生成的图像既保留猫咪的毛发纹理、肢体姿态,又呈现《睡莲》的色彩晕染、笔触质感,不会出现“风格糊成一团”或“猫咪变样”的问题;

- 适用场景:艺术创作(将照片转化为特定画家风格)、品牌设计(给产品图赋予品牌VI风格)。

2. 主体驱动生成:锁定主体特征,适配多风格

输入“内容图像+风格文本提示”,USO能在保留主体一致性的前提下,按文本指令调整风格:

- 例:以同一人像(内容图像)为基础,分别输入“文本提示:中国传统工笔画风”“文本提示:未来科技感金属风”,生成的两张图像中,人物面部特征、发型、服装轮廓完全一致,仅风格按指令切换,且风格与主体融合自然,无明显“拼接感”;

- 适用场景:人像定制(如个人头像多风格生成)、IP衍生(如卡通角色不同场景风格适配)。

3. 联合风格-主体驱动生成:双需求一步满足

同时输入“内容图像+风格图像+文本提示”,USO能兼顾两者需求,实现更精细的定制:

- 例:输入“内容图像:商务会议场景”“风格图像:复古漫画风”“文本提示:突出会议桌中央的笔记本电脑”,生成的图像既符合复古漫画的线条、色彩风格,又完整保留会议场景的人物布局,且重点突出笔记本电脑,满足“风格+主体+重点强调”的复合需求;

- 适用场景:视觉内容创作(如为文章配图定制风格与主体)、广告设计(给场景图赋予风格并突出产品)。

技术创新:四大核心设计,支撑“风格-主体”统一

USO的性能突破,源于底层技术的四大关键设计,从数据集、训练流程到优化机制,全方位保障“风格与主体协同”:

1. 大规模三元组数据集:为模型提供“精准训练素材”

要让模型理解“内容-风格-风格化内容”的对应关系,高质量数据是基础。USO团队构建了包含“内容图像、风格图像、风格化内容图像”的三元组数据集:

- 数据覆盖广:包含人物、动物、场景、物品等多类主体,涵盖油画、水墨、漫画、3D渲染等数十种风格,确保模型对不同主体、风格的适配性;

- 标注精度高:每一组数据都经过人工校验,确保“风格化内容图像”既保留内容主体,又准确反映风格特征,避免低质量数据误导模型训练。

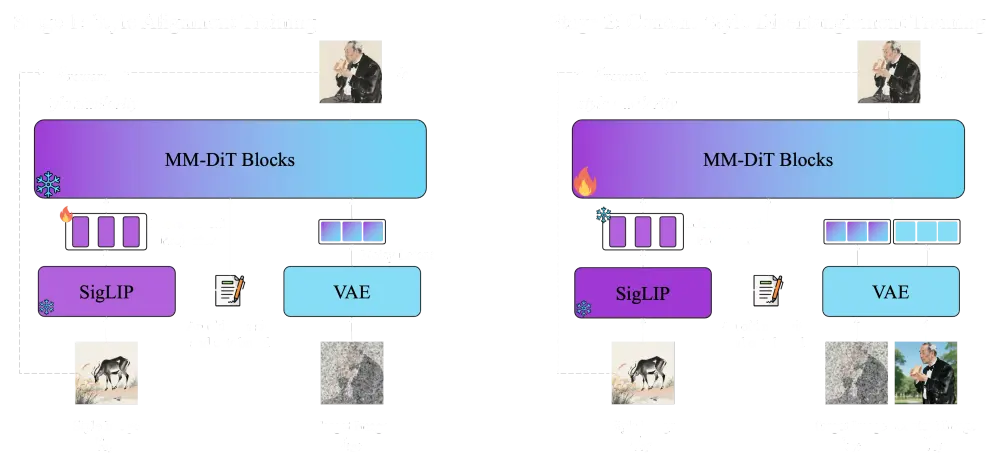

2. 两阶段训练流程:先“学风格”,再“解纠缠”

USO采用分阶段训练策略,让模型逐步掌握“风格对齐”与“内容-风格解耦”能力:

- 阶段1:风格对齐训练(SAT)

用SigLIP编码器(一种擅长图像-文本对齐的模型)处理风格图像,提取风格特征;再通过“层次化投影器”将风格特征与文本分布对齐(比如让“油画风”特征对应“oil painting”文本描述),让模型先学会“识别并复现风格”; - 阶段2:内容-风格解耦训练(DE)

在风格对齐基础上,引入内容图像的“条件编码器”——通过特殊训练机制,让模型将“内容特征”(如人物面部、物体轮廓)与“风格特征”(如色彩、笔触)分离存储、独立调用;后续生成时,可根据需求自由组合两者,避免特征混淆。

3. 风格奖励学习(SRL):用“奖励信号”优化生成质量

为进一步提升风格与主体的协同性,USO引入“风格奖励学习”机制:

- 训练过程中,模型生成图像后,系统会计算“生成图像与风格图像的风格相似性”“生成图像与内容图像的主体一致性”两个指标;

- 若指标达标(如风格相似性高于阈值、主体一致性无偏差),则给予模型“奖励信号”,鼓励该生成策略;若不达标(如风格走样、主体变形),则给予“惩罚信号”,引导模型调整参数;

- 通过持续的“奖励-惩罚”反馈,模型逐渐学会“在风格与主体间找平衡”,避免极端偏向某一方。

4. USO-Bench基准:首个“风格+主体”联合评估标准

此前缺乏评估“风格相似性+主体一致性”的统一基准,USO团队构建了USO-Bench——这是行业首个联合评估两项指标的基准测试集:

- 包含数百组“内容-风格-目标生成结果”的测试样本,覆盖多类主体与风格;

- 评估指标兼顾定量(如CLIP-I、DINO用于衡量主体一致性,CSD用于衡量风格相似性)与定性(人工打分),确保评估结果全面可靠;

- 该基准不仅用于验证USO性能,也为后续同类模型提供了“统一的比拼标准”,推动行业技术进步。

工作原理:四步实现“风格-主体”协同生成

USO的生成流程清晰,从输入到输出可分为四个核心步骤,全程在统一框架内完成:

- 输入接收:获取用户提供的“内容图像”(必选,需保留的主体)、“风格图像/风格文本提示”(可选,需迁移的风格);

- 特征提取:通过预训练的SigLIP编码器提取风格特征,通过条件编码器提取内容特征,两类特征在“解耦模块”中分离存储;

- 特征融合:根据用户需求(纯风格/纯主体/联合生成),模型调用对应的特征组合策略——比如联合生成时,按比例融合内容特征与风格特征,确保两者平衡;

- 图像生成与优化:生成初步图像后,风格奖励学习模块实时计算指标,若存在风格偏差或主体失真,自动微调特征权重,输出最终优化结果。

测试表现:多维度领先,用户认可度高

在USO-Bench、DreamBench等权威基准测试及用户研究中,USO的表现全面优于现有开源模型:

1. 定量指标:双维度均获最高分

- 主体一致性:在CLIP-I(衡量图像与文本主体匹配度)、DINO(衡量图像主体特征相似度)指标上,USO得分比同类开源模型高8%-12%,意味着生成图像的主体几乎无偏差;

- 风格相似性:在CSD(衡量风格特征相似度)指标上,USO得分比同类模型高10%-15%,比如迁移“文艺复兴风格”时,对光影、构图的还原度更高;

- 综合质量:在FID(衡量生成图像真实度)指标上,USO得分低于同类模型(FID越低越好),说明生成图像更自然,无“塑料感”。

2. 用户研究:四项维度均获最高评价

针对200名受试者(含设计师、普通用户)的偏好测试显示:

- 在“文本保真度”(生成结果与输入指令的匹配度)、“视觉吸引力”(图像美观度)、“主体一致性”“风格相似性”四项维度上,USO的用户偏好率均超过65%,其中“风格相似性”偏好率达78%,显著高于其他开源模型。

3. 定性评估:多场景生成效果稳定

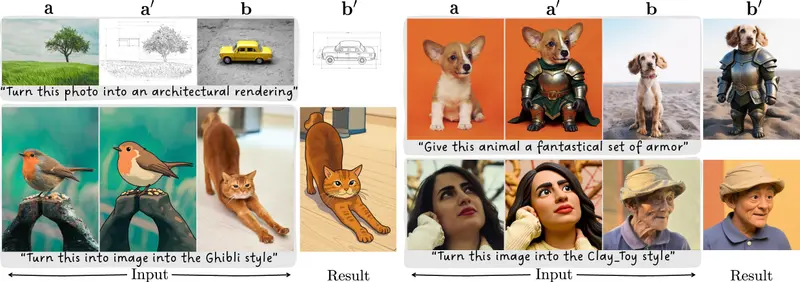

在不同场景测试中,USO表现出强适应性:

- 人物生成:将同一人物分别迁移为“古风”“科幻风”“水彩风”,面部特征、发型完全一致,风格过渡自然;

- 场景生成:将“城市街景”与“手绘风格”“像素风格”结合,既保留街道建筑布局,又呈现对应风格的细节;

- 物品生成:将“咖啡杯”与“木质纹理风”“金属工业风”结合,杯子形状不变,材质质感精准还原。

相关文章