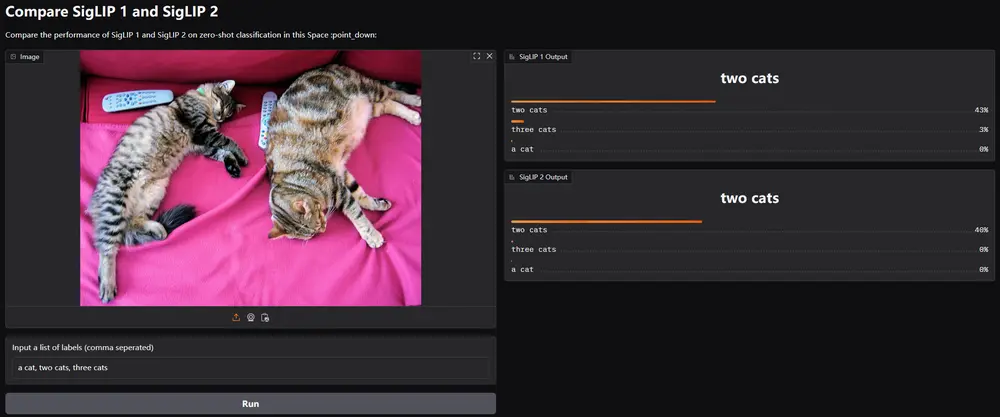

今天,谷歌正式发布了 SigLIP 2——一个全新的多语言视觉语言编码器系列。SigLIP 2 在语义理解、定位和密集特征方面进行了显著改进,进一步提升了视觉语言模型的性能。

- 官方说明:https://huggingface.co/blog/siglip2

- 模型:https://huggingface.co/collections/google/siglip2-67b5dcef38c175486e240107

- Demo:https://huggingface.co/spaces/google/zero-shot-sg1-sg2

SigLIP 2 的核心优势

SigLIP 2 在所有模型规模上均优于旧版 SigLIP,其核心能力包括零样本分类、图像-文本检索以及在提取视觉语言模型(VLM)的视觉表示时的迁移性能。此外,SigLIP 2 还引入了动态分辨率(naflex)变体,这对于对长宽比和分辨率敏感的下游任务非常有用。

背景:视觉编码器的演进

视觉编码器的作用是将图像转换为可用于下游任务(如分类、对象检测、图像分割等)的表示。研究人员一直在追求密集、具有局部感知能力和语义丰富的视觉表示。CLIP 和 ALIGN 是最早通过联合训练将图像编码器和文本编码器对齐的模型,而 SigLIP 则通过引入 sigmoid 损失取代 CLIP 的对比损失,进一步提升了编码器的性能。

SigLIP 2 在此基础上引入了一系列新的训练目标,使其成为更强大、更精细的视觉语言编码器。

SigLIP 2 的关键改进

1. 引入文本解码器以增强位置感知能力

在 SigLIP 2 中,研究人员添加了一个文本解码器,使其具备以下三个目标:

- 预测完整的图像标题;

- 预测给定描述特定图像区域的标题的边界框坐标;

- 预测给定边界框坐标的特定区域标题。

文本解码器为视觉编码器提供了额外的信号,使其具备更强的位置感知能力,这是 SigLIP 2 训练方案的第一个重要改进。

2. 全局-局部损失和掩码预测损失

为了进一步提升图像表示中的细粒度局部语义,SigLIP 2 引入了全局-局部损失和掩码预测损失。通过自蒸馏技术,使用同一个模型作为教师和学生:

- 全局-局部损失:学生网络接收训练图像的部分视图,并学习匹配教师网络从完整图像中提取的表示;

- 掩码预测损失:学生网络中 50% 的嵌入图像块被掩码标记掩盖,学生需要学习匹配教师在掩码位置的特征。

这些目标帮助视觉编码器增强空间感知能力,并提升其局部语义的准确性。

3. 动态分辨率支持

图像模型对不同的分辨率和长宽比非常敏感。SigLIP 2 提供了两种方法来解决这一问题:

- 固定分辨率变体:从 95% 训练完成的检查点开始,调整位置嵌入和 patch 嵌入的大小,然后继续针对请求的分辨率进行训练;

- 动态分辨率变体(naflex):受 FlexiViT 和 NaViT 的启发,naflex 变体可以处理不同分辨率和长宽比的输入,适用于 OCR 和文档理解等任务。

带有 -naflex 后缀的模型支持动态分辨率,而使用 naflex 变体需要通过 Siglip2Model 类实现。

SigLIP 2 的模型变体

SigLIP 2 提供了多种模型变体,适用于不同的应用场景:

siglip2-base-patch16-256siglip2-large-patch16-256siglip2-so400m-patch16-256siglip2-giant-opt-patch16-256

这些变体在性能和计算资源需求上各有不同,用户可以根据具体需求选择合适的模型。

SigLIP 2 与 SigLIP 的比较

与 SigLIP 相比,SigLIP 2 的主要改进包括:

- 引入了动态分辨率变体(naflex);

- 新增了 giant(1B 参数)系列模型。

| 特性 | SigLIP | SigLIP 2 |

|---|---|---|

| 动态分辨率支持 | 无 | 支持(naflex 变体) |

| 新增模型规模 | 无 | 添加 giant (1B) 系列 |

| 训练目标改进 | 对比损失 | sigmoid 损失 + 新增目标 |

| 下游任务适配 | 固定分辨率 | 固定分辨率 + 动态分辨率 |

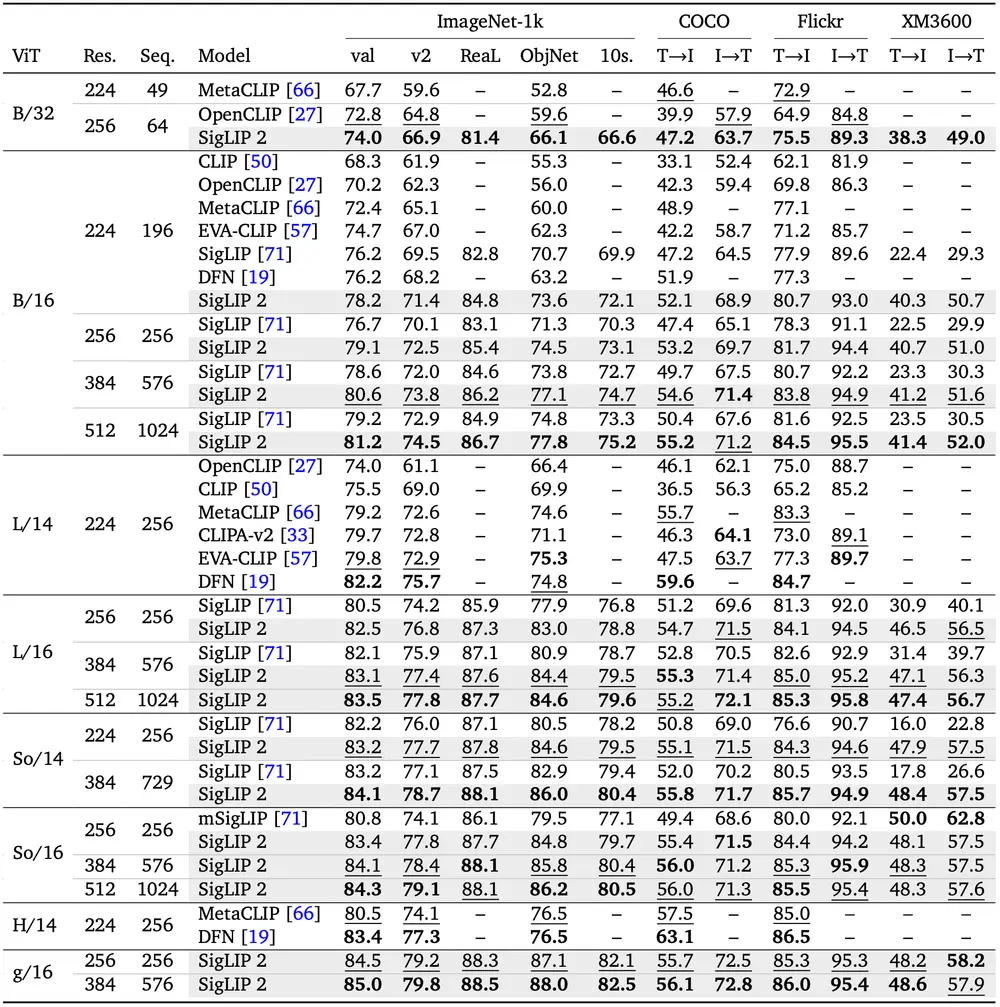

评估表显示,SigLIP 2 在多个任务上的表现优于 SigLIP。此外,你还可以通过提供的演示工具比较 SigLIP 1 和 SigLIP 2 的零样本分类结果。

应用于视觉语言模型(VLM)

视觉编码器在视觉语言模型(VLM)的开发中扮演着重要角色。通过将预训练的视觉编码器与预训练的语言模型结合,并使用多模态数据进行训练,可以构建强大的 VLM。

SigLIP 系列视觉编码器已被成功应用于多个 VLM,例如 PaliGemma。最近推出的 PaliGemma 2 将 SigLIP 与高级 Gemma 2 LLM 集成,进一步提升了性能。未来,将 SigLIP 2 集成到类似 PaliGemma 的环境中,有望带来更显著的性能提升。

相关文章