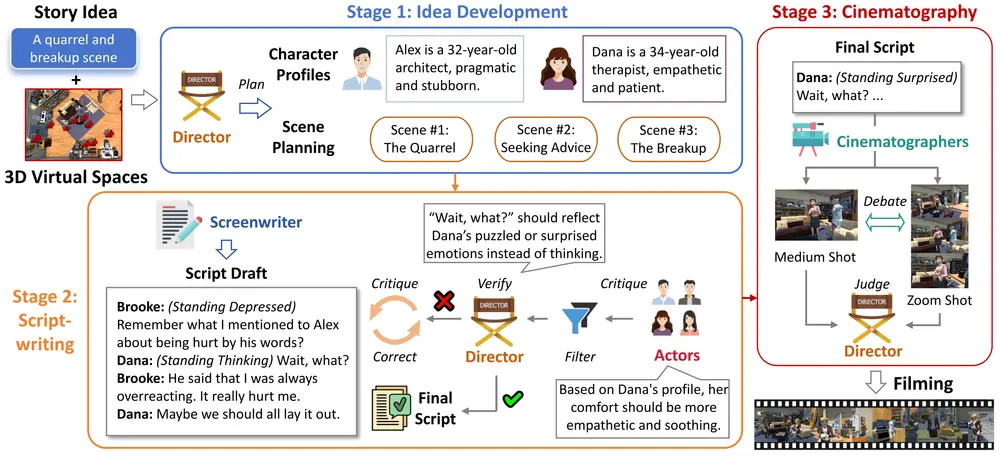

哈尔滨工业大学(深圳)和清华大学的研究人员推出多智能体协作框架 FILMAGENT,旨在通过大语言模型(LLMs)实现虚拟 3D 空间中的端到端电影自动化制作。该框架模拟了电影制作中的各种角色(如导演、编剧、演员和摄影师),并通过多智能体协作完成从创意构思到最终拍摄的整个电影制作流程。

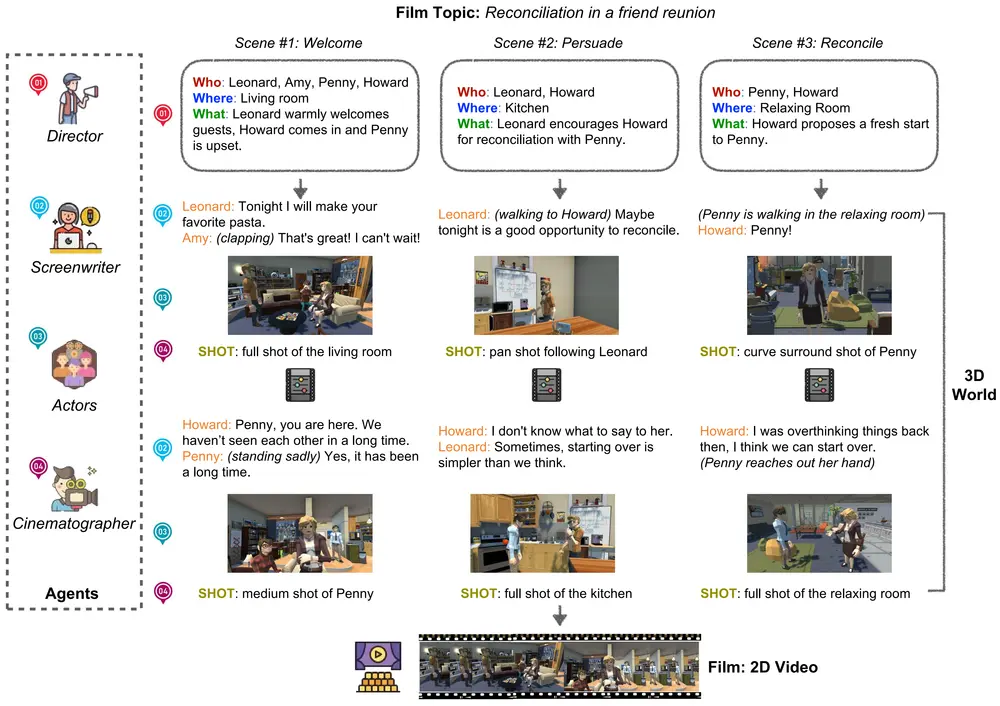

例如,我们有一个简短的故事创意:“一个朋友聚会中发生的争吵和和解”。在 FILMAGENT 框架中,导演智能体会首先根据这个创意生成角色档案,并扩展出详细的场景大纲,包括每个场景的地点、人物和事件。编剧智能体会根据大纲撰写对话和角色动作,演员智能体会根据角色档案调整对话,确保对话与角色性格一致。摄影师智能体会为每句对话选择合适的镜头设置,最终在预构建的 3D 虚拟空间中完成拍摄。

主要功能

- 创意构思:将简短的故事创意转化为详细的场景大纲。

- 剧本撰写:生成角色对话、定位和动作。

- 镜头设计:为每个镜头选择合适的相机设置。

- 多智能体协作:通过迭代反馈和修订,验证中间脚本,减少幻觉(hallucinations)。

- 虚拟拍摄:在预构建的 3D 虚拟空间中完成拍摄。

主要特点

- 多智能体协作:通过多智能体协作策略(如 Critique-Correct-Verify 和 Debate-Judge)显著提升脚本质量和镜头选择的合理性。

- 预构建的 3D 虚拟空间:提供 15 种不同的场景,支持多种角色位置和镜头设置。

- 角色档案和动作库:为角色生成详细的档案,并提供 21 种不同的动作,确保角色行为的多样性和一致性。

- 动态镜头选择:支持 9 种静态和动态镜头,包括平移镜头、追踪镜头和变焦镜头,以增强视觉效果。

- 语音生成:为每句对话生成同步的语音音频,使视频更加自然。

工作原理

创意构思阶段:

- 导演智能体根据输入的故事创意生成角色档案,并扩展出详细的场景大纲。

- 场景大纲包括每个场景的地点、人物和事件。

剧本撰写阶段:

- 编剧智能体撰写对话和角色动作,并为每个场景分配角色位置。

- 导演智能体和编剧智能体通过 Critique-Correct-Verify 循环进行反馈和修订,确保脚本的连贯性和一致性。

- 演员智能体根据角色档案提供反馈,进一步调整对话和动作。

镜头设计阶段:

- 摄影师智能体为每句对话选择合适的镜头设置。

- 两个摄影师智能体通过 Debate-Judge 方法进行辩论,最终由导演智能体决定最终的镜头设置。

虚拟拍摄阶段:

- 根据最终脚本在预构建的 3D 虚拟空间中进行拍摄,生成视频。

具体应用场景

- 电影制作:自动生成电影脚本和镜头设置,减少人工创作的时间和成本。

- 教育视频:快速生成教育视频,帮助学生更好地理解和学习复杂概念。

- 广告制作:快速生成广告脚本和镜头设置,提高广告制作效率。

- 游戏开发:为游戏生成过场动画和剧情视频,提升游戏的叙事体验。

- 虚拟现实和增强现实:在 VR/AR 应用中生成沉浸式的视频内容,增强用户体验。

优势和局限性

优势:

- 高效协作:通过多智能体协作显著提升脚本质量和镜头选择的合理性。

- 预构建环境:预构建的 3D 虚拟空间和角色动作库减少了创作的复杂性。

- 减少幻觉:通过迭代反馈和修订机制,减少生成内容中的幻觉现象。

局限性:

- 预构建环境的限制:依赖预构建的 3D 虚拟空间,缺乏灵活性。

- 动作和镜头设置的有限性:角色动作和镜头设置的选择有限,缺乏精细控制。

- 缺乏多模态输入:当前版本缺乏视觉输入,未来可以整合多模态 LLMs 以提高反馈和验证的准确性。

FILMAGENT 通过其创新的多智能体协作框架,为虚拟电影制作提供了一种高效、自动化的解决方案,展示了多智能体系统在创意领域的巨大潜力。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...