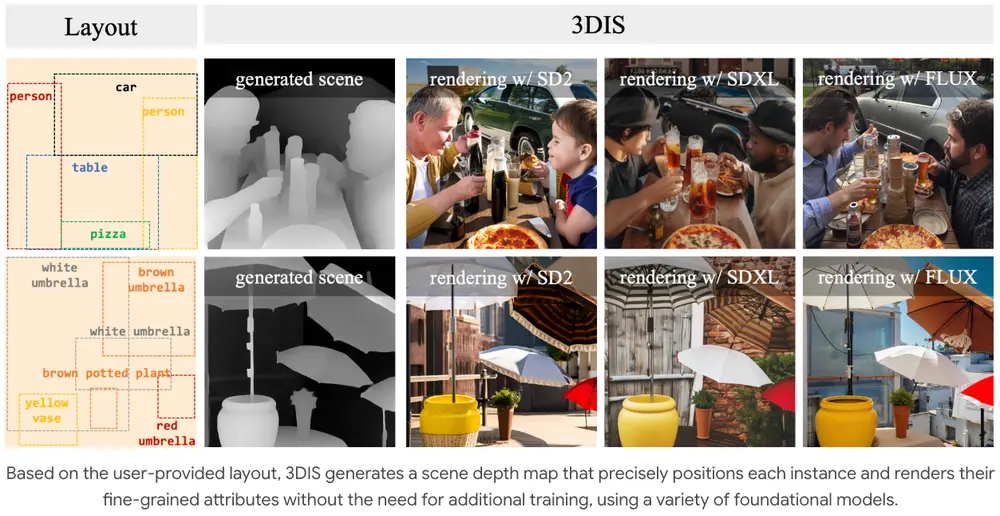

浙江大学和哈佛大学的研究人员推出多实例生成(Multi-Instance Generation)方法3DIS-FLUX,用于文本到图像生成。3DIS-FLUX是3DIS框架的扩展,利用最新的FLUX模型进行渲染,以实现更高质量的图像生成和更强的控制能力。3DIS-FLUX能够根据这些布局生成高质量的图像,确保每个对象的位置和属性与用户定义的规格精确对齐。

假设,用户想要生成一个包含“一只猫在草地上玩耍”和“一个红色的苹果在桌子上”的场景。用户首先定义一个布局,指定猫和苹果的位置。3DIS-FLUX首先生成一个场景深度图,其中猫和苹果的位置和深度信息被精确表示。然后,3DIS-FLUX使用FLUX.1-depth-dev模型根据深度图生成高质量的RGB图像,并通过细节渲染器确保猫和苹果的细粒度属性(如颜色、形状等)与用户定义的描述精确对齐。最终生成的图像将包含一只在草地上玩耍的猫和一个红色的苹果在桌子上,位置和属性与用户定义的布局和描述完全一致。

主要功能

- 多实例生成:3DIS-FLUX能够同时生成多个实例,并确保它们的位置和属性与用户定义的布局和描述精确对齐。

- 高质量图像渲染:利用FLUX模型的先进渲染能力,生成高质量、高分辨率的图像。

- 训练-free渲染:在渲染阶段不需要额外的训练,可以直接使用预训练的模型,节省资源和时间。

- 灵活的模型适配:3DIS-FLUX框架可以快速适应各种新的、更强大的基础模型,具有广泛的适用性。

主要特点

- 深度驱动的场景构建:3DIS-FLUX首先生成一个场景深度图,然后利用预训练的深度控制模型生成图像,确保生成的图像布局与用户定义的布局一致。

- 细节渲染:通过引入一个训练-free的细节渲染器,3DIS-FLUX能够在FLUX模型的联合注意力机制中精确渲染每个实例的细粒度属性。

- 高性能:实验结果表明,3DIS-FLUX在COCO-MIG基准测试中表现出色,显著优于之前的3DIS方法和其他现有的最先进的适配器基础方法。

- 兼容性:3DIS-FLUX可以与现有的适配器方法(如GLIGEN和MIGC)结合使用,进一步提升性能。

工作原理

1、场景深度图生成:

- 3DIS-FLUX使用布局到深度模型(layout-to-depth model)生成场景深度图,该模型根据用户提供的布局信息生成每个实例的深度位置。

- 例如,用户定义了一个包含“一个人”和“一辆车”的布局,布局到深度模型会生成一个深度图,其中“人”和“车”的位置和深度信息被精确表示。

2、细节渲染:

- 使用FLUX.1-depth-dev模型根据生成的场景深度图生成高质量的RGB图像。

- 通过引入一个训练-free的细节渲染器,3DIS-FLUX在FLUX模型的联合注意力机制中精确控制每个实例的细粒度属性。

具体来说,细节渲染器通过以下步骤实现:

- 图像嵌入的注意力控制:在早期步骤中,确保每个实例的图像嵌入只能关注其对应的文本嵌入和同一实例的其他图像嵌入,避免属性泄露。

- 文本嵌入的注意力控制:由于FLUX使用T5文本编码器(仅在文本数据上预训练),在联合注意力机制中对文本嵌入进行严格约束,避免错误的语义信息引入。

具体应用场景

- 内容创作:艺术家和设计师可以使用3DIS-FLUX生成复杂的场景,包含多个对象和详细的属性,用于创作艺术作品、设计概念图等。

- 虚拟现实和增强现实:在VR和AR应用中,3DIS-FLUX可以生成逼真的虚拟环境和对象,提供更沉浸式的用户体验。

- 游戏开发:游戏开发者可以利用3DIS-FLUX生成游戏中的场景和角色,提高游戏的视觉效果和 realism。

- 教育和培训:在教育和培训中,3DIS-FLUX可以生成具体的场景和对象,帮助学生更好地理解和记忆复杂的概念。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...