在图像到视频合成领域,基于拖动交互的方法因其直观性和易用性而受到广泛关注。然而,现有的2D拖动方法在处理物体的平面外运动时存在模糊性,难以精确控制物体在3D空间中的运动轨迹。为了解决这一问题,南京大学软件新技术国家重点实验室、蚂蚁集团、浙江大学和香港科技大学的研究人员提出了一种新的交互范式——LeviTor,通过引入深度维度,使用户能够在3D空间中精确控制物体的运动轨迹。

- 项目主页:https://ppetrichor.github.io/levitor.github.io

- GitHub:https://github.com/qiuyu96/LeviTor

- 模型:https://huggingface.co/hlwang06/LeviTor

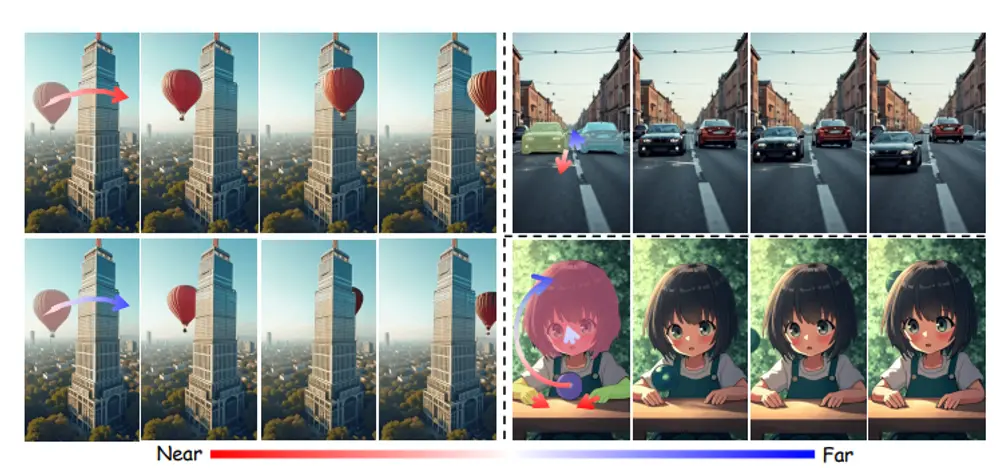

LeviTor专注于3D轨迹导向的图像到视频合成。LeviTor能够根据用户的输入生成具有受控遮挡、更好的深度变化和复杂的3D轨道运动的视频。例如,给定一个初始帧,用户可以使用LeviTor的推理管道轻松绘制3D轨迹,以表示他们对指定区域的期望运动。

LeviTor 的核心思想

LeviTor 的关键创新在于将对象掩码抽象为几个聚类点,并为这些点分配相对深度信息。具体来说,用户可以通过拖动这些聚类点来定义物体在3D空间中的运动路径,同时为每个点指定其深度值。这种做法不仅保留了2D拖动的便利性,还扩展了交互的维度,使得用户能够更自然地控制物体的三维运动。

主要功能:

- 3D轨迹控制: 用户可以通过在2D空间中绘制轨迹并指定相对深度,来控制视频中对象的运动轨迹。

- 照片真实感视频生成: 从静态图像生成具有真实感的视频。

- 用户友好的交互: 用户界面简化了3D轨迹的输入过程,使得非专业用户也能轻松创建视频内容。

主要特点:

- 深度信息融合: 通过结合深度信息和K-means聚类的点,LeviTor能够在不需要显式3D轨迹估计的情况下,捕获对象轨迹的基本3D属性。

- 创新的控制信号表示: 通过聚合或分离聚类点及其深度,清晰地指示对象之间的遮挡和深度变化。

- 高质量的训练数据集: 利用SAM2提供的高质量视频对象分割(VOS)数据集进行训练,有效捕获复杂场景中的对象运动和交互。

方法概述

- 对象掩码聚类:LeviTor 首先将输入图像中的目标对象进行分割,生成对象掩码。然后,通过对掩码进行聚类分析,提取出几个代表性的控制点。这些点可以理解为物体的关键部位或特征点,用户可以通过拖动这些点来定义物体的运动轨迹。

- 深度信息分配:为了支持3D轨迹控制,LeviTor 允许用户为每个控制点分配相对深度值。深度信息的引入使得用户可以在Z轴上控制物体的远近关系,从而实现对物体在3D空间中的精确操纵。

- 实例信息编码:除了深度信息,LeviTor 还考虑了物体的实例信息(如姿态、形状等),并将这些信息编码为控制信号。这有助于模型更好地理解物体的动态变化,生成更加逼真的运动效果。

- 视频扩散模型:LeviTor 将上述控制信号(包括聚类点的位置、深度信息和实例信息)作为输入,传递给一个基于扩散模型的视频生成网络。该网络能够根据用户的交互指令,逐步生成符合预期的视频帧,最终合成一段连贯且逼真的视频。

实验验证

研究人员通过大量实验验证了LeviTor的有效性。实验结果表明,LeviTor 能够在从静态图像生成视频的过程中,精确控制物体的运动轨迹,尤其是在处理复杂的3D运动时表现出色。相比传统的2D拖动方法,LeviTor 不仅提高了物体运动的可控性,还显著提升了生成视频的质量和真实性。

应用前景

LeviTor 的提出为图像到视频合成领域带来了新的可能性,特别是在需要精确控制物体运动的应用场景中具有广泛的应用潜力。例如:

- 虚拟现实与增强现实:用户可以通过简单的拖动操作,在虚拟环境中实时控制物体的运动,增强交互体验。

- 影视制作:导演和动画师可以利用LeviTor 快速生成符合创意需求的动态场景,减少传统动画制作中的复杂流程。

- 游戏开发:开发者可以使用LeviTor 为游戏角色或物体设计更加自然的运动轨迹,提升游戏的真实感和沉浸感。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...