现有的文本到图像(T2I)扩散模型虽然在生成高质量图像方面表现出色,但面临着几个关键挑战:

- 模型尺寸大:许多先进的T2I模型包含数十亿个参数,导致存储和部署成本高昂。

- 运行时间慢:生成高分辨率图像通常需要较长的时间,尤其是在移动设备上。

- 移动设备上的生成质量低:由于计算资源有限,移动设备上的生成质量往往不如桌面或云端环境。

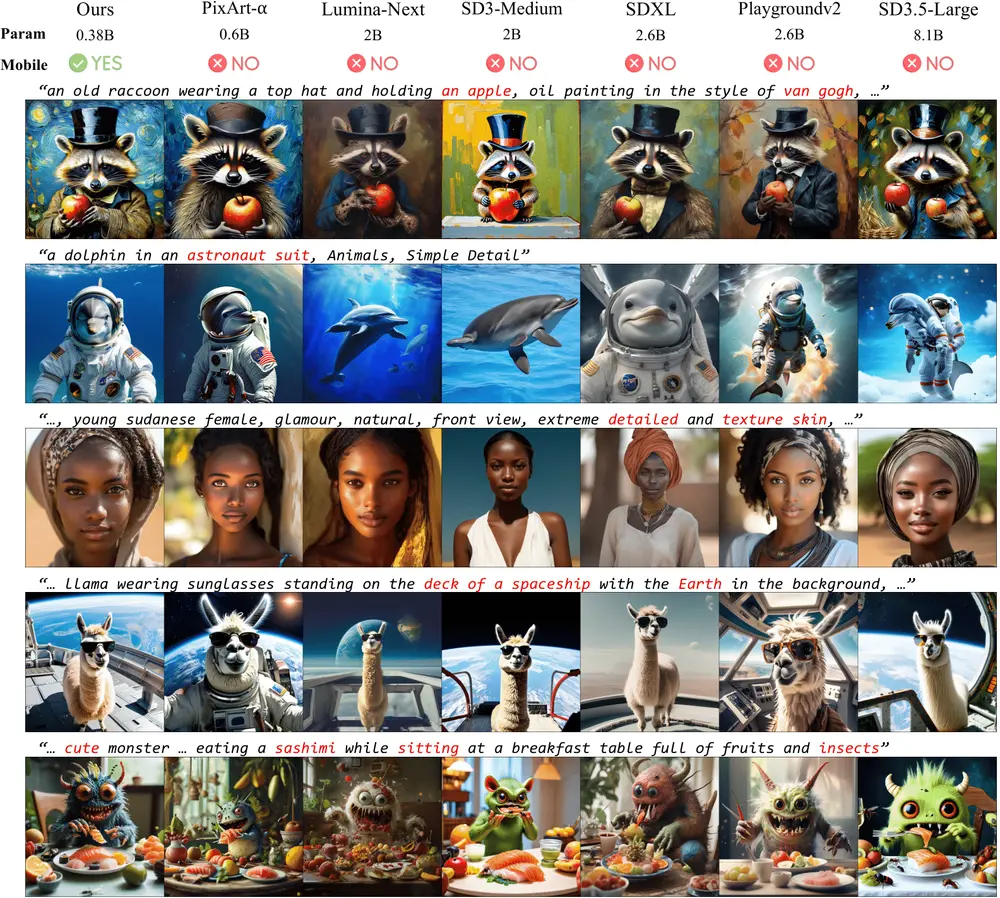

为了解决这些挑战,Snap、香港科技大学、墨尔本大学和MBZUAI的研究人员提出了SnapGen,这是一个极小且快速的文生图模型,能够在移动平台上生成高分辨率和高品质的图像。SnapGen通过一系列技术创新,实现了在保持图像质量的同时显著减少模型大小和计算需求,使其能够在移动设备上快速运行。

例如,用户想要在智能手机上生成一张“穿着宇航员服的海豚”的图像。用户只需在SnapGen应用中输入这个文本提示,模型就会在大约1.4秒内生成一张高分辨率的图像,显示一只海豚穿着宇航服,图像质量与大型模型相当,但生成速度更快,且完全在用户的移动设备上完成。这种能力使得SnapGen非常适合需要快速、高质量图像生成的移动应用场景。

SnapGen的核心创新

1. 系统化检查网络架构设计选择

为了减少模型参数和延迟,同时确保高质量的生成,研究人员系统地检查了网络架构的设计选择。具体来说:

- 轻量化架构:通过引入更高效的卷积层、自注意力机制和其他组件,研究人员设计了一个轻量级的网络架构,减少了模型的参数数量和计算复杂度。

- 模块化设计:将模型分解为多个模块,每个模块负责特定的任务(如文本编码、图像生成等),使得模型更加灵活和可扩展。

- 多尺度处理:采用多尺度处理技术,允许模型在不同分辨率下逐步生成图像,从而提高了生成质量和效率。

2. 跨架构知识蒸馏

为了进一步提高生成质量,研究人员采用了跨架构知识蒸馏技术。具体来说:

- 从大模型中提取知识:通过使用一个更大的预训练模型作为教师模型,研究人员将大模型的知识传递给SnapGen这个较小的学生模型。这种跨架构的知识蒸馏不仅提高了生成质量,还加速了训练过程。

- 多层次指导:蒸馏过程中,研究人员采用了多层次的方法,从头开始指导学生模型的训练。这包括特征层面、中间表示层面和最终输出层面的指导,确保学生模型能够学习到教师模型的关键特征和生成策略。

3. 对抗性指导与知识蒸馏结合

为了实现更快的生成速度,研究人员引入了对抗性指导,并将其与知识蒸馏相结合。具体来说:

- 几步生成:通过对抗性指导,研究人员实现了几步生成的过程,即在每次迭代中生成一小部分图像,并通过对抗性损失进行优化。这种方法显著减少了生成所需的步骤数,从而加快了生成速度。

- 对抗性损失:对抗性损失帮助模型生成更加逼真的图像,同时保持与输入文本的一致性。通过结合知识蒸馏和对抗性指导,研究人员成功地在保证生成质量的前提下,大幅缩短了生成时间。

主要特点

- 小模型尺寸:SnapGen的模型参数仅为379M,远小于其他大规模模型。

- 跨架构知识蒸馏:从更大的模型中转移知识,提高小模型的生成质量。

- 对抗性步骤蒸馏:通过减少扩散步骤来加速图像生成,同时保持图像质量。

- 多级知识蒸馏:结合输出蒸馏和特征蒸馏,提高模型在不同时间步的预测难度。

工作原理

SnapGen的工作原理包括以下几个关键步骤:

- 网络架构优化:通过系统地检查网络架构设计,减少模型参数和延迟,同时确保高质量的图像生成。

- 改进训练技术:使用流匹配作为目标,与大型模型如SD3和SD3.5对齐,实现有效的知识和步骤蒸馏。

- 高级步骤蒸馏:结合对抗性训练和知识蒸馏,使用几步教师模型(如SD3.5-Large-Turbo),实现快速高质量的图像生成。

实验结果

1. 移动设备上的高效生成

SnapGen首次在移动设备上以约1.4秒的时间生成了1024×1024像素的图像。这一结果展示了SnapGen在移动平台上的高效性和实用性。

2. ImageNet-1K 上的表现

在ImageNet-1K数据集上,SnapGen仅有372M参数,实现了256×256像素生成的FID(Fréchet Inception Distance)为2.06。这一结果表明,尽管模型参数较少,SnapGen仍然能够生成高质量的图像。

3. T2I基准测试中的表现

在T2I基准测试(如GenEval和DPG-Bench)中,SnapGen仅有379M参数,显著小于具有数十亿参数的大规模模型(例如,比SDXL小7倍,比IF-XL小14倍)。尽管模型参数大幅减少,SnapGen在生成质量和效率方面仍然表现出色。

相关文章