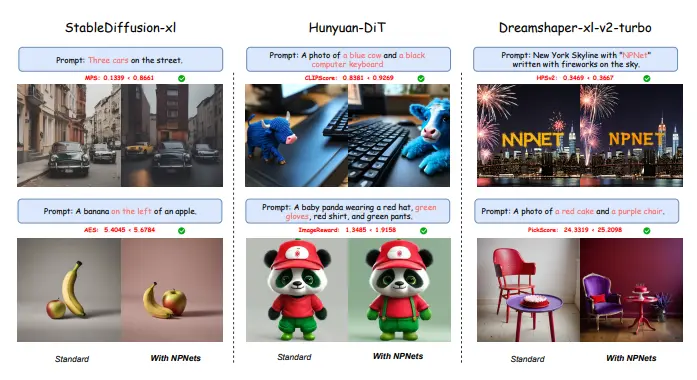

香港科技大学(广州)、穆罕默德·本·扎耶德人工智能大学和香港浸会大学的研究人员推出一种名为“Golden Noise for Diffusion Models”的学习框架,旨在提高文生图模型的性能。这种模型能够根据文本提示生成个性化的图像。研究团队提出了一种新的概念——“噪声提示”(noise prompt),通过这个概念,研究者们能够将随机的高斯噪声转换成能够生成更高质量、与文本提示更匹配的图像的“黄金噪声”(golden noise)。

- GitHub:https://github.com/xie-lab-ml/Golden-Noise-for-Diffusion-Models

- ComfyUI插件:https://github.com/DataCTE/ComfyUI_Golden-Noise

例如,给定一个文本提示“三辆车在街上”,使用传统的扩散模型可能会生成与文本提示匹配度不高的图像。而通过使用“噪声提示”技术,模型能够生成与文本提示更加吻合、质量更高的图像。

主要功能:

- 将随机高斯噪声转换成黄金噪声,以提高图像合成的质量和语义忠实度。

- 作为一个即插即用的模块,与现有的扩散模型兼容,无需修改原始模型的架构。

主要特点:

- 噪声提示学习框架(Noise Prompt Learning Framework): 系统地学习与文本提示相关的黄金噪声。

- 噪声提示数据集(Noise Prompt Dataset, NPD): 包含大量随机噪声和黄金噪声对的数据集,用于训练噪声提示网络(NPNet)。

- NPNet(Noise Prompt Network): 一个小型的神经网络,能够学习如何将随机噪声转换为黄金噪声。

- 高效性: NPNet作为一个小型且高效的控制器,引入的额外推理和计算成本非常有限。

工作原理:

- 数据收集: 通过重去噪采样(re-denoise sampling)方法生成噪声对,并使用人类偏好模型(如HPSv2)来筛选有价值的噪声对。

- 模型训练: 使用收集到的噪声提示数据集训练NPNet,使其能够学习如何从源噪声和文本提示中生成目标噪声。

- 模型推理: 将训练好的NPNet应用于文本到图像扩散模型,将随机高斯噪声转换为黄金噪声,从而提高图像合成的质量。

具体应用场景:

- 图像合成: 根据文本提示生成高质量的图像,适用于艺术创作、游戏设计、虚拟现实等领域。

- 内容创作: 辅助内容创作者快速生成与文本描述相匹配的视觉内容。

- 广告和营销: 根据产品描述生成吸引人的广告图像。

- 社交媒体: 用户可以根据自己的想法生成个性化的图像内容。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...