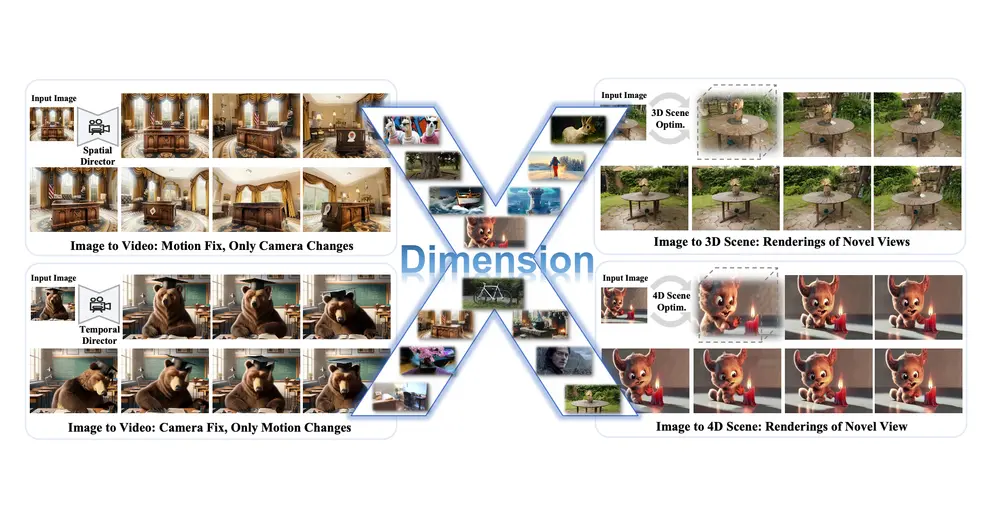

香港科技大学、清华大学和生数科技的研究人员推出一个名为DimensionX的框架,它能够从单张图片生成高逼真度的3D和4D场景,并且通过视频扩散技术(video diffusion)实现对空间和时间维度的可控生成。该方法的核心思想是利用视频帧序列来有效表示3D场景的空间结构和4D场景的时间演化。

例如,给定一张静态图片,DimensionX可以生成一段视频,其中不仅相机视角可以变化(空间维度控制),还可以展现动态变化的场景(时间维度控制)。这意味着,用户可以通过这个框架,从单一图像创造出一个既具有空间变化(如相机移动)又具有时间变化(如物体运动)的四维动态环境。

主要功能

- 3D场景优化:从单张图片生成新的视角渲染图,构建3D场景。

- 4D场景优化:从单张图片生成包含时间和空间变化的动态场景,即4D场景。

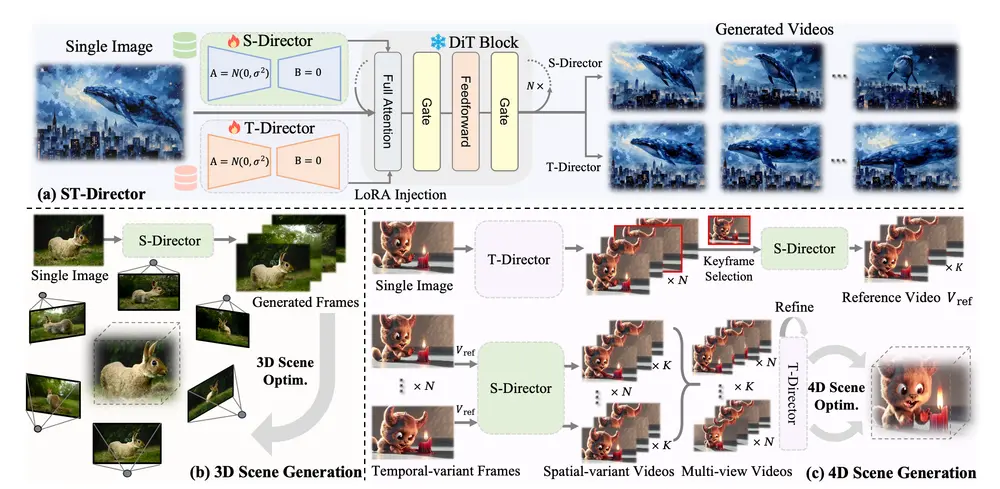

- 视频扩散控制:通过ST-Director(空间和时间导演),实现对视频扩散过程中空间和时间因素的解耦和精确控制。

主要特点

- 空间和时间的解耦:通过ST-Director技术,将空间和时间的变化分离,允许独立或组合控制。

- 无需训练的维度感知组合:基于视频扩散去噪过程的本质,开发了一种无需训练的方法来实现混合维度控制。

- 轨迹感知机制:为3D生成设计了轨迹感知机制,以处理复杂的现实世界场景。

- 身份保持去噪策略:为4D生成设计了一种保持身份的去噪策略,以增强场景的一致性。

工作原理

DimensionX的工作原理涉及以下几个关键步骤:

- 构建维度变化数据集:收集空间和时间变化的视频数据集,用于训练ST-Director。

- ST-Director:通过学习维度感知的LoRAs(低秩适应),在视频扩散模型中解耦空间和时间参数。

- 维度感知去噪:分析视频扩散过程中的去噪机制,实现空间和时间信息的早期和晚期控制。

- 3D和4D场景生成:利用ST-Director生成的视频帧序列,重建3D外观和4D动态运动。

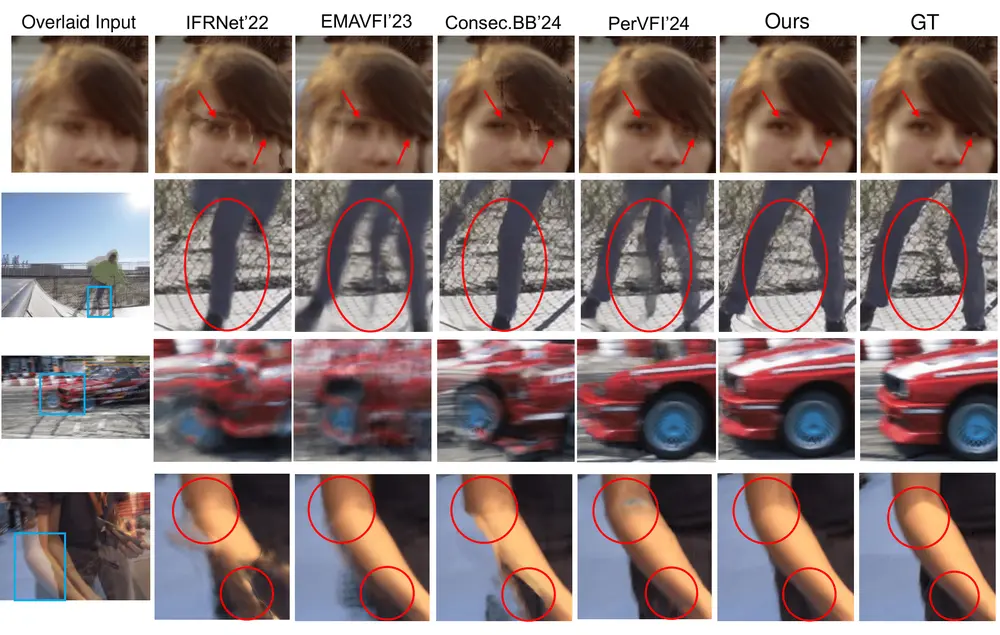

实验结果

DimensionX在各种现实世界和合成数据集上进行了广泛的实验,结果显示其在可控视频生成以及3D和4D场景生成方面取得了优越的结果。与之前的方法相比,DimensionX能够生成更加逼真和精细的3D和4D场景,具有以下优势:

- 空间结构的精确控制:能够生成具有复杂空间结构的3D场景。

- 时间动态的精确控制:能够生成具有逼真时间演化的4D场景。

- 现实世界场景的生成:在现实世界数据集上的表现优于现有方法。

应用前景

DimensionX的提出为从单张图像生成逼真的3D和4D场景提供了新的解决方案,具有广泛的应用前景:

- 虚拟现实和增强现实:生成逼真的3D和4D场景,提升虚拟现实和增强现实的沉浸感。

- 电影和动画制作:生成高质量的3D和4D动画,提高制作效率和效果。

- 自动驾驶和机器人:生成逼真的3D环境,用于自动驾驶和机器人的训练和测试。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...