滑铁卢大学与加拿大国家研究院的研究团队提出了一项极具前瞻性的项目:NeuralOS —— 一个通过神经生成模型模拟操作系统图形用户界面(GUI)的框架。

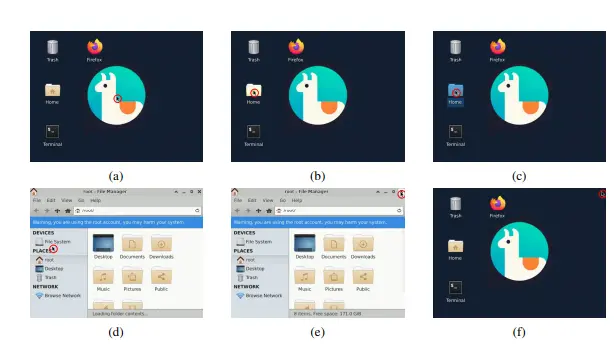

它不依赖传统编程逻辑,而是直接从用户输入(如鼠标点击、键盘操作)预测屏幕图像帧,尝试用深度学习“模拟”操作系统的行为。

NeuralOS 的目标不是替代操作系统,而是探索一种完全生成式、自适应人机交互界面的可能性。

NeuralOS 是什么?

NeuralOS 是一种基于神经生成模型的框架,能够:

- 从用户输入预测屏幕图像帧

- 模拟操作系统状态(如窗口打开、应用启动)

- 实时渲染逼真的 GUI 界面

它使用了:

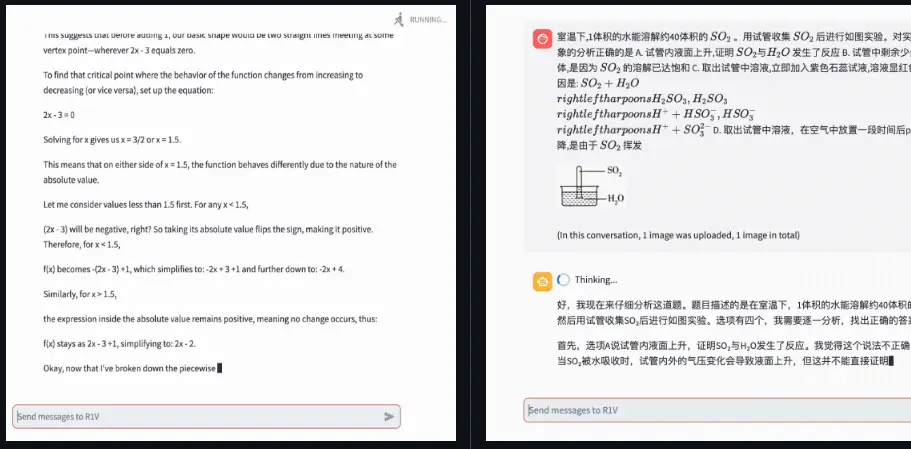

- 循环神经网络(RNN):用于跟踪系统状态(如当前运行的程序、光标位置)

- 扩散模型渲染器:将状态信息转换为视觉图像

训练数据来自一个大规模的 Ubuntu XFCE 桌面录制数据集,包含 AI 代理生成的真实交互与随机探索行为。

核心功能一览

| 功能 | 说明 |

|---|---|

| ✅ 实时 GUI 模拟 | 根据鼠标移动、点击等输入,生成屏幕图像 |

| ✅ 状态跟踪 | 使用 RNN 跟踪系统状态,如打开的程序、隐藏窗口 |

| ✅ 光标精确定位 | 通过空间编码,精确预测光标位置(误差仅 1.6x/1.4y 像素) |

| ✅ 状态转换建模 | 可预测应用程序启动、窗口切换等复杂交互 |

| ✅ 自适应交互 | 支持自然语言或手势输入,而非仅菜单式操作 |

技术亮点解析

1. 神经渲染器 + 扩散模型

不同于传统图像生成模型,NeuralOS 的渲染器基于扩散模型,能生成高质量、逼真的 GUI 图像帧,包括窗口、图标、菜单等元素。

2. 层次化 RNN 架构

为了处理长时间序列交互,NeuralOS 使用两层 RNN 架构:

- 低层 RNN:处理短期交互(如点击按钮)

- 高层 RNN:跟踪长期状态(如程序运行状态)

这种结构使得模型在保持计算效率的同时,能处理长时间依赖。

3. 多阶段训练策略

为提高模型稳定性与泛化能力,研究团队采用了多阶段训练方法:

- RNN 预训练:使用 MSE 损失训练 RNN 预测屏幕帧

- 联合训练:将 RNN 与扩散模型联合优化

- 计划采样:提升模型对输入噪声的鲁棒性

- 上下文扩展:增强模型对长期交互的建模能力

4. 显式光标编码

通过高斯空间图显式编码光标位置,使得模型在预测光标移动时具有极高精度,平均误差仅为 1.6 像素(x 轴)和 1.4 像素(y 轴),远超未使用该机制的模型(130/95 像素)。

数据来源:真实与随机交互结合

训练数据包括:

- AI 代理生成的真实交互:模拟用户操作,生成多样化行为

- 随机探索数据:通过随机鼠标移动、点击和键盘输入扩充数据集,增强模型泛化能力

这种组合策略有效避免了模型过拟合特定操作路径。

测试结果亮点

| 测试项 | 结果 |

|---|---|

| 光标定位误差 | 1.6 像素(x) / 1.4 像素(y) |

| 应用启动预测准确率 | 37.7%(远超随机投票 1.4%) |

| 模型鲁棒性 | 使用计划采样后图像质量稳定,未出现明显退化 |

应用场景展望

NeuralOS 提供了一个全新的交互界面建模思路,适用于以下方向:

| 场景 | 描述 |

|---|---|

| 🖥️ 虚拟操作系统 | 构建无需传统代码的生成式桌面系统 |

| 🎥 交互式媒体 | 将电影、广告等被动内容转为可交互体验 |

| 🎮 游戏开发 | 生成动态 GUI 与实时交互界面 |

| 📚 教育培训 | 提供沉浸式 GUI 操作模拟环境 |

| 🤖 辅助技术 | 为残障人士提供语音、手势控制的交互方式 |

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...