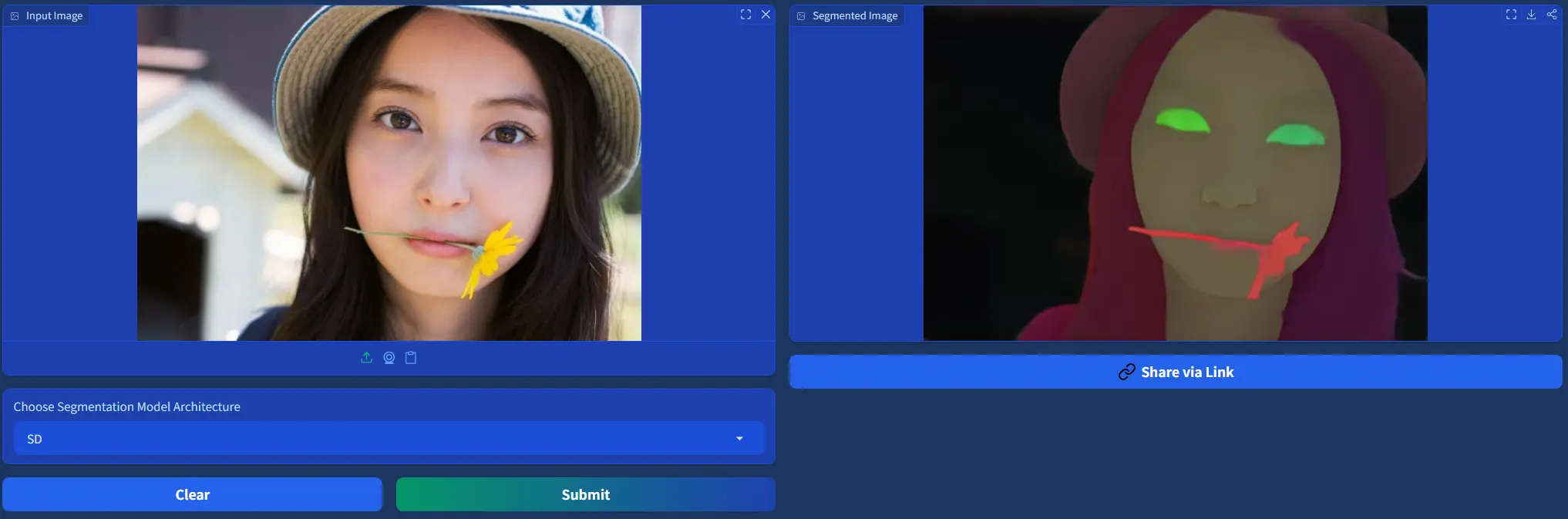

加州大学戴维斯分校的研究人员推出GEN2SEG,将生成模型(如Stable Diffusion和MAE)应用于实例分割任务,特别是对于那些在预训练和微调阶段未见过的物体类型和风格。通过微调这些生成模型,研究者们发现模型能够展现出强大的零样本泛化能力,准确地分割出在微调阶段未见过的物体类型和风格。

- 项目主页:https://reachomk.github.io/gen2seg

- GitHub:https://github.com/UCDvision/gen2seg

- Demo:https://huggingface.co/spaces/reachomk/gen2seg

例如,模型在微调时仅使用了包含室内家具和汽车的标注掩码的合成数据集,但经过微调后,模型能够准确地分割出如人类、动物等在微调阶段未见过的物体类型,甚至包括一些在预训练阶段也未见过的风格,如印象派艺术作品、行李X光图像等。

主要功能

- 实例分割:将图像中的每个像素分配给特定的物体实例,生成每个物体的掩码。

- 零样本泛化:模型能够在没有见过的物体类型和风格上进行准确的分割,展现出强大的泛化能力。

- 提示式分割:通过单个或多个提示点,生成与提示点对应的物体掩码。

主要特点

- 强大的泛化能力:即使在微调阶段未见过的物体类型和风格上,模型也能准确地进行分割。

- 生成模型的利用:利用生成模型的预训练表示,无需大规模标注数据即可实现有效的实例分割。

- 高效的微调:通过设计特定的损失函数(如实例着色损失),在少量数据上进行微调即可获得良好的性能。

工作原理

- 预训练阶段:使用生成模型(如Stable Diffusion或MAE)从噪声输入合成连贯的图像,学习物体边界和场景组成。

- 微调阶段:在微调阶段,研究者们设计了一个实例着色损失函数,鼓励属于同一物体实例的像素共享相似的颜色,而不同实例的像素则使用不同的颜色。通过在包含室内家具和汽车标注掩码的合成数据集上进行微调,模型学习如何将像素分组为不同的物体实例。

- 提示式分割:通过计算提示点周围的像素权重,生成查询向量,并计算查询特征相似度图,最终通过阈值化生成二值掩码。

测试结果

- 零样本泛化:在多个未见过的物体类型和风格的数据集上,模型展现出强大的零样本泛化能力。例如,在iShape数据集上,模型的性能超过了SAM,表明其在分割复杂和精细结构方面具有优势。

- 提示式分割:在单个提示点的情况下,模型的性能接近或超过SAM,即使在多提示点的情况下,模型也能恢复超过82%的SAM性能。

- 边缘检测:在BSDS500数据集上进行零样本边缘检测时,模型的性能在低召回率时超过了SAM,表明其在分割精确边界方面具有优势。

应用场景

- 自动驾驶:准确分割道路上的车辆、行人等物体,提高自动驾驶系统的安全性。

- 医疗影像:在医学图像中分割出病变区域,辅助医生进行诊断。

- 机器人视觉:帮助机器人理解环境中的物体,进行有效的交互和操作。

- 艺术和设计:在艺术作品中分割出不同的元素,为艺术创作和设计提供支持。

- 安防监控:在监控视频中实时分割出异常物体或行为,提高安防系统的效率。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...