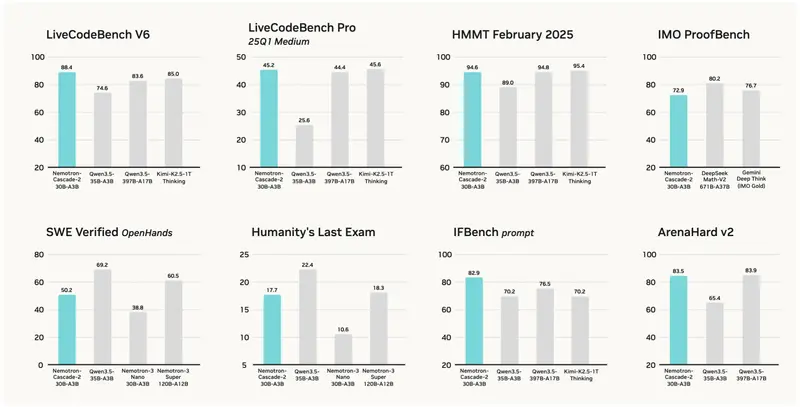

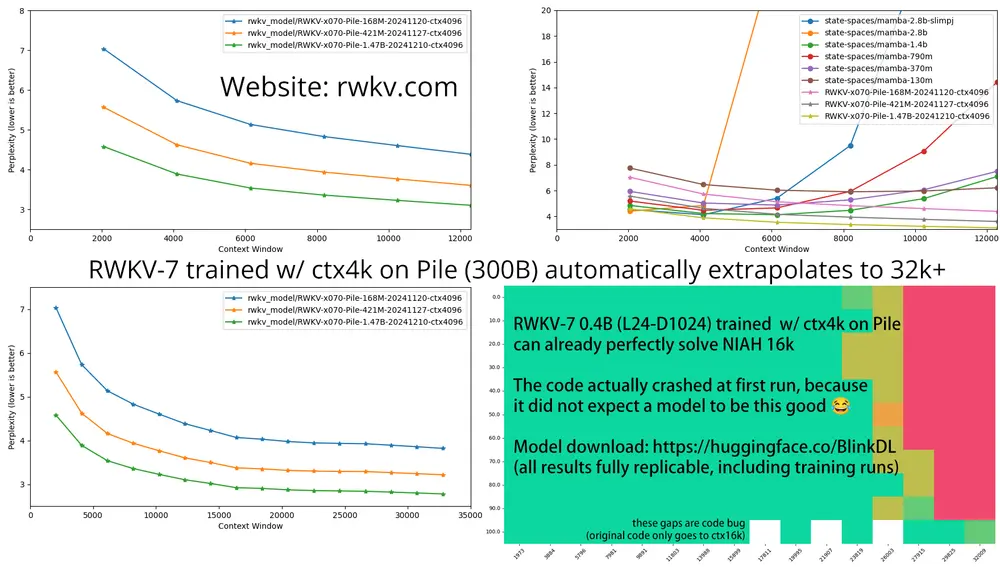

RWKV开源社区推出新型序列建模架构及其预训练语言模型 RWKV-7 "Goose",RWKV-7 是一种基于递归神经网络(RNN)的架构,专为高效处理长序列数据而设计。它在多语言任务上达到了30亿参数规模的新水平,并在英语语言性能上接近当前的最佳水平,尽管其训练数据量远少于其他顶级3B模型。RWKV-7 的主要创新包括引入了向量值门控机制、上下文学习率的扩展以及放松值替换规则。此外,RWKV-7 还展示了在状态跟踪和识别所有正则语言方面的能力,同时保留了训练的并行性。

- 官网地址:https://www.rwkv.cn

- GitHub:https://github.com/BlinkDL/RWKV-LM

主要功能

- 高效序列建模:RWKV-7 通过其独特的状态更新机制,能够高效处理长序列数据,同时保持线性计算复杂度和恒定的内存使用。

- 多语言支持:RWKV-7 在多语言任务上表现出色,尤其是在处理英语、代码和多语言数据时,能够生成高质量的语言模型。

- 预训练和微调:RWKV-7 提供了从0.19亿到29亿参数的多个预训练模型,这些模型可以在特定任务上进行微调,以适应不同的应用场景。

- 多模态扩展:RWKV-7 不仅限于文本数据,还可以扩展到多模态任务,如视觉语言模型,通过整合图像特征和文本嵌入来处理视觉问答等任务。

主要特点

- 向量值门控机制:RWKV-7 引入了向量值门控机制,增强了模型的表达能力,并提供了隐式的相对位置编码。

- 上下文学习率:RWKV-7 将上下文学习率从标量扩展为向量值,允许模型在通道级别上选择性地替换状态数据。

- 放松值替换规则:RWKV-7 允许在状态更新中使用不同的移除键和替换键,提供了更大的灵活性。

- 并行化训练:尽管 RWKV-7 是一种 RNN 架构,但其设计允许高效的并行化训练,从而在大规模数据集上实现快速训练。

- 超越 TC0 的表达能力:RWKV-7 的状态转移矩阵是非对角线的,并且依赖于输入,使其能够表示比 TC0 更复杂的函数,甚至能够识别所有正则语言。

工作原理

- 时间混合(Time Mixing):RWKV-7 的时间混合模块通过一个扩展的 delta 规则来更新状态。该模块首先对输入进行线性插值,然后通过一个门控机制选择性地更新状态。状态更新包括衰减旧状态、移除特定键的值以及添加新值。

- 多层感知机(MLP):RWKV-7 的 MLP 模块是一个两层的感知机,用于处理通道混合。它通过一个 ReLU 激活函数和一个线性层来生成输出。

- 状态更新:RWKV-7 的状态更新机制允许模型在每个时间步动态调整状态。这种机制类似于在线学习,模型在测试时通过梯度下降更新状态,以更好地匹配输入键和输出值。

- 多模态处理:在多模态任务中,RWKV-7 通过将图像特征与文本嵌入结合,扩展到视觉语言模型。这些特征通过一个 MLP 进行处理,并与文本嵌入一起输入到 RWKV-7 模型中。

应用场景

- 语言建模:RWKV-7 在多种语言建模任务上表现出色,例如在英语、多语言和代码生成任务中。它能够生成高质量的文本,适用于自然语言处理中的各种任务,如文本生成、机器翻译和问答系统。

- 多模态任务:通过将图像特征与文本嵌入结合,RWKV-7 可以处理视觉问答任务。例如,在给定一张图片和相关问题时,模型能够生成准确的答案。

- 长序列处理:RWKV-7 的线性复杂度和恒定内存使用使其特别适合处理长序列数据,如长文本生成、文档摘要和长视频生成。

- 多语言支持:RWKV-7 在多语言任务上的表现优于其他模型,能够处理多种语言的混合数据,适用于跨语言任务和多语言对话系统。

- 指令跟随和对齐:尽管当前的 RWKV-7 模型尚未经过指令跟随和对齐的微调,但未来的工作将探索这些能力,以提高模型在实际应用中的可用性。

通过这些功能和特点,RWKV-7 为自然语言处理和多模态任务提供了一个高效、强大的解决方案,特别是在处理长序列和多语言数据方面表现出色。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...