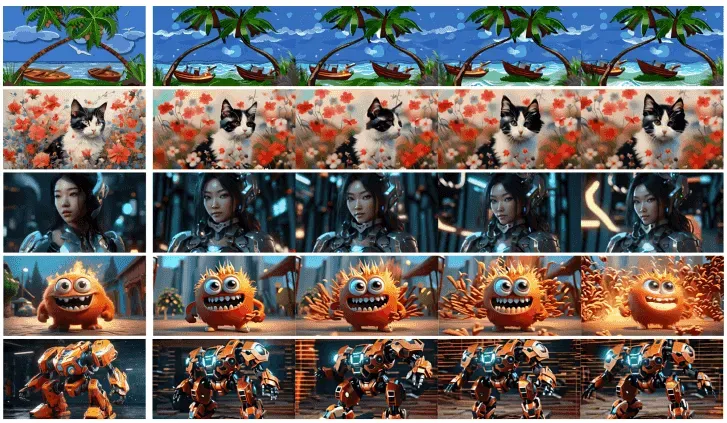

阿里旗下达摩院推出AI视频生成模型I2VGen-XL,可以根据用户输入的静态图像和文本生成目标接近、语义相同的视频,生成的视频具高清 (1280 * 720)、宽屏 (16:9)、时序连贯、质感好等特点。

这个模型特别关注于提高视频的语义一致性和时空连续性,同时保持输入图像的内容和结构。

主要功能:

- 从静态图像生成具有丰富动作和清晰细节的高质量视频。

- 在保持图像内容和结构的同时,确保视频的语义一致性和时空连贯性。

主要特点:

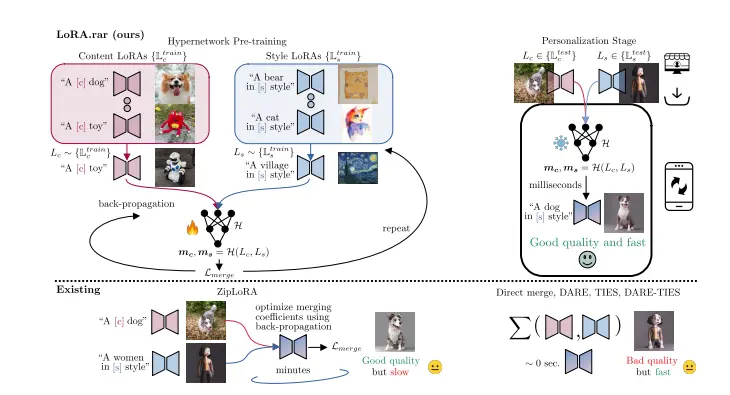

- 两阶段生成过程:I2VGen-XL分为两个阶段。第一阶段(基础阶段)在低分辨率下生成视频,确保语义一致性并保留输入图像的内容。第二阶段(精细化阶段)提高视频分辨率,并细化视频中的细节,同时改善时空连贯性。

- 多级特征提取:在基础阶段,模型使用两个层次的编码器来提取输入图像的高级语义和低级细节,并通过交叉注意力机制将这些特征整合到视频中。

- 精细化模型:在精细化阶段,模型使用简单的文本作为条件,通过噪声-去噪过程生成高分辨率视频,从而提高视频质量。

工作原理:

- 基础阶段:使用预训练的VQGAN编码器将视频压缩成低维潜在表示,然后通过3D UNet进行去噪,生成低分辨率视频。这个阶段的模型通过两个编码器(CLIP编码器和可训练的内容编码器)来提取图像的语义和细节特征。

- 精细化阶段:在基础阶段生成的低分辨率视频基础上,训练一个专门的视频扩散模型,通过添加噪声和去噪过程,生成高分辨率视频。这个模型使用用户提供的简单文本作为条件,而不是原始输入图像。

尽管I2VGen-XL在视频合成领域取得了显著进步,但仍存在一些局限性,如人体动作生成的自然性和自由度、生成长视频的能力以及对用户意图的理解。这些挑战为未来的研究提供了方向。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...