在数字角色创作领域,2D卡通风格因其独特的魅力而深受年轻观众的喜爱。尽管3D角色研究取得了显著进展,但交互式2D卡通角色的发展却显得相对滞后。为了解决这一问题,阿里巴巴通义实验室推出了Textoon,这是一种能够根据文本描述快速生成多样化、可交互的2D卡通角色的新方法。

Textoon 利用先进的语言和视觉模型,将简单的文本输入转化为生动的Live2D格式的卡通角色。例如,用户输入一段描述:“一个女孩,有着长长的金色头发和蓝色的眼睛,穿着浅绿色的V领短袖上衣,搭配蓝色格子短裙和黑色短靴。” Textoon可以根据这段描述生成一个具有动画效果的2D卡通角色,角色的外观和动作都符合文本中的描述。

主要功能

- 文本生成角色:用户只需输入一段文本描述,Textoon即可快速生成对应的2D卡通角色。

- 动画效果支持:生成的角色支持动画功能,能够实现类似3D效果的交互性动作。

- 编辑功能:用户可以对生成的角色进行编辑,修改细节部分,如发型、服装等。

- 实时渲染:生成的角色可以使用HTML5进行轻量级渲染,适合在移动设备和网页应用中使用。

核心特点

- 精准的文本解析能力:Textoon的文本解析模型可以精确地从复杂描述中识别出特定特征,如发型(后发、侧发、刘海)、眼睛颜色、眉毛样式、脸型、服装类型等,从而提供高度灵活的用户输入体验。

- 可控的外观生成机制:在完成文本解析之后,Textoon会将各个组件合成一个完整的角色模板。通过轮廓边界对角色形状进行精确控制,再由文本到图像模型负责填充内部的颜色和纹理,确保最终生成的角色既美观又符合用户预期。

- 强大的可编辑性:用户如果对初次生成的结果不满意,可以通过框架提供的辅助功能对特定区域进行修改,包括添加、删除或调整元素,实现对角色细节的精细控制。

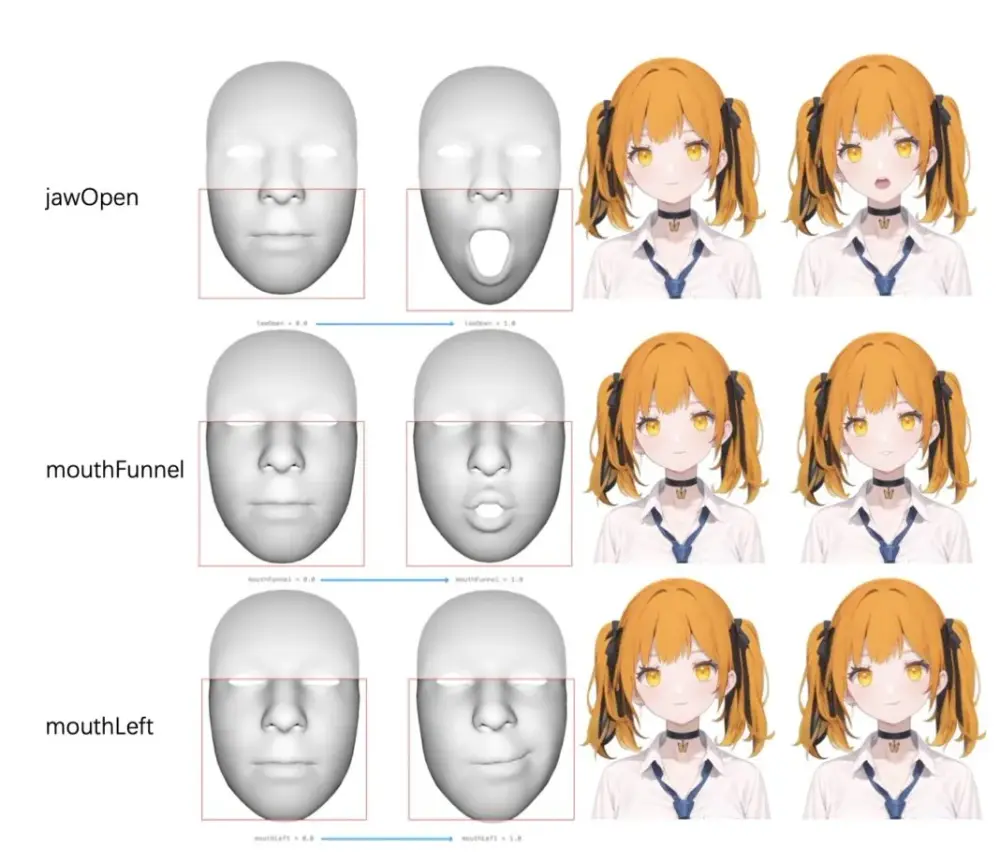

- 增强的动画效果:为了提高卡通角色语音动画的真实感和准确性,Textoon集成了ARKit的面部混合形状功能到Live2D的唇形同步过程中,优化了MouthOpenY和MouthForm系数的表现,使得角色的表情更加自然流畅。

方法概述

框架设计

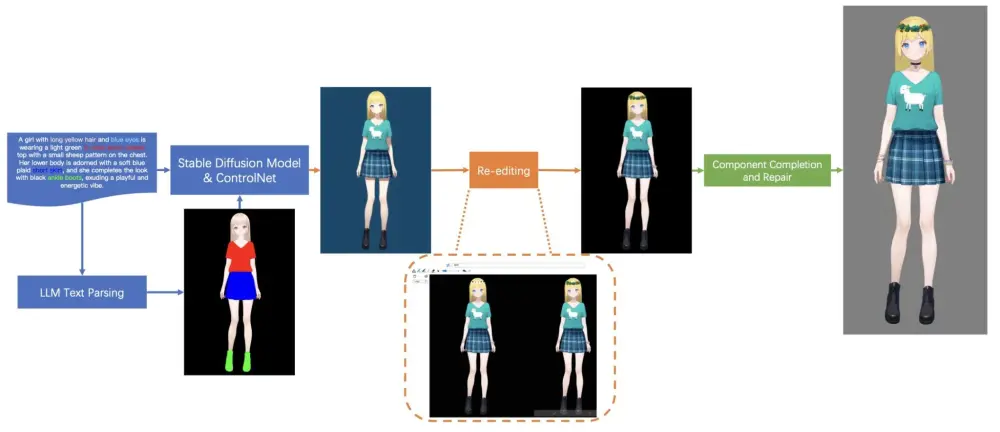

Textoon利用微调后的大型语言模型(LLMs)从用户提供的文本描述中提取关键组件信息,并据此控制2D卡通角色的外观生成过程。该框架不仅支持重新编辑细节,还能将生成的图像转化为Live2D模型纹理,确保了生成角色的多样性和动画兼容性。

工作原理

- 文本解析:利用大语言模型(LLM)对输入的文本描述进行解析,提取关键信息(如发型、服装、颜色等)。

- 可控外观生成:通过文本到图像模型(如Stable Diffusion)生成角色的外观,并结合轮廓边界控制生成角色的形状和纹理。

- 组件拆分与重组:将复杂的Live2D模型拆分为多个组件(如头发、上衣、裙子等),并根据用户需求重新组合。

- 动画优化:通过整合ARKit的面部表情参数,优化Live2D模型的动画效果,提升角色的生动性和交互性。

- 编辑与修复:用户可以通过简单的草图或文字标注对生成的角色进行编辑,系统会自动修复和调整细节。

应用前景

Textoon作为一种创新的解决方案,极大地简化了2D卡通角色的创建流程,使得即使是非专业用户也能轻松制作出高质量的卡通形象。无论是用于教育、娱乐还是商业用途,Textoon都展现了其广泛的适用性和巨大的潜力。随着技术的不断进步,我们有理由相信,Textoon将在未来的数字内容创作中扮演越来越重要的角色。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...