图形用户界面(GUI)是用户与软件交互的核心。然而,构建能够有效导航GUI的智能代理一直是一个持续的挑战。传统方法在适应性方面存在不足,尤其是在处理复杂布局或GUI频繁变化时,这些问题限制了自动化GUI相关任务(如软件测试、无障碍增强和日常任务自动化)的进展。

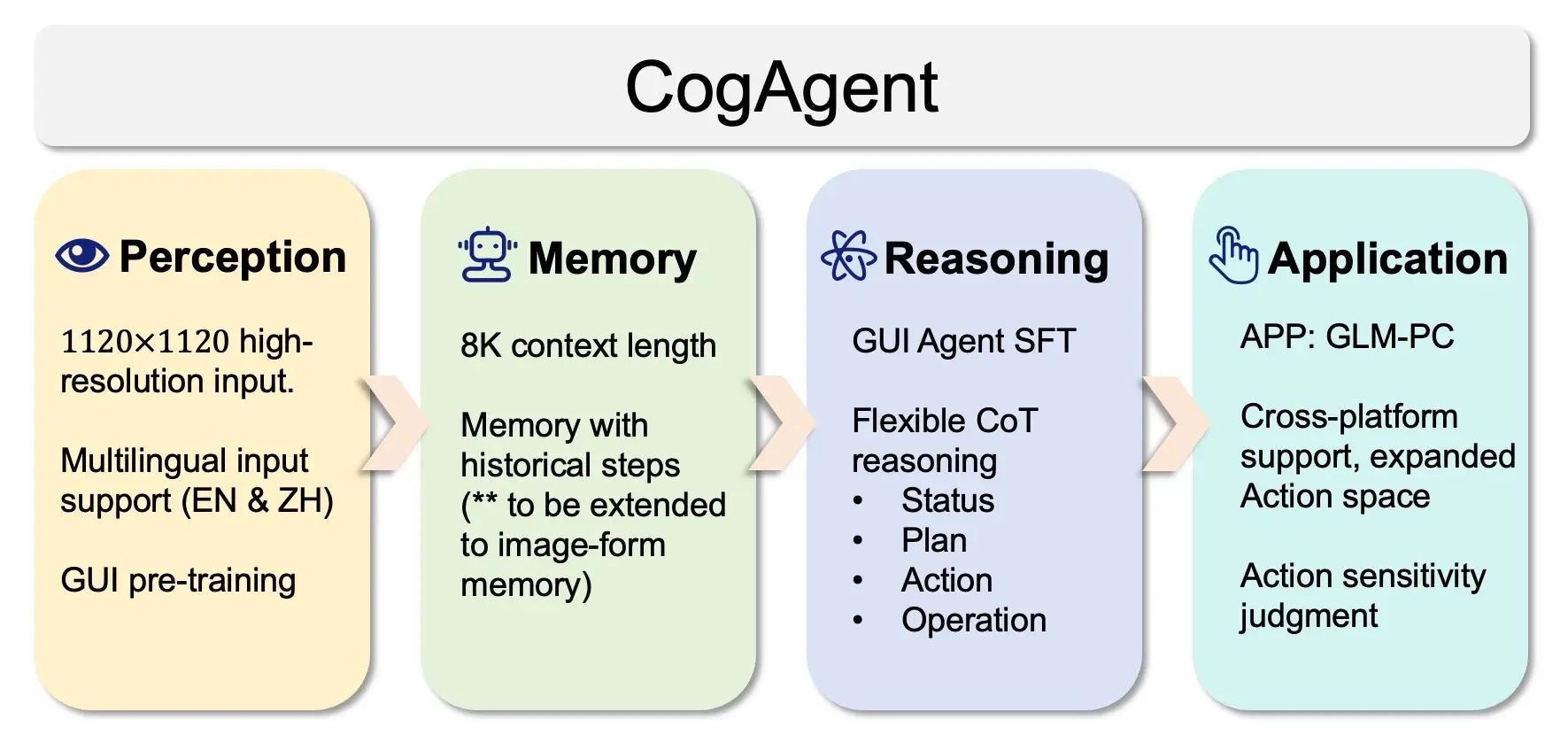

为了解决这些问题,清华大学和智谱AI的研究团队开源并发布了 CogAgent-9B-20241220,这是CogAgent的最新版本。CogAgent是一款基于视觉语言模型(VLM)的开源GUI代理工具,通过结合视觉和语言能力,能够有效导航和与GUI交互。其模块化和可扩展的设计使其成为开发者和研究人员的宝贵资源。

模型资源

| Model | 模型下载地址 | 技术文档 | 在线体验 |

|---|---|---|---|

| cogagent-9b-20241220 | 🤗 HuggingFace 🤖 ModelScope 🟣 WiseModel 🧩 Modelers(昇腾) | 📄 官方技术博客 📘 实操文档(中文) | 🤗 HuggingFace Space 🤖 ModelScope Space 🧩 Modelers Space(昇腾) |

CogAgent的核心功能

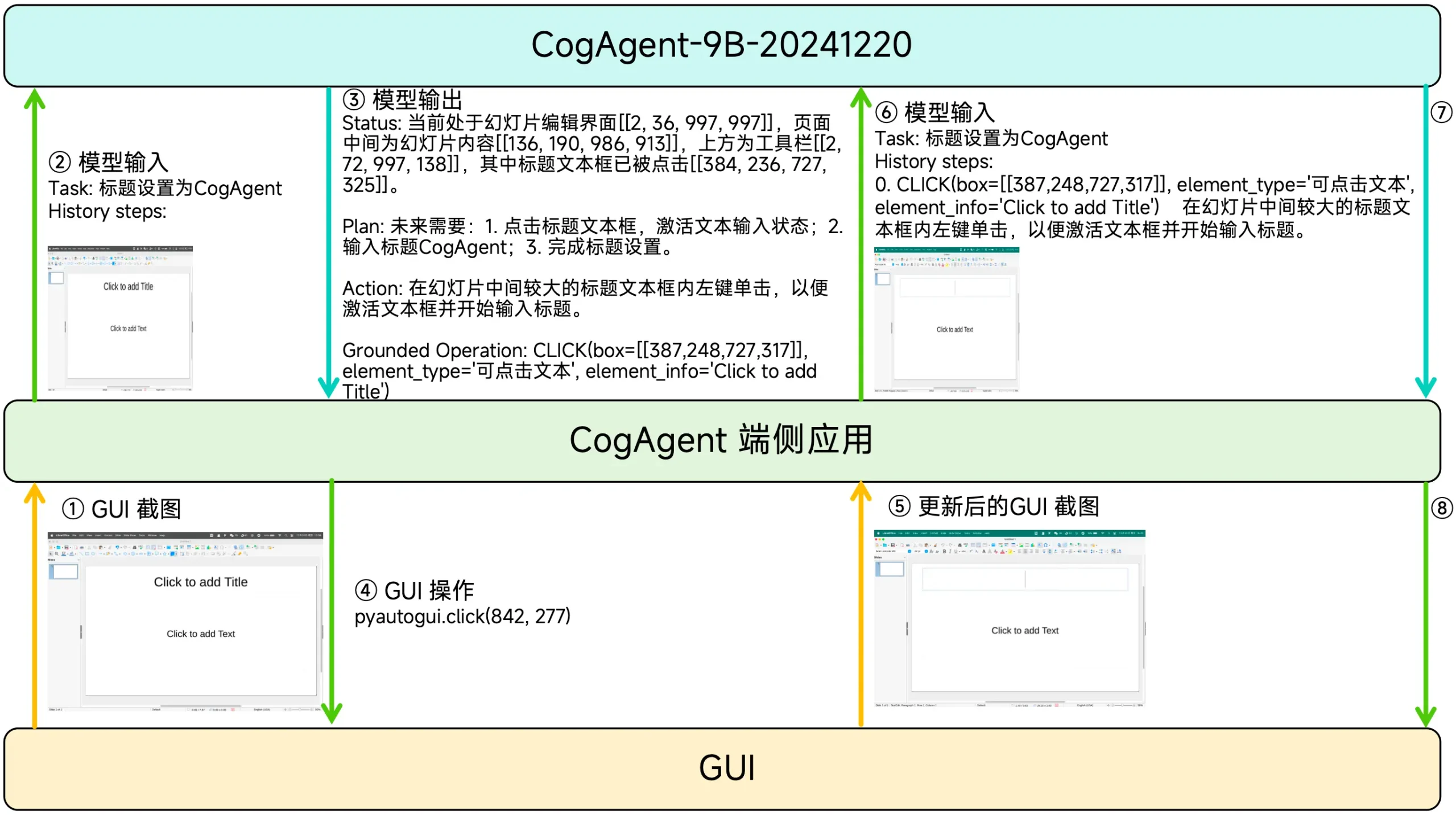

CogAgent的核心在于利用VLM解释GUI组件及其功能。通过处理视觉布局和语义信息,它能够精确可靠地执行点击按钮、输入文本和导航菜单等任务。

技术细节与优势

CogAgent的架构基于先进的VLM,能够同时处理视觉数据(如截图)和文本信息。它采用双流注意力机制,将视觉元素(如按钮和图标)映射到其文本标签或描述,从而增强预测用户意图和执行相关操作的能力。

CogAgent的突出特点之一是能够在无需大量重新训练的情况下,泛化到各种GUI。迁移学习技术使其能够快速适应新的布局和交互模式。此外,它还集成了强化学习,通过反馈优化性能。其模块化设计支持与第三方工具和数据集的无缝集成,使其适用于不同的应用场景。

CogAgent的主要优势包括:

- 更高的准确性:通过整合视觉和语言线索,模型比传统GUI自动化解决方案具有更高的精度。

- 灵活性与可扩展性:其设计使其能够在不同行业和平台上工作,只需最少的调整。

- 社区驱动的开发:作为开源项目,CogAgent促进了协作与创新,鼓励更广泛的应用和改进。

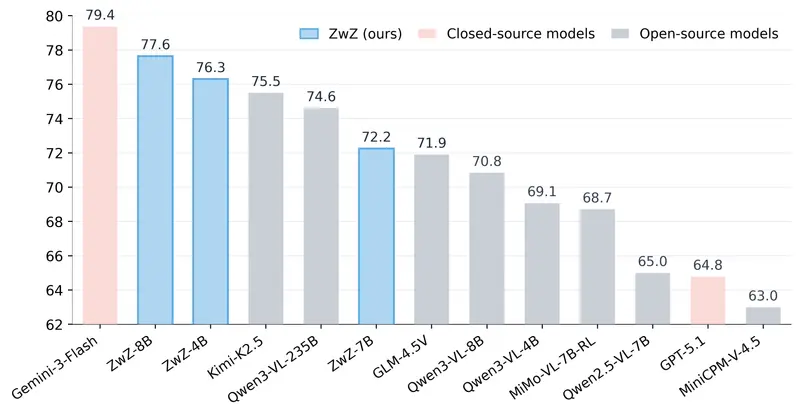

测试结果与洞察

CogAgent的评估结果显示了其卓越的有效性。根据其 技术报告,该模型在GUI交互基准测试中表现领先。例如,在自动化软件导航任务中,它在准确性和速度方面均超越了现有方法。测试人员注意到,它在处理复杂布局和具有挑战性的场景时表现出色。

此外,CogAgent在数据使用效率方面也表现出色。实验表明,与传统模型相比,它所需的标注示例减少了50%,使其在实际部署中更具成本效益和实用性。随着时间的推移,模型从用户交互和特定应用场景中学习,进一步增强了其适应性和性能。

相关文章