北京大学、小红书和卡内基梅隆大学的研究人员推出一种无需图像数据的方法Diff-Instruct*(DI*),用于构建符合人类偏好的一步式文本到图像生成模型,同时保持生成高度逼真图像的能力。研究团队将人类偏好对齐问题框架化为基于人类反馈的在线强化学习(RLHF),目标是在最大化奖励函数的同时,通过正则化生成器分布使其接近参考扩散过程。例如,我们有一个文本提示:“一只坐在草地上的小猫”。使用DI*方法训练的模型能够直接从这个文本提示生成一张图像,这张图像不仅符合文本描述,而且在审美、布局和颜色上更符合人类的偏好。

与传统RLHF方法依赖KL散度进行正则化不同,研究团队引入了一种新颖的基于分数的散度正则化方法,显著提升了性能。尽管直接计算这种偏好对齐目标仍然不可行,但研究团队证明了可以通过推导一个等效且可处理的损失函数来高效计算其梯度。

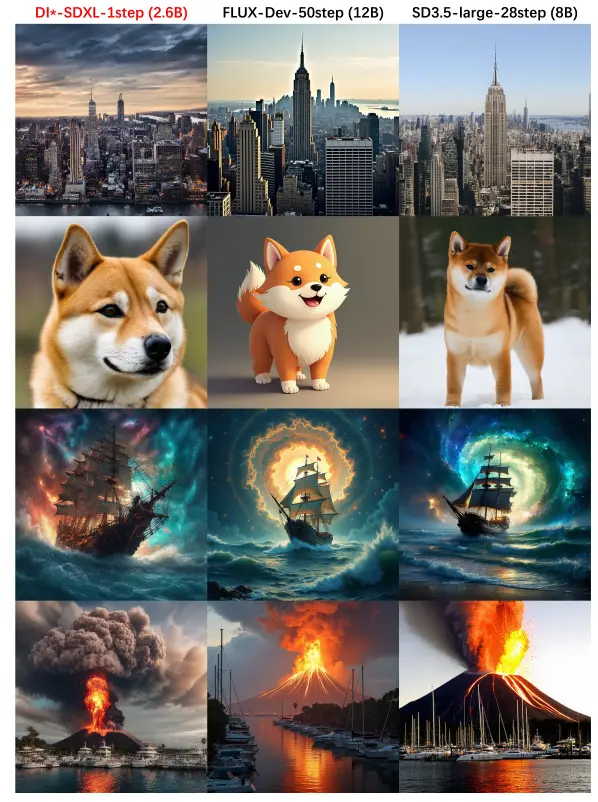

值得注意的是,研究团队使用 Diff-Instruct* 训练了一个基于 Stable Diffusion-XL 的一步式模型——2.6B DI-SDXL-1step* 文本到图像生成模型。该模型仅需1步生成即可生成分辨率为1024×1024的图像。DI-SDXL-1step* 模型仅使用1.88%的推理时间和29.30%的GPU内存成本,在 PickScore、ImageReward 和 CLIPScore(基于Parti提示基准)以及 HPSv2.1(基于人类偏好评分基准)上显著优于12B FLUX-dev-50step模型,确立了人类偏好一步式文本到图像生成模型的新标杆。

关键贡献

- 无需图像数据:DI* 是一种无需图像数据的方法,能够高效训练文本到图像生成模型。

- 基于分数的正则化:引入新颖的基于分数的散度正则化,显著提升模型性能。

- 一步生成:DI*-SDXL-1step 模型仅需1步生成即可生成高分辨率图像,大幅减少推理时间和资源消耗。

- 人类偏好对齐:在多个人类偏好基准上取得最先进性能,同时保持图像多样性和质量。

主要功能和特点

- 功能:训练一步式文本到图像生成模型,使其输出与人类偏好对齐。

- 特点:

- 无需图像数据:DI*不需要实际的图像数据,减少了对大量数据的依赖。

- 一步生成:模型能够直接从噪声生成图像,仅需一步,提高了效率。

- 人类偏好对齐:通过RLHF,模型生成的图像更符合人类的美学和偏好。

- 高分辨率输出:能够生成高达1024×1024分辨率的图像。

工作原理

DI*的工作原理基于以下几个关键步骤:

- 问题设定:定义人类奖励函数来编码人类对图像和对应文本描述的偏好,并使用预训练的扩散模型作为参考分布。

- 目标函数:训练目标是最大化预期人类奖励,同时通过分布差异正则化项保持生成图像的现实性。

- 分数基差异正则化:引入基于分数的差异正则化,以保持生成样本的多样性。

- 梯度计算:虽然直接计算偏好对齐目标不可行,但DI*通过导出等效且可行的损失函数来高效计算梯度。

- 模型更新:交替更新一步模型和辅助扩散模型,以逼近一步模型的分数函数。

实验结果

- 定量评估:在 Parti 提示基准 和 Human Preference Score 基准 上,DI*-SDXL-1step 模型显著优于现有模型。

- 定性评估:DI* 在图像多样性、布局和色彩美学方面表现出色,生成结果更具吸引力。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...