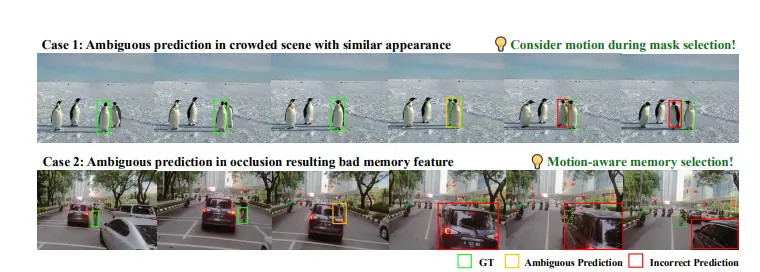

Segment Anything Model 2 (SAM 2) 是一个在物体分割任务中表现出色的模型,但在视觉物体跟踪方面仍面临一些挑战。特别是在处理拥挤场景中快速移动或自我遮挡的物体时,SAM 2 的性能会受到影响。此外,SAM 2 使用的固定窗口记忆方法未能充分考虑记忆的质量,导致视频中错误的传播。

- 项目主页:https://yangchris11.github.io/samurai

- GitHub:https://github.com/yangchris11/samurai

- ComfyUI插件:https://github.com/takemetosiberia/ComfyUI-SAMURAI--SAM2-

SAMURAI:增强适应版本

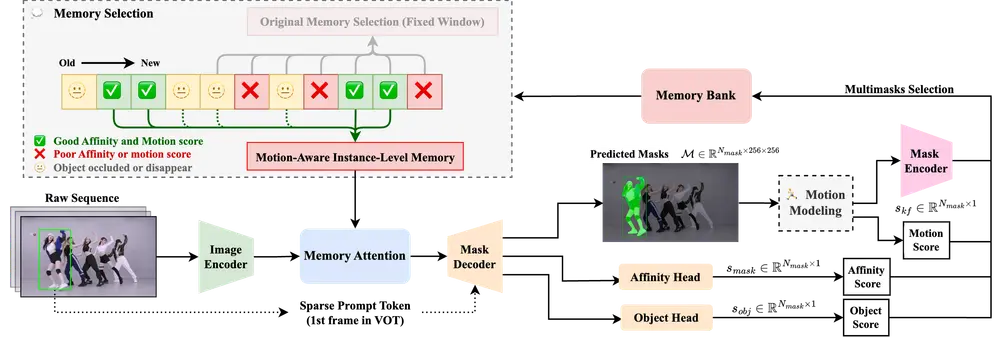

为了解决这些问题,华盛顿大学的研究人员开发了 SAMURAI,这是 SAM 2 的一个增强适应版本,专门设计用于视觉物体跟踪。SAMURAI 通过以下技术创新,实现了稳健、精确的跟踪:

时间运动线索:SAMURAI 结合了时间运动线索,通过分析连续帧之间的运动信息,更准确地预测物体的运动轨迹。 运动感知记忆选择机制:SAMURAI 引入了一种运动感知记忆选择机制,该机制根据当前帧和前几帧的特征,动态选择最相关的记忆片段。这种方法不仅提高了掩码选择的准确性,还减少了错误的传播。

例如,在一段视频中,如果有一个快速移动的自行车在拥挤的交通场景中,传统的跟踪算法可能会因为自行车的快速运动或与其他相似对象的交互而失去跟踪。SAMURAI通过考虑自行车的历史轨迹和运动信息,能够更好地区分视觉上相似的对象,并在自遮挡发生时保持跟踪的准确性。

主要特点

零样本学习:SAMURAI能够在不需要额外训练或微调的情况下,在多个VOT基准测试中实现最先进的性能,显示出在不同数据集上的强泛化能力。 实时性能:SAMURAI能够实现实时在线推理,适用于动态环境中的实际应用。 鲁棒性:在复杂跟踪场景中,如LaSOT、LaSOText和GOT-10k基准测试中,SAMURAI显示出比现有跟踪器更高的成功率和精确度。

工作原理

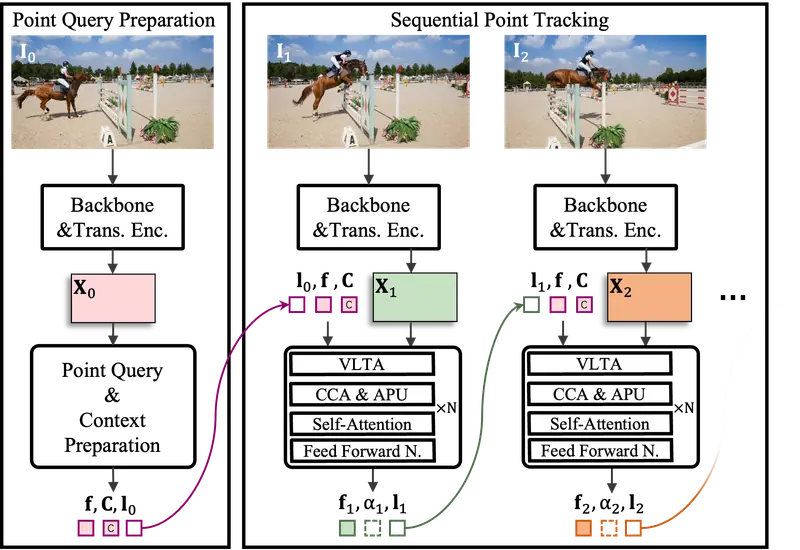

SAMURAI的工作原理包括以下几个关键步骤:

运动建模:使用基于Kalman滤波器的运动模型来预测对象的运动轨迹,并辅助选择最有信心的掩码。 记忆注意力层:通过自注意力和交叉注意力机制,将当前帧的图像嵌入与记忆库中的内容结合起来,为当前帧提供上下文信息。 记忆编码器和记忆库:将每一帧生成的输出掩码通过记忆编码器转换为记忆嵌入,并将其添加到记忆库中,用于后续帧的跟踪任务。 运动感知记忆选择:基于掩码亲和力分数、对象发生分数和运动分数选择记忆库中的记忆,以构建有效的记忆库。

性能表现

实时运行与零样本性能

实时运行:SAMURAI 能够在实时环境中运行,适用于动态场景中的实时跟踪任务。 零样本性能:在各种基准数据集上,SAMURAI 展示了强大的零样本性能,无需重新训练或微调即可实现高精度的跟踪。

基准测试结果

LaSOT-ext 数据集:SAMURAI 在 LaSOT-ext 数据集上获得了 7.1% 的 AUC(Area Under the Curve)增益。 GOT-10k 数据集:在 GOT-10k 数据集上,SAMURAI 获得了 3.5% 的 AO(Average Overlap)增益。 LaSOT 数据集:与 LaSOT 数据集上的全监督方法相比,SAMURAI 取得了有竞争力的结果,突显了其在复杂跟踪场景中的稳健性。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...