在开源 AI 领域长期由 Meta(Llama)和中国实验室(Qwen、MiniMax、智谱等)主导的背景下,一家总部位于旧金山的初创公司 Arcee AI 正式发布了 Trinity-Large-Thinking,一个拥有 3990 亿参数 的纯文本推理模型。该模型采用 Apache 2.0 许可证完全开源,允许任何企业和个人自由下载、定制及商业使用。这不仅是一个新模型的诞生,更被视为美国开源社区在“封闭化”和“地缘政治不确定性”夹击下,重夺技术主权的一次战略反击。

- 官方介绍:https://www.arcee.ai/blog/trinity-large-thinking

- 模型:https://huggingface.co/arcee-ai

核心亮点:小团队的大赌注

- 极致性价比:虽然总参数量高达 400B,但得益于 混合专家 (MoE) 架构,每次推理仅激活 130 亿 (13B) 参数(占比约 3.2%)。这意味着它拥有超大模型的智慧,却只需中小模型的算力,推理速度是同类竞品的 2-3 倍。

- “思考”能力升级:区别于传统的指令模型,Trinity 引入了显式的 “思考 (Thinking)” 阶段。在生成回答前,模型会进行内部逻辑推演,显著提升了在处理复杂数学、多步智能体任务(Agent Tasks)和长上下文连贯性上的表现。

- 完全自主可控:采用宽松的 Apache 2.0 许可证,无社区限制条款。企业可将其私有化部署、微调甚至蒸馏,无需担心版权陷阱或地缘政治导致的断供风险。

技术揭秘:约束下的工程奇迹

Arcee 仅由 30 人 组成,却完成了巨头才能驾驭的训练任务:

- 豪赌式训练:团队将 A 轮融资的一半(约 2000 万美元)投入了一次为期 33 天 的训练运行,使用了 2048 块 NVIDIA B300 Blackwell GPU。

- SMEBU 算法:为解决 MoE 架构中常见的“专家坍塌”问题(即只有少数专家被激活),Arcee 发明了 SMEBU (软钳位动量专家偏差更新) 机制,确保所有专家均衡参与,提升模型泛化能力。

- 高质量数据:与 DatologyAI 合作,构建了包含 20 万亿 Token 的课程,其中 50% 为经过合成重写的高质量数据,旨在教会模型“推理”而非单纯“记忆”。同时严格剔除版权不明数据,规避法律风险。

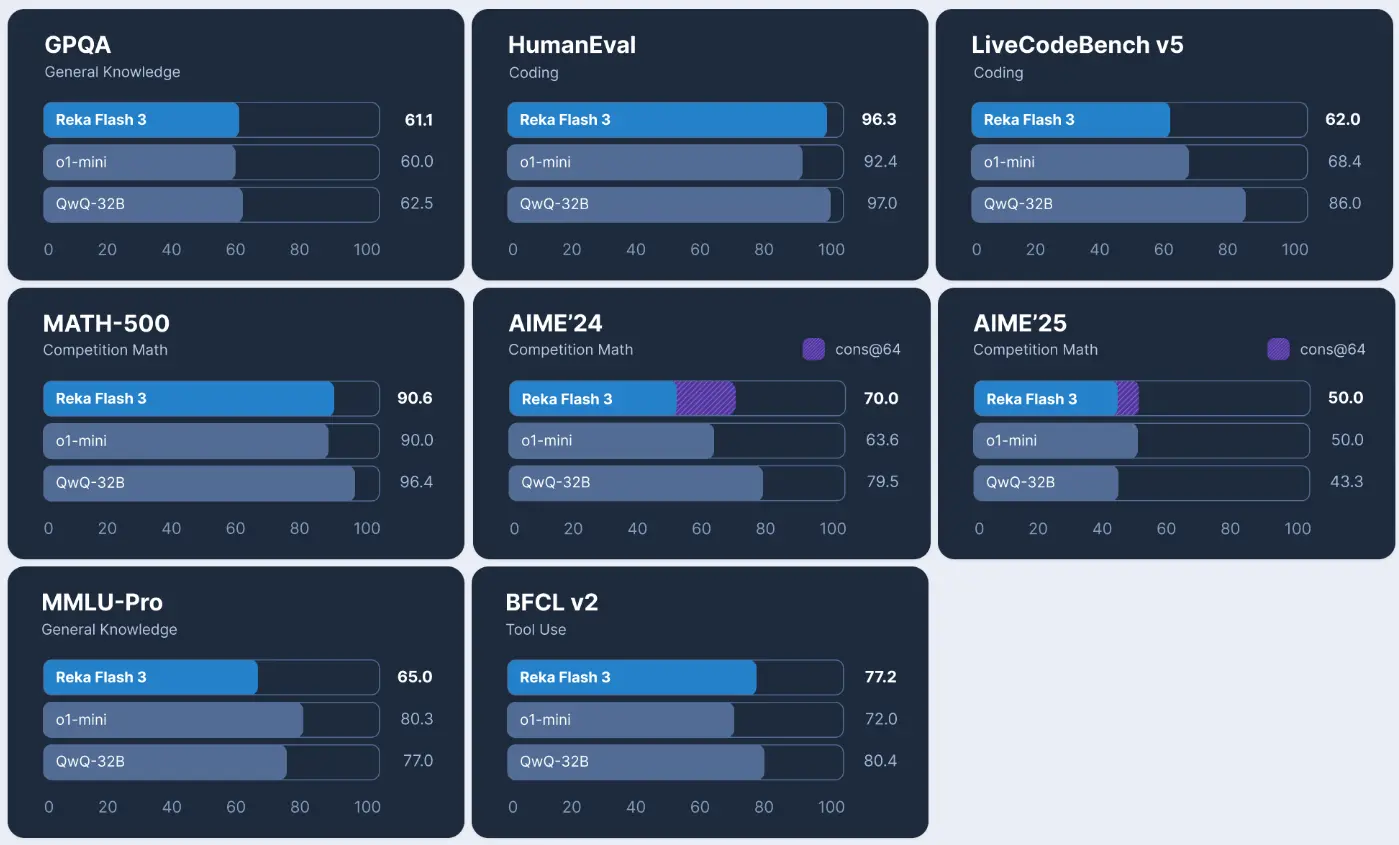

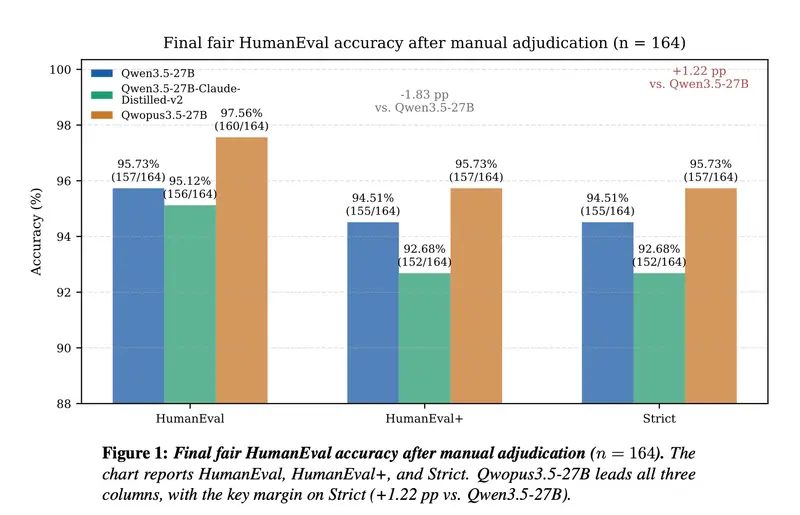

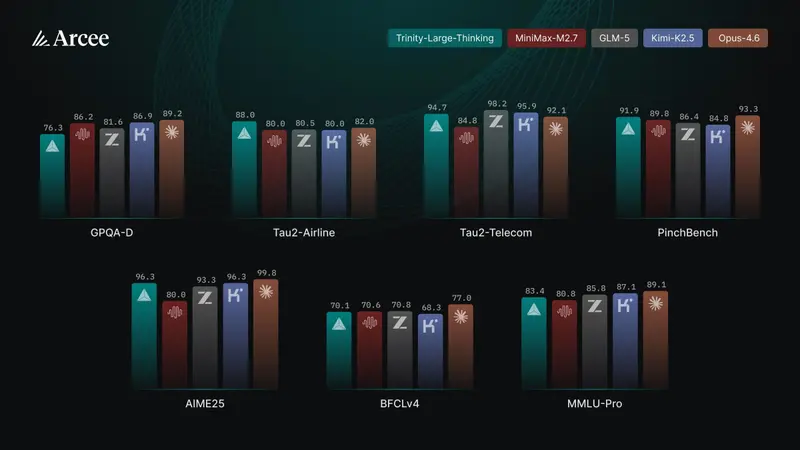

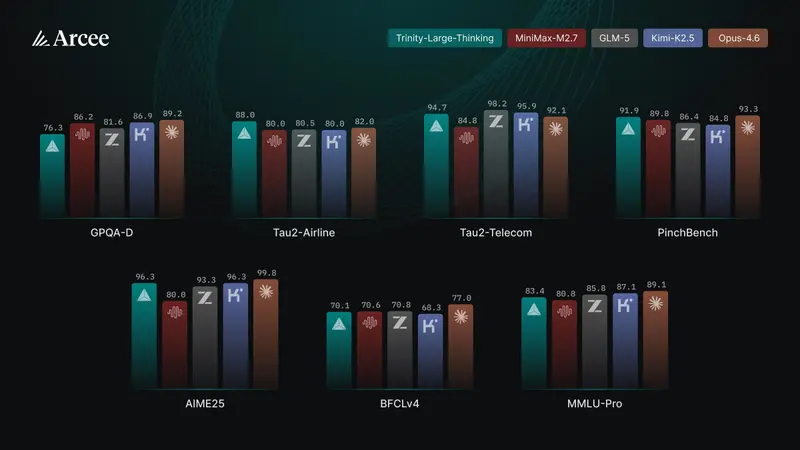

性能基准:直逼顶级闭源模型

Trinity-Large-Thinking 在多项关键基准测试中展现了前沿竞争力,尤其是在 智能体 (Agent) 和 推理 任务上:

| 基准测试 | Arcee Trinity-Large | Claude Opus 4.6 (闭源) | gpt-oss-120B | Google Gemma 4 |

|---|---|---|---|---|

| PinchBench (智能体) | 91.9 | 93.3 | 69.0 | 93.3 |

| AIME25 (数学) | 96.3 | - | 97.9 | 89.2 |

| IFBench (指令遵循) | 52.3 | 53.1 | - | - |

| GPQA-D (科学) | 76.3 | - | 80.1 | 84.3 |

| 成本 (每百万输出 Token) | $0.90 | $25.00 | - | - |

- 智能体任务:在 PinchBench 上得分 91.9,仅略低于目前的王者 Claude Opus 4.6 (93.3),远超其他开源模型。

- 数学推理:AIME25 得分 96.3,与顶尖水平持平。

- 成本优势:性能接近 Claude Opus 4.6,但推理成本仅为后者的 4% ($0.90 vs $25.00)。

战略意义:填补“美国开源”空白

Arcee 的入局恰逢其时:

- 中国模型转向:曾经开源先锋如阿里巴巴 Qwen 开始转向专有企业服务,高端开源权重供应减少。

- Meta 的犹豫:Llama 4 发布后反响平平,Meta 在前沿开源领域的领导力受到质疑。

- 企业焦虑:金融、国防等受监管行业急需一个美国本土、无版权争议、可完全审计的基础模型。

Arcee 不仅提供了模型权重,还发布了 Trinity-Large-TrueBase(原始预训练检查点),允许研究人员从“白纸”开始进行对齐研究,这对于需要严格合规的行业至关重要。

企业该如何选择?

- 构建自主智能体 (Agents):首选 Arcee Trinity-Large。其稀疏架构和“思考”能力专为长周期、多步逻辑任务设计,且成本极低。

- 资源受限的推理任务:gpt-oss-120B 仍是单卡部署的高性价比选择。

- 通用知识库与 RAG:Google Gemma 4 和 IBM Granite 4.0 在文档处理和通用知识密度上仍有优势。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...