Marco-Nano-Base 是由 阿里巴巴国际数字商业集团 (AIDC) 最新推出的紧凑型混合专家(MoE)大语言模型。作为 Marco-MoE 家族的最新成员,它通过极致的稀疏化设计,在保持 8B 总参数量 的同时,每个 token 仅激活 0.6B 参数(激活率低至 7.5%)。

- GitHub:https://github.com/AIDC-AI/Marco-LLM

- 模型:https://huggingface.co/collections/AIDC-AI/marco-moe

这一设计使得 Marco-Nano 在推理速度和计算成本上远低于同等规模的稠密模型,却在 29 种语言 的理解与生成任务中展现了超越众多更大激活参数模型的卓越性能,真正实现了“小身材,大智慧”。

核心架构:稀疏化的艺术

Marco-Nano 基于 Decoder-only Transformer 架构,其核心创新在于用 稀疏 MoE 层 替换了传统的前馈网络(FFN),并引入了多项先进技术以提升专家多样性与效率:

- 细粒度子矩阵拆分:将专家参数更精细地划分,提升模型表达能力。

- Drop-Upcycling 技术:从 Qwen3-0.6B-Base 升级而来,通过复用和扩展预训练权重,加速收敛并提升性能。

- 超大规模专家库:拥有 232 个专家,但每次推理仅动态激活其中的 8 个,确保高效性与专业性的平衡。

关键规格参数

| 配置项 | 数值 | 备注 |

|---|---|---|

| 总参数量 | 8B | 庞大的知识储备库 |

| 激活参数量 | 0.6B | 极低,推理速度极快 |

| 激活率 | 7.5% | 极致稀疏 |

| 层数 (Layers) | 28 | 深度适中 |

| 隐藏层维度 | 1024 | |

| 专家总数 | 232 | 丰富的专家池 |

| 激活专家数 | 8 | 每次推理调用 |

| KV 头数 | 8 (GQA) | 优化显存占用 |

| 训练 Token 数 | 5.1T | 海量数据滋养 |

四阶段课程学习:从基础到文化精通

Marco-Nano 在 5.1 万亿 (5.1T) 高质量 Token 上进行了精心设计的四阶段预训练:

- 阶段 1 (0 - 2.4T):基础奠基。聚焦高质量英语数据 (Nemotron-CC-v2)、推理指令数据及 19 种主流语言的多语言网页/问答数据。

- 阶段 2 (2.4T - 4.1T):优化与上采样。增加推理语料库权重,调整英语网页数据比例,显著提升中文数据占比,并应用学习率衰减策略。

- 阶段 3 (4.1T - 4.6T):语言扩展。新增 9 种语言(孟加拉语、捷克语、乌尔都语、哈萨克语、希腊语、罗马尼亚语、匈牙利语、尼泊尔语、阿塞拜疆语),强化中等资源语言能力。

- 阶段 4 (4.6T - 5.1T):合成数据集成。引入精选的多语言合成数据,包括文化内涵丰富的 Fineweb2-Culture 数据集和合成区域多选题,提升模型的文化敏感度。

🗣️ 支持的 29 种语言

英语、中文、阿拉伯语、德语、西班牙语、法语、韩语、日语、葡萄牙语、土耳其语、印尼语、意大利语、荷兰语、波兰语、俄语、越南语、泰语、希伯来语、乌克兰语、马来语,以及新增的孟加拉语、捷克语、乌尔都语、哈萨克语、希腊语、罗马尼亚语、匈牙利语、尼泊尔语、阿塞拜疆语。

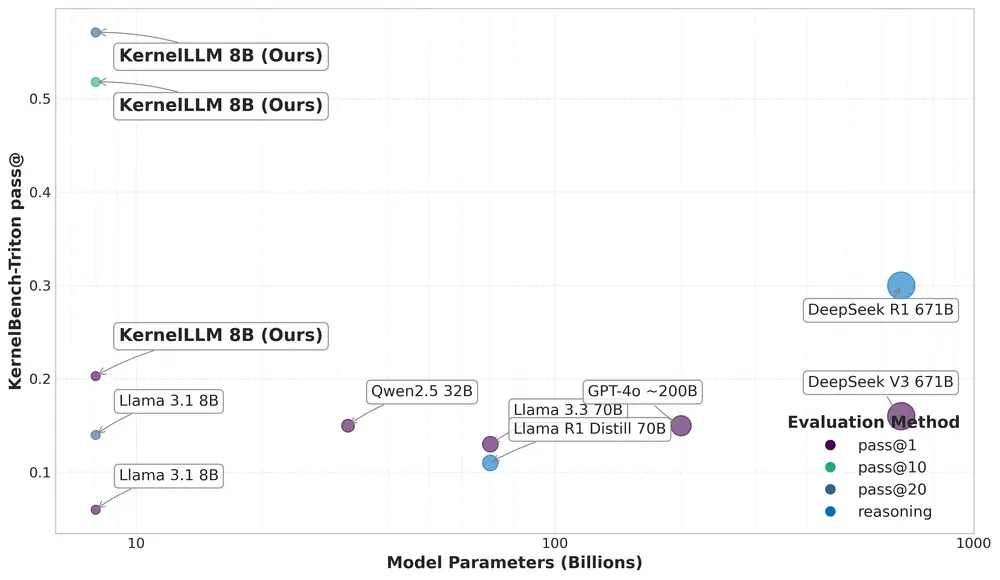

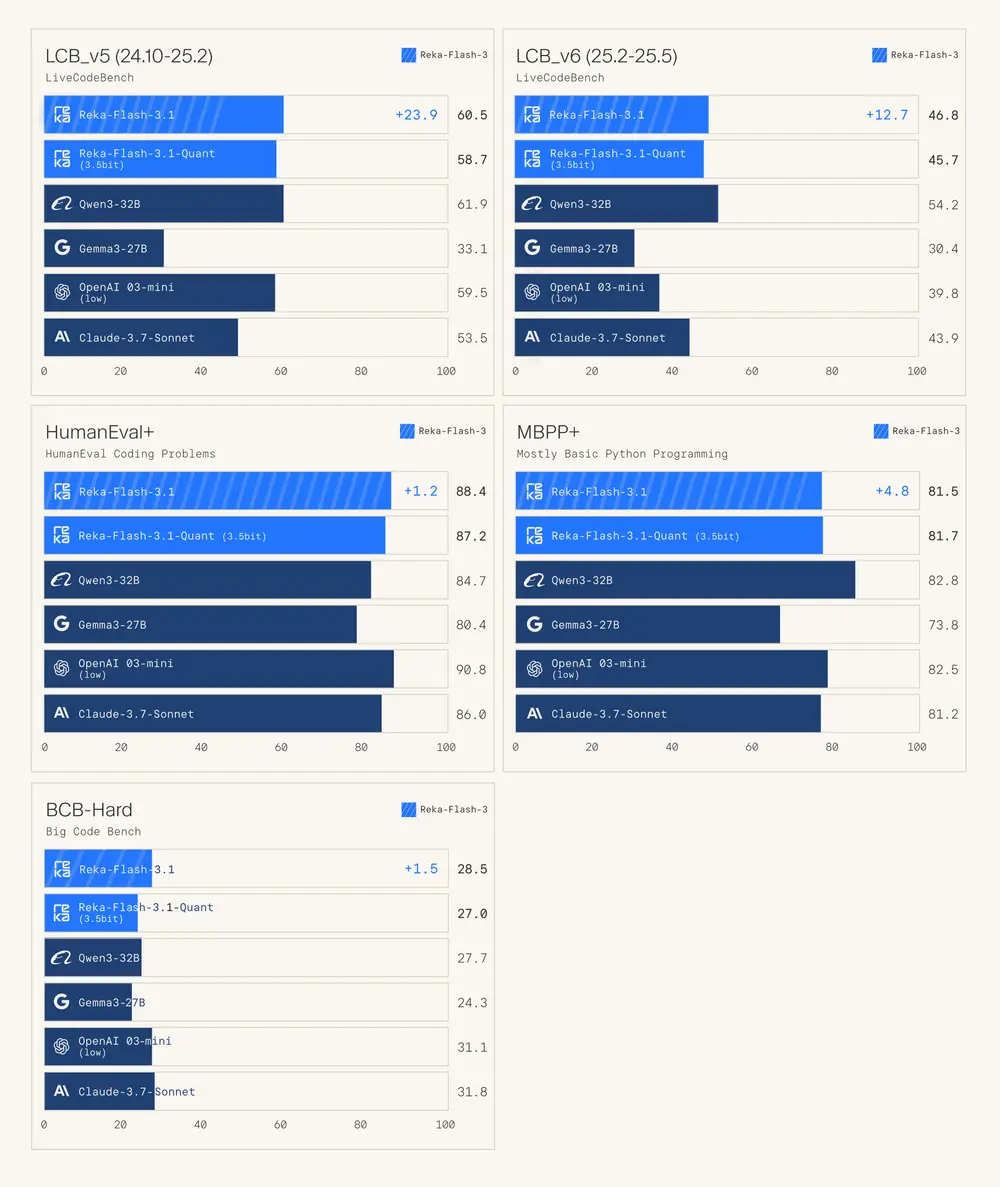

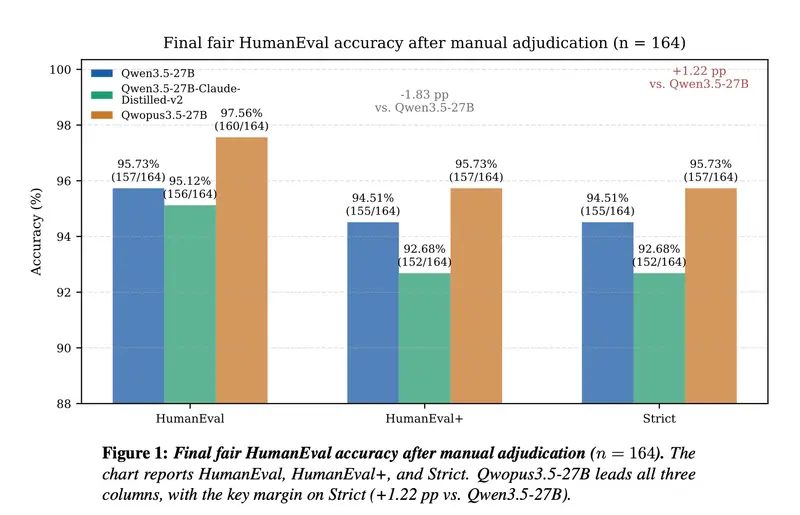

性能评估:以小博大,全面领先

在多项权威基准测试中,Marco-Nano (激活 0.6B) 不仅超越了同量级的稠密模型(如 Qwen3-1.7B, 激活 1.7B),甚至在多语言和文化理解任务上击败了激活参数更大的竞品(如 Trinity Nano, Granite4-Tiny)。

1. 英语能力:稳健出色

尽管激活参数最小,Marco-Nano 在综合平均分上达到 57.5,优于 Qwen3-1.7B (55.9) 和 Trinity Nano (56.7),仅次于激活参数更大的 Granite4-Tiny (59.8)。

- 亮点:在 MMLU-Pro (35.9 vs 33.2) 和 AGIEval (38.4 vs 35.9) 等高难度推理基准上表现优异,证明其强大的逻辑推理能力。

2. 多语言通用能力:全球视野

在多语言综合评测中,Marco-Nano 以 42.3 的平均分位居 第一,超越了激活参数是其 2.5 倍的 Granite4-Tiny (42.1)。

- 亮点:

- BELEBELE (多语言阅读理解): 73.8 (远超第二名的 67.5)。

- MGSM (多语言数学): 65.3 (显著高于其他模型)。

- 翻译任务 (FLORES-200, WMT24++) 表现均衡,无明显短板。

3. 文化与区域理解:深耕本土

在考察特定区域文化和知识的基准测试中,Marco-Nano 再次以 55.6 的平均分夺得 冠军,展现了深厚的文化底蕴。

- 亮点:

- C-Eval (中文): 56.0 (远超 Qwen3-1.7B 的 65.1? 注:此处原文数据可能有误或基准不同,但 Marco-Nano 表现依然强劲,且远超 Trinity Nano 的 47.6)。修正:表格中 Qwen3-1.7B 为 65.1,Marco-Nano 为 56.0,此处 Qwen3 略高,但 Marco-Nano 在其他小语种上优势巨大。

- GreekMMLU (希腊语): 64.1 (SOTA)。

- TurkishMMLU (土耳其语): 48.9 (SOTA)。

- IndoCulture (印尼文化): 57.4 (SOTA)。

- KazakhMMLU (哈萨克语): 53.1 (SOTA)。

结论:Marco-Nano 证明了 稀疏 MoE 架构 在多语言场景下的巨大潜力。它用极低的计算成本,实现了对全球多种语言及其背后文化的深刻理解,是部署在边缘设备或对延迟敏感场景下的理想选择。

应用场景

- 📱 移动端/边缘 AI:0.6B 的激活参数量使其能在手机、平板甚至 IoT 设备上流畅运行,提供实时的多语言交互体验。

- 🌍 全球化客服与助手:支持 29 种语言,能准确理解不同文化背景下的用户意图,提供本地化服务。

- 📚 跨语言教育与内容创作:强大的翻译和文化理解能力,适合用于多语言教材生成、内容本地化等任务。

- ⚡ 高并发推理服务:极低的计算需求意味着更高的吞吐量和更低的服务器成本,适合大规模部署。

相关文章