“现在的 AI 视频生成越来越逼真,但往往‘见光死’:镜头一转,主角换了张脸;动作一大,身体变了模样。这种‘身份漂移’让 AI 视频难以真正用于影视制作。”

“WILDACTOR 的出现,就是为了让数字演员在任何镜头、任何角度、任何动作下,都能保持‘表里如一’。”

由 香港科技大学、美团和新加坡国立大学 联合研究团队推出的 WILDACTOR 系统,正式向 AI 视频生成的终极难题发起挑战:如何在无约束的视角变化和大幅动作中,保持人物全身身份的严格一致?

- 项目主页:https://wildactor.github.io

- GitHub:https://github.com/WildActor/WildActor

实验表明,WILDACTOR 在身体一致性指标上大幅超越现有开源及商业模型(包括 Vidu、可灵等),真正实现了“任意视角、全程一致”的电影级人物视频生成。

核心痛点:为什么 AI 视频总爱“变脸”?

现有的主流视频生成模型(如 Sora、可灵、Runway 等)虽然能生成流畅的画面,但在处理长视频或复杂镜头时,常面临两大顽疾:

- 面部为中心偏差:过度关注脸部一致性,导致身体、服装、体型随镜头变化而“漂移”。出现“脸是对的,身体却换了个人”的尴尬。

- 姿态锁定伪影:为了保持身份,强行复制参考图的姿态,导致人物动作僵硬,像被“冻结”了一样,无法自然运动。

WILDACTOR 的解决思路:不再依赖单一的正面照,而是让 AI 学习多视角、全身性的身份特征。无论镜头如何切换,AI 都能理解“这是同一个人”,并让其自然表演。

四大核心能力:重新定义数字演员

1. 📸 任意视角参考 (Arbitrary View Reference)

- 无需 3D 扫描:只需提供普通的正面、侧面、背面照片(甚至只有其中一两张),AI 即可构建完整的 3D 身份认知。

- 智能补全:即使缺少某个角度的照片,模型也能基于已有信息推断出该角度下的身份特征。

2. 🧍 全身身份严格保持 (Full-Body Identity Consistency)

- 拒绝“漂浮的头”:不仅脸部不变,身材比例、肌肉线条、服装纹理、发型细节均全程保持一致。

- 动态适应:在奔跑、跳跃、转身等大幅动作下,身份特征依然稳固,不会出现肢体扭曲或衣物突变。

3. 🎥 长视频叙事生成 (Long-Form Narrative)

- 多镜头连贯:支持生成包含多个场景、多个镜头切换的连续故事。

- 复杂运镜:完美适配推拉摇移、环绕拍摄等复杂镜头语言,人物在画面中始终如一。

4. 🌍 开放环境适应 (Open-World Adaptation)

- 全场景通用:人物可在森林、城市、室内等各种环境中活动。

- 光影鲁棒性:适应白天、夜晚、逆光、霓虹灯等各种光照条件,身份特征不受光线干扰。

🧠 技术揭秘:WILDACTOR 是如何做到的?

WILDACTOR 的成功源于其独特的数据构建与架构设计双轮驱动。

1. 📊 Actor-18M:迄今最大人体视频数据集

为了训练出真正的“全能演员”,团队构建了包含 160 万段视频 和 1800 万张图像 的 Actor-18M 数据集:

- 视角增强 (Subset A):利用 AI 编辑技术,将大量正面视角数据扩展为侧面、背面等多角度数据,解决训练数据视角分布不均的问题。

- 属性增强 (Subset B):在不同环境、光照、动作下生成同一人的参考图,防止模型过拟合背景线索。

- 标准锚点 (Subset C):精选正面、侧面、背面三视图作为“身份锚点”,确保身份认知的完整性。

2. ⚙️ 两大核心技术引擎

A. 非对称身份保留注意力机制 (Asymmetric Identity-Preserving Attention)

- 原理:视频画面可以“关注”参考照片以获取身份信息,但参考照片不能“关注”视频画面。

- 效果:这就像演员可以参考定妆照来化妆,但定妆照不会受拍摄现场动作的影响而变形。从而避免了参考图的静态姿态“污染”视频的动态运动,解决了“姿态锁定”问题。

B. 视角自适应蒙特卡洛采样 (View-Adaptive Monte Carlo Sampling)

- 原理:在训练过程中,智能地选择互补的视角组合。如果已选了正面照,就优先采样侧面或背面照作为参考。

- 效果:强迫模型学习真正的“视角无关”身份理解,而不是偷懒只依赖正面图。实验显示,该策略将背面视角的生成质量得分从 0.680 提升至 0.937。

C. 身份感知位置编码 (Identity-Aware Positional Encoding)

- 原理:给参考照片和视频帧打上不同的“时空标签”,明确区分“这是静态参考”和“这是动态视频”。

- 效果:防止两者在特征空间中混淆,确保身份信息与运动信息解耦。

📈 实测表现:全面超越竞品

研究团队建立了专用基准 Actor-Bench 进行严格测试:

| 指标 | WILDACTOR | 最佳商业模型 (Vidu/可灵) | 最佳开源模型 | 优势分析 |

|---|---|---|---|---|

| 脸部一致性 | 0.559 | 0.565 | ~0.520 | 与顶级商业模型持平 |

| 身体一致性 | 0.952 🏆 | 0.905 | ~0.850 | 大幅领先,解决核心痛点 |

| 文本对齐度 | 0.920 🏆 | 0.880 | ~0.840 | 动作指令执行更精准 |

| 视角鲁棒性 | 极高 | 中等 | 低 | 背面/侧面视角生成质量质变 |

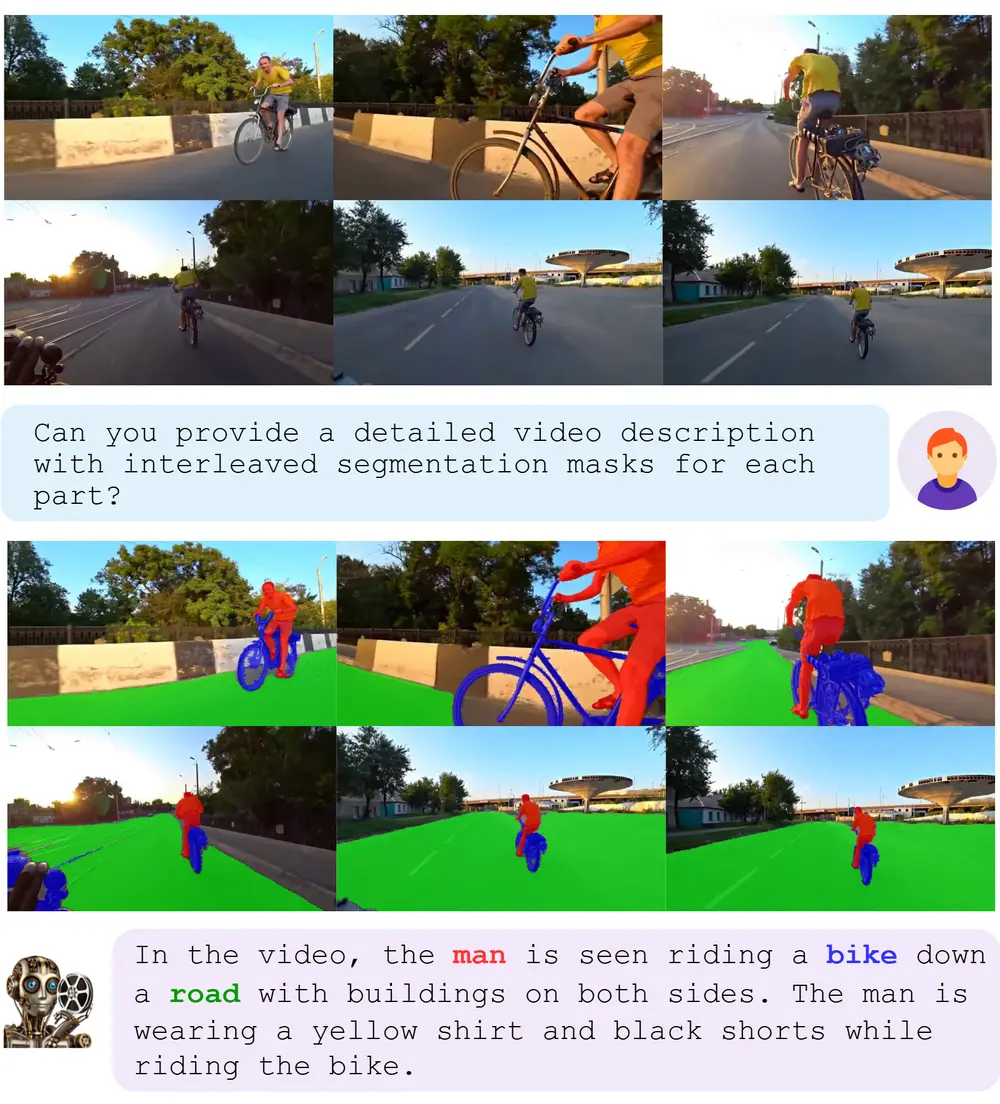

直观案例:

- 攀岩场景:竞品在大幅度肢体伸展时出现手臂变粗、衣服变色;WILDACTOR 全程稳定。

- 服装店试衣:竞品在转身时脸部特征丢失;WILDACTOR 在 360 度旋转中依然保持完美身份。

💡 局限与未来

尽管表现卓越,WILDACTOR 仍有进步空间:

- 多人交互:目前主要优化单人场景,多人互动时的身份区分需进一步研究。

- 极端视角:如完全俯视(上帝视角)或极度仰视,生成质量偶有波动。

- 未来规划:团队计划扩展至多人场景、更复杂的物理交互及更长时程的叙事生成。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...